简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

前面介绍了“机器人如何表示自身位姿”的问题,部分地解释了 SLAM 经典模型中变量的含义和运动方程部分。本文要讨论“机器人如何观测外部世界”,也就是观测方程部分。而在以相机为主的视觉SLAM中,观测主要是指相机成像的过程。视觉SLAM十四讲ch5_哔哩哔哩_bilibili一、相机模型相机将三维世界中的坐标点(单位为米)映射到二维图像平面(单位为像素)的过程能够用一个几何模型进行描述。这个模型有很

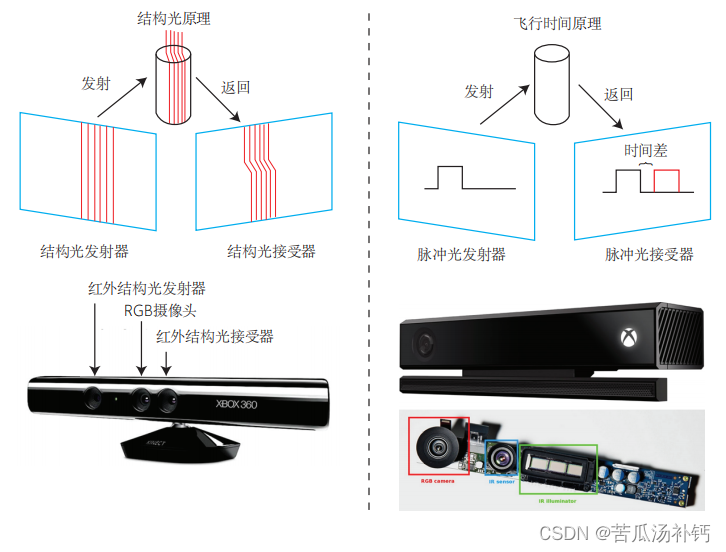

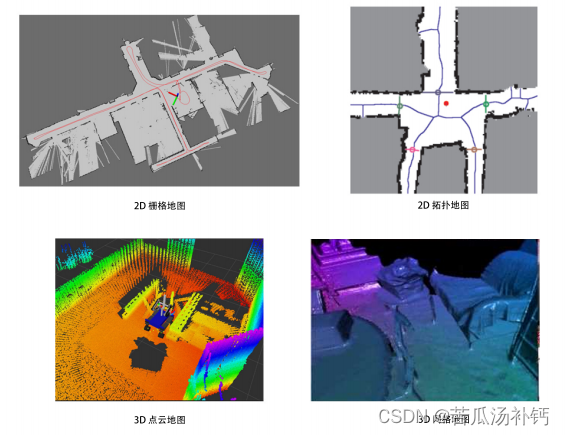

SLAM: Simultaneous Localization and Mapping 同时定位与地图构建(建图)。搭载特定传感器的主体,在没有环境先验信息的情况下,于运动过程中建立环地的模型。同时储计自己的运动。视觉SLAM:以相机为主要传感器的SLAM。同时从图像中估计相机的运动以及环境的情况。传感器在空间运动中将自己的运动估计出来,返给使用者;在运动过程中描述出运动环境。【高翔】视觉SLAM

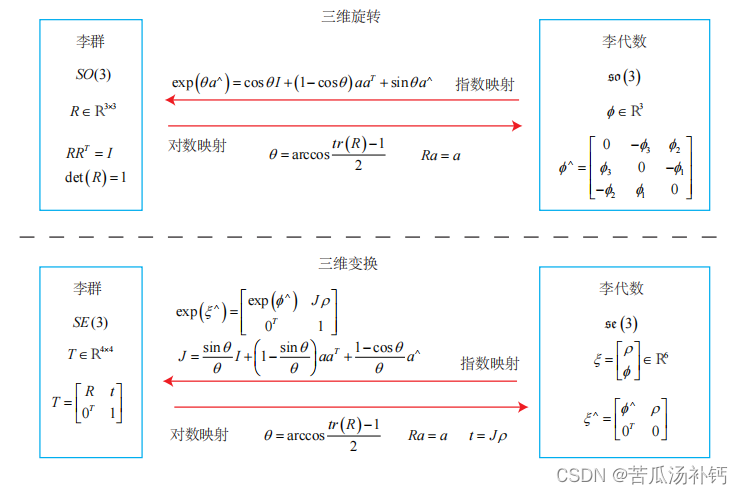

三维世界中刚体运动的描述:旋转矩阵、旋转向量、欧拉角、四元数等。除了表示之外,还要对它们进行估计和优化。旋转矩阵自身带有约束(正交且行列式为1)。作为优化变量时,会引入额外的约束,使优化变得困难。李代数上可以变成无约束优化。视觉SLAM十四讲ch4_哔哩哔哩_bilibili以上就是今天要讲的内容,本文重点介绍了旋转的表示,但是在SLAM 中,除了表示之 外,我们还要对它们进行估计和优化。因为在S

SAM(Segment Anything Model)是一种基于提示的通用图像分割基础模型,通过统一提示接口实现零样本分割能力。其核心创新包括:1)提出可提示分割任务,统一多种分割需求;2)设计模块化三组件架构(图像编码器、提示编码器、掩码解码器),支持多类型提示输入;3)构建数据引擎分阶段生成SA-1B超大规模数据集(11M图像+1.1B掩码)。实验表明,SAM在零样本设置下性能接近监督方法,展

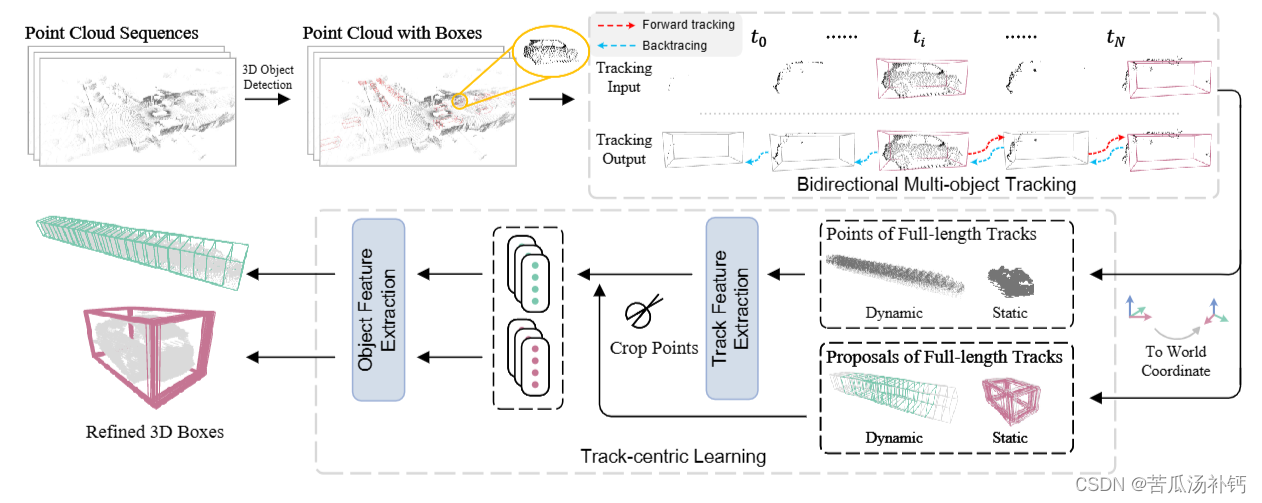

这篇论文提出了一种新的离线3D目标检测系统,该系统采用了一种跟踪中心的设计,并具有一个基于跟踪的检测模块和一个跟踪中心的学习模块。此外,该方法还提出了一种新的跟踪中心的标注方法,能够有效地解决目标检测中的标注歧义问题。命名为名称,即使检测到的物体在某些时间步骤中没有足够的点云数据,也可以利用该物体的时间序列信息来推断其位置和姿态,从而提高目标检测的准确性。大量的实验表明,该方法在竞争激烈的Waym

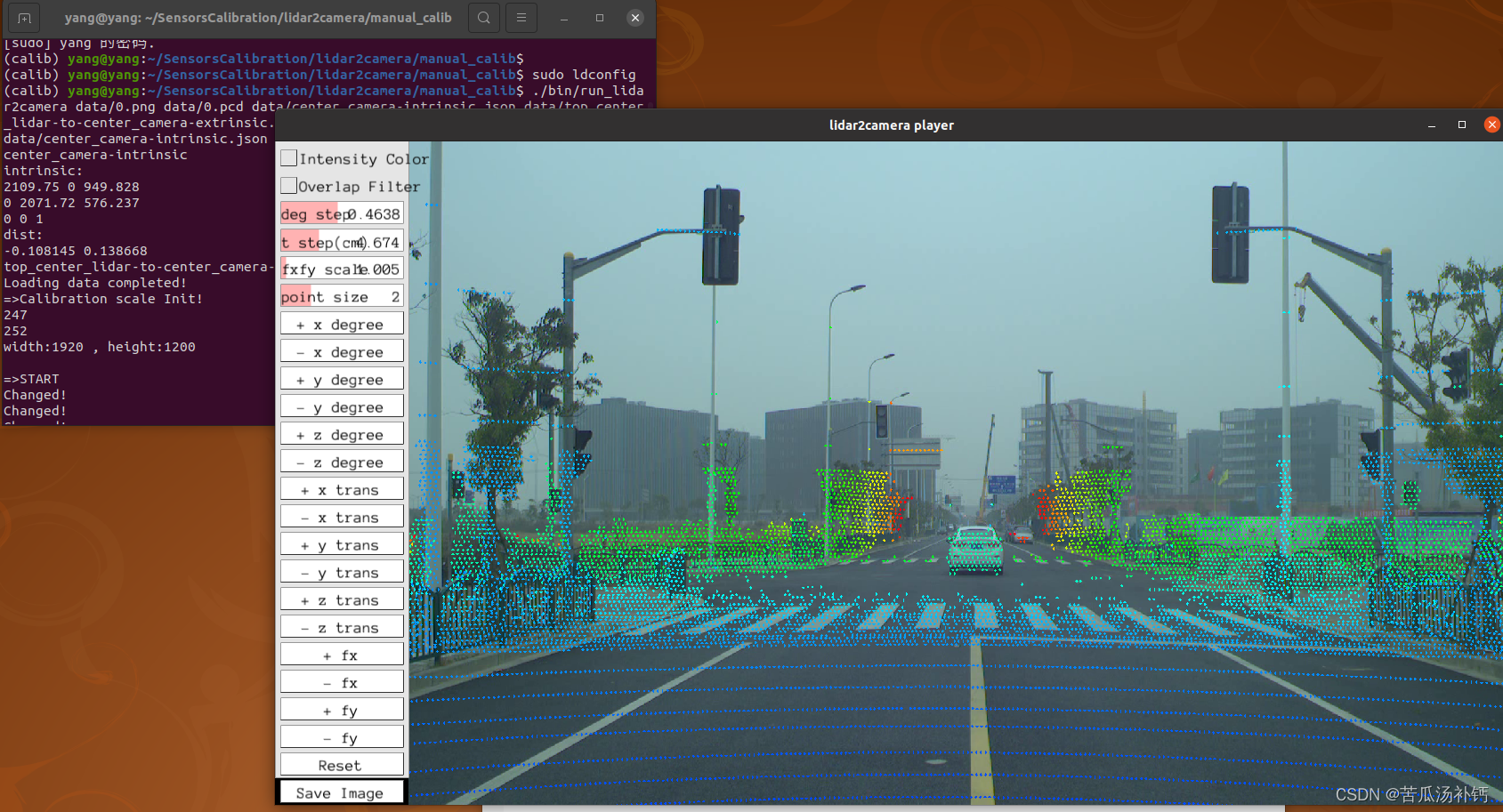

我没有把openclib整个安装下来,只装了我需要的lidar2camera,以下是安装过程。因为我开始安装的时候创建了一个calib的虚拟环境,所以无法正常运行,切换环境后即可。依次输入命令,进入刚刚下载好的源文件目录,并进行安装。通过which cmake可以查看安装的路径。

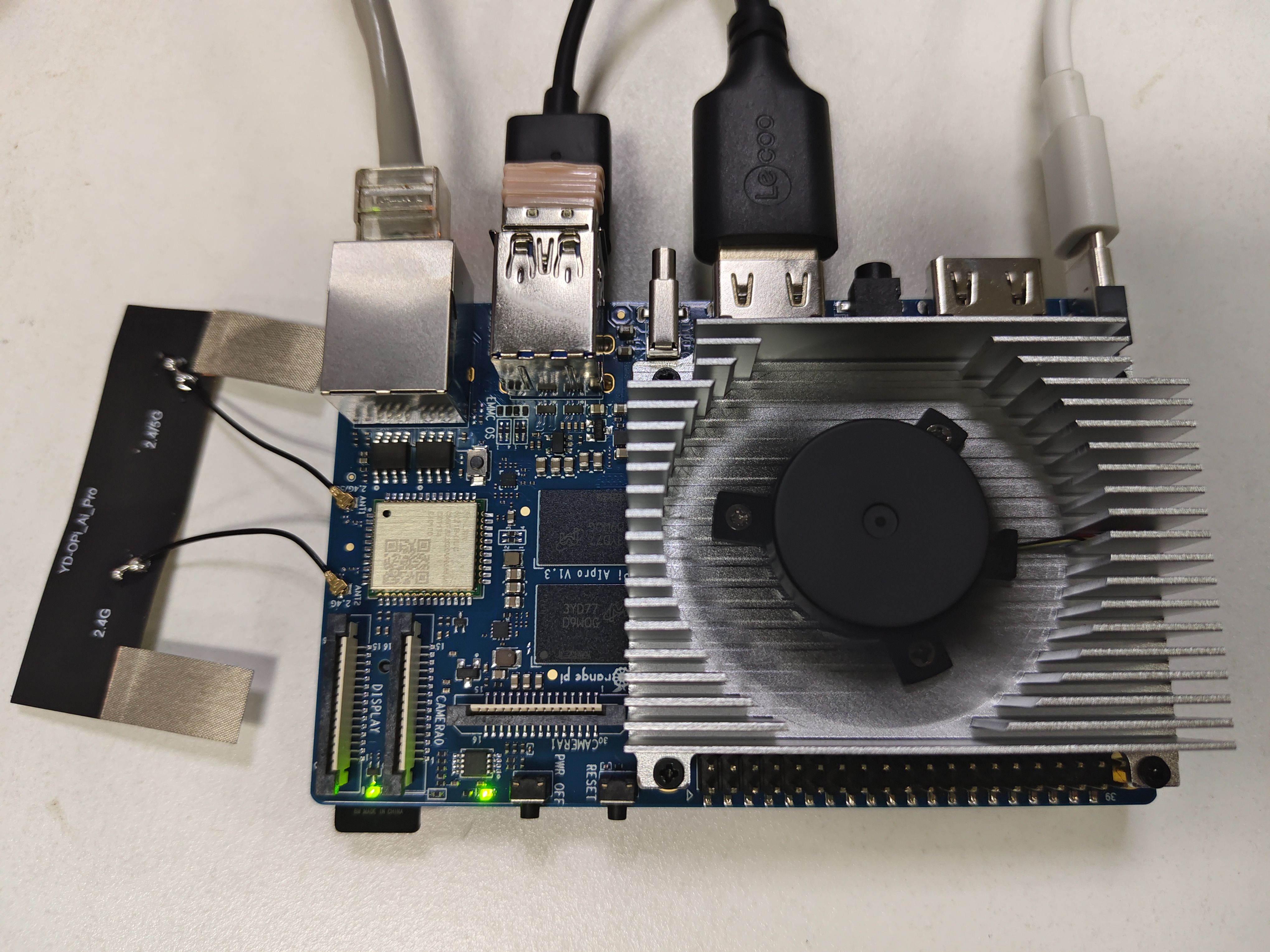

前言 香橙派AIpro+ubuntu系统+32G sd卡 香橙派AIpro开发板采用昇腾AI技术路线,接口丰富且具有强大的可扩展性,提供8/20TOPS澎湃算力,可广泛使用于AI边缘计算、深度视觉学习及视频流AI分析、视频图像分析、自然语言处理等AI领域。通过昇腾CANN软件栈的AI编程接口,可满足大多数AI算法原型验证、推