简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

AI助力科学研究的现状与展望 人工智能(AI)正加速推动科学研究的变革,在生命科学、物质科学等领域取得显著成果。在生命科学方面,AI已应用于蛋白质结构预测(如AlphaFold)、药物设计等,但目前准确率仍有提升空间。物质科学中,AI帮助发现新型材料、优化化学合成路径,并展现出跨学科迁移学习的潜力。关键技术包括深度学习、强化学习和生成式AI,但面临可解释性、数据质量等挑战。未来趋势将聚焦自动化实验

《视觉世界模型研究综述:从观察到认知世界》 本文系统梳理了视觉世界模型(VWM)的研究进展,指出当前领域存在概念不统一、评估标准割裂等问题。作者提出以视觉为核心驱动力的研究框架,将VWM分解为视觉编码、知识学习和可控模拟三大组件,并据此分析现有模型的四类架构设计。研究强调VWM需超越表象模仿,建立包含时空连贯性、物理动力学和因果机制的多层次知识体系。在评估方面,主张从视觉质量扩展到动态合理性和任务

本文提出Scal3R方法,解决大规模3D重建中长视频序列处理难题。针对现有前馈模型因内存限制难以保持长序列重建一致性的问题,创新性地引入神经全局上下文表示(GCM),通过轻量级自适应记忆单元(AMU)高效压缩场景信息。该方法采用测试时训练(TTT)机制,以块为单位更新快速权重,显著提升内存效率。实验表明,在KITTI和Oxford等数据集上,Scal3R实现了领先的位姿估计和3D重建精度,同时保持

d81xˉDIϵϕ∏abc∑abc/ $$E。

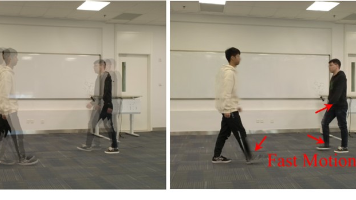

本文提出TrackerSplat方法,通过整合点追踪技术优化动态3D高斯场景重建。针对传统方法在快速运动时出现的伪影问题,该方法利用点追踪模型提取像素轨迹并三角化到3D高斯基元,指导其位移、旋转和缩放参数的优化。关键技术包括:1)基于点追踪的初始运动估计;2)并行加权增量最小二乘法(PWI-LS)求解高斯变换;3)多视角观测下的运动补偿。实验表明,该方法在保持实时渲染速度的同时,显著提升了大幅位移

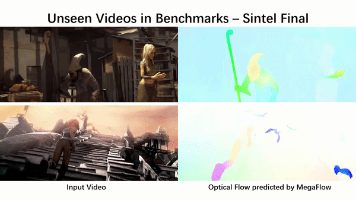

摘要: MegaFlow提出了一种零样本大位移光流估计方法,通过结合预训练视觉Transformer的全局匹配能力和轻量级局部优化模块,解决了传统方法在大位移和跨域泛化中的局限性。该框架将光流估计转化为全局相关性计算问题,利用DINOv2特征构建全对全匹配,并通过循环细化提升精度。实验表明,MegaFlow在Sintel、KITTI等基准上实现了零样本SOTA性能,且可无缝扩展至长序列点追踪任务。

摘要 《WorldWarp: Propagating 3D Geometry with Asynchronous Video Diffusion》提出了一种创新方法来解决长视频生成中的几何一致性问题。该方法通过3D高斯泼溅(3DGS)构建在线几何缓存,将历史内容显式变形为新视角作为结构支架。针对静态变形导致的遮挡问题,设计了时空扩散模型(ST-Diff),其核心创新是时空变化的噪声调度机制:空白区

HY-World 1.5:实时交互式世界建模系统框架 腾讯推出的HY-World 1.5突破了传统3D世界建模的局限性,通过创新的WorldPlay流式视频扩散模型,实现了24FPS的实时交互式世界生成。该系统具备四大核心技术: 1)双动作表征融合离散与连续控制信号; 2)重构上下文记忆机制保持长期几何一致性; 3)WorldCompass强化学习框架提升动作跟随能力; 4)上下文强制蒸馏技术平衡

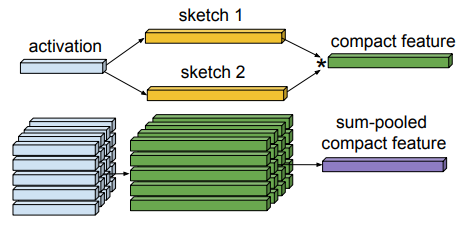

基于生物模仿视杆细胞视觉设计的Token混合器聚合注意力和一种具有门控通道注意力的通道混合器卷积GLU。作者将它们结合起来,提出一种强大的高度鲁棒的视觉模型TransNeXt,它在各种视觉任务如分类、检测和分割等方面都实现了最先进的性能。TransNeXt在多尺度推理的出色性能突显了它在解决深度衰减问题方面优于大型核策略的优势。此外,作者还提供了一个CUDA实现,在训练中实现了高达103.4%的加

文章摘要: 本文介绍了一个创新的3D场景生成系统,具有四大核心功能:1)通过文本或图像一键生成360度全景空间(HY-Pano 2.0),采用无相机元数据的隐式学习方案;2)智能轨迹规划(WorldNav)实现场景探索,支持五种专业级导航模式;3)世界扩展技术(HY-WorldStereo 2.0)生成高质量新视角视频,结合几何感知记忆机制保持一致性;4)支持生成可编辑的3D场景和交互式游戏环境。