简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

序列标注指给定输入序列,给序列中每个Token进行标注标签的过程。序列标注问题通常用于从文本中进行信息抽取,包括分词(Word Segmentation)、词性标注(Position Tagging)、命名实体识别(Named Entity Recognition, NER)等。输入序列清华大学座落于首都北京输出标注BIIIOOOOOBI如上表所示,清华大学和北京是地名,需要将其识别,我们对每个输

今天学习了CycleGAN的相关知识。通过学习这节课程和查阅相关资料,我了解到这个模型的重要应用是域迁移,它能够在两个不同的图像域之间进行转换,而无需配对的训练数据。同时,这个模型引入了循环一致性损失,确保了从一个域到另一个域再到原始域的图像转换保持一致性。这有助于生成更加逼真和合理的转换结果。

今天学习了ShuffleNet图像分类的相关知识。通过课程,我认识到ShuffleNet 是一种专门为移动设备和嵌入式设备设计的轻量级神经网络架构, 使用了通道重排和分组卷积等技术它在保持较高分类精度的同时,显著减少了模型的计算和参数量。作为一种轻量级网络,它的精确度较低。在需要更高精度或者处理更复杂任务的场景下,可能需要考虑更复杂的模型。

今天学习了如何基于mindspore来实现BERT对话情绪识别的相关知识。BERT模型是基于Transformer中的Encoder并加上双向的结构,BERT模型的主要创新点都在预训练方法上,即用了Masked Language Model和Next Sentence Prediction两种方法。期待进一步的学习。

近些年,随着基于自注意(Self-Attention)结构的模型的发展,特别是Transformer模型的提出,极大地促进了自然语言处理模型的发展。由于Transformers的计算效率和可扩展性,它已经能够训练具有超过100B参数的空前规模的模型。ViT则是自然语言处理和计算机视觉两个领域的融合结晶。在不依赖卷积操作的情况下,依然可以在图像分类任务上达到很好的效果。模型结构今天学习了如何完成了V

MobileNet网络是由Google团队于2017年提出的专注于移动端、嵌入式或IoT设备的轻量级CNN网络,相比于传统的卷积神经网络,MobileNet网络使用深度可分离卷积(Depthwise Separable Convolution)的思想在准确率小幅度降低的前提下,大大减小了模型参数与运算量。并引入宽度系数 α和分辨率系数 β使模型满足不同应用场景的需求。

背景介绍背景介绍AI编译框架分为两种运行模式,分别是动态图模式以及静态图模式。MindSpore默认情况下是以动态图模式运行,但也支持手工切换为静态图模式。一、动态图模式动态图的特点是计算图的构建和计算同时发生(Define by run),其符合Python的解释执行方式,在计算图中定义一个Tensor时,其值就已经被计算且确定,因此在调试模型时较为方便,能够实时得到中间结果的值,但由于所有节点

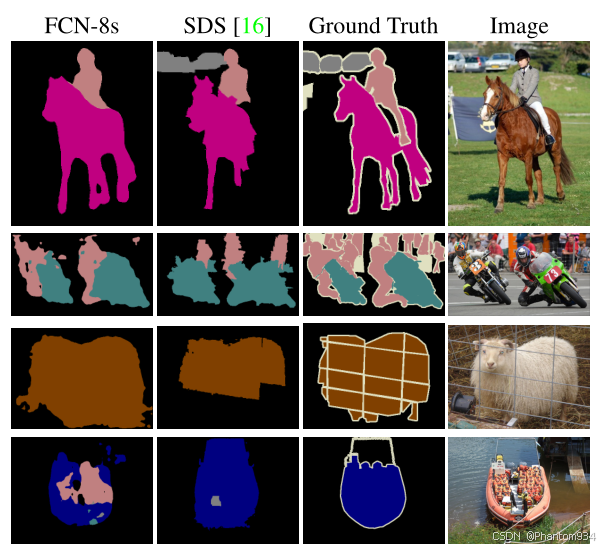

FCN主要用于图像分割领域,是一种端到端的分割方法,是深度学习应用在图像语义分割的开山之作。通过进行像素级的预测直接得出与原图大小相等的label map。因FCN丢弃全连接层替换为全卷积层,网络所有层均为卷积层,故称为全卷积网络。这一部分主要对训练出来的模型效果进行评估,为了便于解释,假设如下:共有k1k+1k1个类(从L0L_0L0到LkL_kLk, 其中包含一个空类或背景),pijp_{

今天学习了迁移学习的相关知识。我觉得迁移学习是机器学习中一种利用已经训练好的模型(通常是在大规模数据集上预训练的模型)来解决新的但相关的问题的技术。其核心思想是利用从一个任务中学到的知识来加速另一个相关任务的学习过程。除此之外,我还了解了关于ResNet50的相关知识。它是ResNet系列中的一员,其中的“50”表示网络中包含50个主要的卷积层。这几天学习的内容比较复杂,还需要留更多的时间来复习。

ResNet50网络是2015年由微软实验室的何恺明提出,获得ILSVRC2015图像分类竞赛第一名。在ResNet网络提出之前,传统的卷积神经网络都是将一系列的卷积层和池化层堆叠得到的,但当网络堆叠到一定深度时,就会出现退化问题。下图是在CIFAR-10数据集上使用56层网络与20层网络训练误差和测试误差图,由图中数据可以看出,56层网络比20层网络训练误差和测试误差更大,随着网络的加深,其误差