简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

DeepSeek V4 在 Agent Coding 和代码理解场景上,明显上了一个台阶。不过,DeepSeek-V4-Pro 在没有 Coding Plan 的情况下,价格还是偏高。V4-Flash 的定价很香,但在开发场景还无法成为主力,暂没有资格成为日常开发的默认选项。另外,在复杂的编码、精准问答和前沿科学推理上,跟 Claude Opus 4.6 以及 GPT 5.5 还有不小距离。

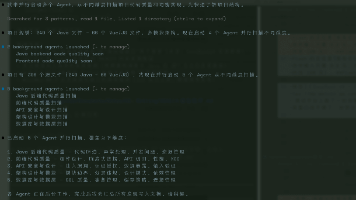

写到这里,Guide 想把这次 GPT-5.5 实战的几个核心感受摊开来说。第一,它确实能扛中大型项目的改造。但前提很明确:你得喂真实日志、真实代码、真实报错。如果只给一句”优化一下模型配置”,它大概率给出一套泛泛的方案。但如果你把”重启配置丢了””GLM embedding-3 写库维度报错””DeepSeek 语音链路 400”这些具体问题丢过去,它就能沿着工程链路一层层拆到底。第二,三个实战

代码审查已经覆盖了 Agent / Coding 方向,第二个 Demo 如果继续做文字整理,会和前面有点重叠。我更想试的是另一个方向:把一次技术复盘会议录音,自动转成会议纪要、行动项和可播放的语音摘要。这个场景很常见。线上故障复盘、架构评审、需求澄清会,大家聊的时候信息密度很高,但会后整理经常没人愿意做。手动听录音、补上下文、提炼决策和风险点,费时间,还容易漏掉关键动作。更麻烦的是,录音本身很难

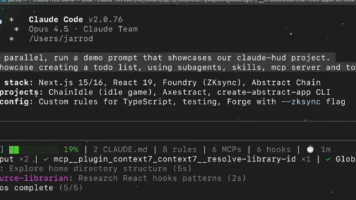

Agent View 不是那种看起来很炫的大功能。多会话并行时,可见性太差,切换成本太高。但这个改进,确实可以极大提高使用体验。相信很多朋友都像我这样,用 Claude Code、Codex、Cursor Agent,会同时开启多个 Agent 来并行搞事,或者在做一件事的时候,我们把任务拆开。问题是,Agent 数量一多,人就成了调度器。Agent View 把这件事往前推进了一步。黄色告诉你谁

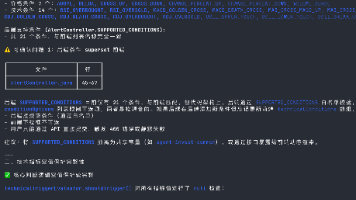

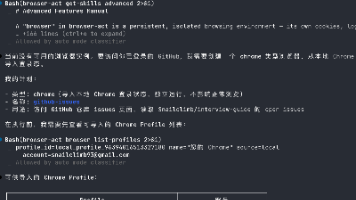

这几天用下来,BrowserAct Skill 做的事情可以概括成一句话:把浏览器操作变成 Agent 可以调用的一层工具。自动打开页面、填写表单、复用登录态、捕获请求、截图记录,最后把结果交给上层处理。接入日常开发和工作流之后,真的能够省事不少。而且,它并不是直接让 Agent 在网页里乱点,像创建浏览器、导入本地 Chrome 登录态、提交表单、删除数据等敏感操作,会先停下来让你确认,确保出现

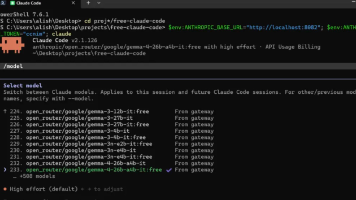

所有颜色都可以自定义,支持颜色名称(redgreencyanyellowdim等)、256 色编号(0-255)或十六进制值(#rrggbb让你不用时刻盯着屏幕,也能掌握 Claude Code 的运行状态。•上下文管理:实时看到上下文使用率,在质量下降前及时/compact•用量控制:直观看到用量消耗,避免关键时刻被限流•任务追踪:看到 Agent 在做什么、任务完成了多少,不再”两眼一抹黑”三

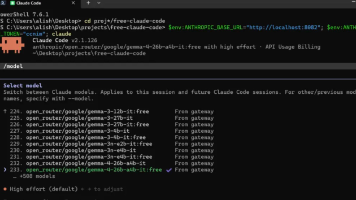

你好,我是小 G。如果你想在 Codex 里直接填 DeepSeek、GLM、Kimi 这类第三方 API Key,大概率不会像想象中那样直接跑起来。问题不是你填写的 Key 有问题,也不是你的账户用不了。这是因为协议没完全对上,简单来说就是无法正常通信。咱们以当前新版 Codex CLI / Codex App 的 API Key 模式为例,默认链路已经是;而不少第三方模型主要提供的是。

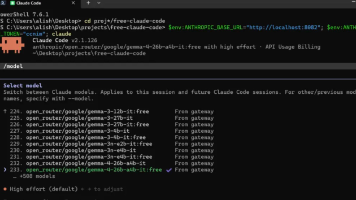

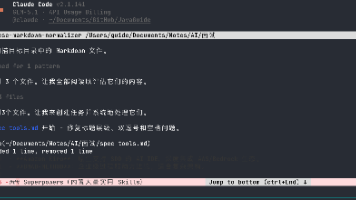

学 Claude Code,不建议只记命令。先用的课程式章节,把安装、授权、模式、终端命令跑通。再看里的 Claude Code 主线,补上 MCP、Hooks、Subagents、Skills、Plugins 和团队规范。如果你是软件开发方向,去 AIGuide 里看真实工程案例,尤其是第三方模型、慢查询治理、代码审计、多模型协同这些场景。4最后读,看它怎么把 Claude Code 变成一个做

学 Claude Code,不建议只记命令。先用的课程式章节,把安装、授权、模式、终端命令跑通。再看里的 Claude Code 主线,补上 MCP、Hooks、Subagents、Skills、Plugins 和团队规范。如果你是软件开发方向,去 AIGuide 里看真实工程案例,尤其是第三方模型、慢查询治理、代码审计、多模型协同这些场景。4最后读,看它怎么把 Claude Code 变成一个做

学 Claude Code,不建议只记命令。先用的课程式章节,把安装、授权、模式、终端命令跑通。再看里的 Claude Code 主线,补上 MCP、Hooks、Subagents、Skills、Plugins 和团队规范。如果你是软件开发方向,去 AIGuide 里看真实工程案例,尤其是第三方模型、慢查询治理、代码审计、多模型协同这些场景。4最后读,看它怎么把 Claude Code 变成一个做