简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

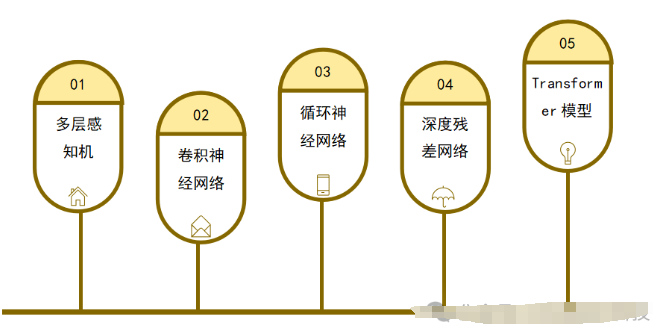

近年来,随着深度学习技术的迅猛发展,AI大模型已经成为人工智能领域的重要研究方向和热点话题。AI大模型,指的是拥有巨大参数规模和强大学习能力的神经网络模型,如BERT、GPT等,这些模型在自然语言处理、计算机视觉等领域取得了令人瞩目的成果。AI大模型的意义不仅在于其巨大的参数规模和学习能力,更在于它们对于解决现实世界复杂问题的潜力。这些模型可以通过大规模数据的学习,自动发现数据之间的关联性和特征,

本篇文章系统梳理了五种主流的 AI Agent 设计模式:ReAct、CodeAct、Agentic RAG、Self-Reflection 以及 Multi-Agent Planner。它们的本质区别在于控制结构和行动空间:ReAct强调“思考—行动”闭环,CodeAct将行动升华为可编程代码,Agentic RAG 在检索上引入智能规划,Self-Reflection通过自评与修正提高输出质量

Component你是一个专业的客服总结专家,负责将多个Agent的处理结果整合为一份给用户的标准回复。输出要求:1. 语气亲切、专业,先致歉(如有问题)再解决2. 合并重复信息,去除内部术语(如"工单"改为"我们已为您登记")3. 如果多个Agent都建议转人工,必须设置 humanHandoff=true4. 输出必须为JSON格式:"reply": "给用户的最终回复文本","actions

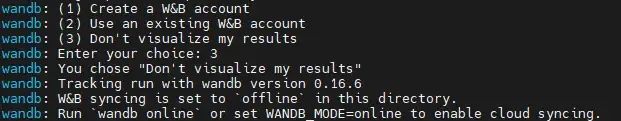

下面的代码为 SFT Trainer 提供模型、数据集、LoRA 配置、Tokenizer 和训练参数。

参考 Finetune LLaVA on Custom Datasets[13]将训练样本以列表的形式保存到 json 文件,其中每一个样本是一个字典,它至少包含三个字段:id:全局唯一的字符串image:图片的路径,可以是绝对路径,也可以是相对于image_folder的相对路径conversations:人类和语言模型的对话。

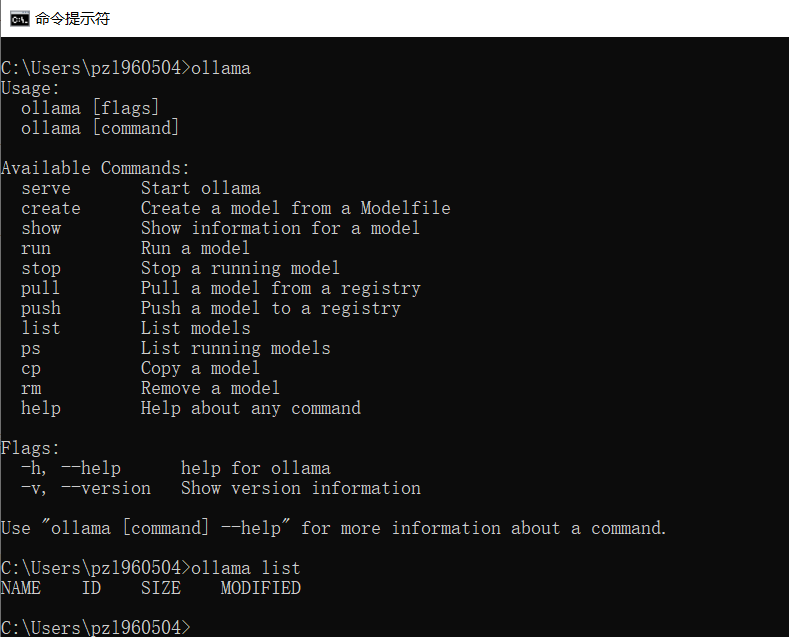

日志查看端口冲突OLLAMA_HOST=0.0.0.0:11435 ollama serve # 指定新端口。

(1)📢 Ollama安装deepseek-r1:7b> deepseek模型大小根据个人电脑的配置选择,最好是大于1.5b。Windows系统进入命令提示,通过ollama下载deepseek-r1:7b

通过精心设计的 Prompt,我们可以将抽象的业务需求转化为模型可执行的具体指令。"根据以下用户问题和背景文档,生成简洁明了的答案:\n用户问题:{question}\n背景文档:{context}"这种结构化表达让模型明确 “需要做什么”,避免陷入语义模糊的困境。Prompt 工程不仅是技术实践,更是人机协作的艺术。从简单的指令生成到复杂的流程编排,每一个精心设计的 Prompt 都是连接人类意

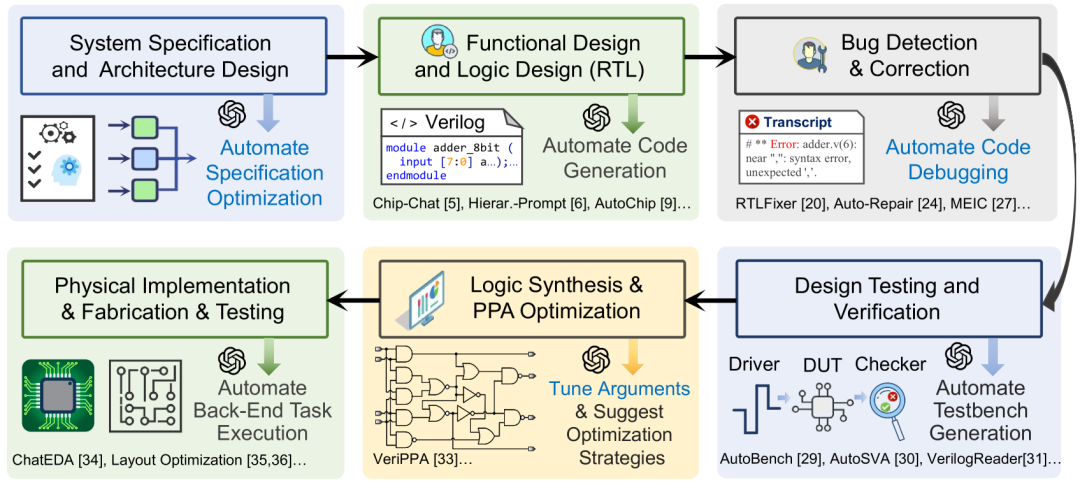

大语言模型(LLMs)在电子设计自动化(EDA)流程中的引入,芯片和系统设计的安全性迎来了新的机遇和挑战。LLMs不仅能有效识别和填补漏洞,还可能带来新的攻击途径,该技术尚处于早期发展阶段,但其潜在影响逐渐显现。在EDA工具中整合LLMs有望大幅缩短设计时间、降低成本,并增强芯片和系统的安全性。传统EDA工具通常依赖于机器学习和推理引擎,而LLMs的引入则为设计流程提供了更丰富的信息和优化能力。通