简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

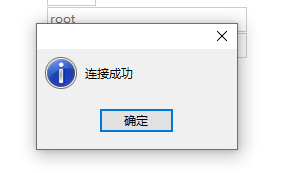

目录0、环境:1、修改my.cnf(无效):2、docker指定--lower-case-table-names=1(特定情况无效):3、解决方案0、环境:centos7、docker 17.12.1-ce、mysql 8.0.21docker安装mysql命令:docker run --name mysql --restart=always \-v /home/mysql/conf/my.cnf

《DevFish:程序员专属摸鱼神器》是一款创意VSCode插件,将编程休息时间趣味化为"养鱼"体验。该插件在编辑器侧边栏生成互动鱼缸,鱼儿会实时响应用户的编码行为——输入速度快时加速游动,调试时集体装死,还会通过冒泡提醒番茄钟休息。技术实现采用TypeScript+VSCode Webview+Canvas,核心包含鱼群运动算法、泡泡显示状态机等模块,通过MVCM架构管理数据

在信息化的时代,网络爬虫已经成为我们获取和处理大规模网络数据的重要工具。如果将现有网络上的海量数据使用爬虫工具将数据爬取保存下来,并进行分析,就可以挖掘出一些潜在的价值。而现在市面上也出现了很多爬虫工具以及爬虫框架,今天将介绍下Java体系下一款简单使用的爬虫框架WebMagic,并可以很简单的与Springboot进行集成。

1、springmvc-redis.xml配置:<?xml version="1.0" encoding="UTF-8"?><beans xmlns="http://www.springframework.org/schema/beans"xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"xmlns:ao...

最后,目前使用过去的感觉就是,它可以让我们逐渐从搜索引擎关键词,到AI提示词的过渡。经历过长时间搜索引擎关键词搜索的思维模式(简短,关键词堆叠),要转变到AI描述指令(完整语义,目标明确,而非关键词)对大部分人来说(包括我)是比较困难的事情。这时候有一款帮你增强优化提示词的工具就再好不过了。长时间使用下来,从不会到惯用的固定模式,也是个好的办法。同时,现在AI请求的次数收费越来越高。完整的提示词也

随着大语言模型(LLM)技术的爆发式发展,编程工具正经历从“辅助工具”到“智能伙伴”的质变。据开发者社区统计,2025年已有超80%的开发者将AI插件深度融入日常工作流,而IntelliJ IDEA作为Java生态的领军IDE,凭借其开放的插件生态,成为AI技术落地的核心战场。本文将从实战角度拆解主流AI插件,探索其如何重构代码编写、调试、协作的全流程,并展望未来趋势。

一、首先安装node.js1. 下载Node.js官方Windows版程序: https://nodejs.org/download/ 从0.6.1开始,Node.js在Windows平台上提供了两种安装方式,一是.MSI安装文件,另外还有一个.EXE可执行文件。 我选择了.EXE文件。因为.MSI安装文件除了将node.exe复制到C:\Program File

《DevFish:程序员专属摸鱼神器》是一款创意VSCode插件,将编程休息时间趣味化为"养鱼"体验。该插件在编辑器侧边栏生成互动鱼缸,鱼儿会实时响应用户的编码行为——输入速度快时加速游动,调试时集体装死,还会通过冒泡提醒番茄钟休息。技术实现采用TypeScript+VSCode Webview+Canvas,核心包含鱼群运动算法、泡泡显示状态机等模块,通过MVCM架构管理数据

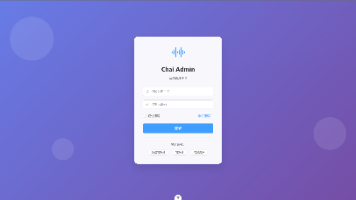

调侃归调侃,Chai Admin毕竟是自己亲生的。还是投入了一些时间精力来打磨这个项目,并且计划一直持续更新迭代并精心维护下去的。虽然它可能还不够完美,但我相信它能为开发者提供一个有价值的参考。⭐ 如果这个项目对你有帮助,请给它一个 Star!⭐。

最后,目前使用过去的感觉就是,它可以让我们逐渐从搜索引擎关键词,到AI提示词的过渡。经历过长时间搜索引擎关键词搜索的思维模式(简短,关键词堆叠),要转变到AI描述指令(完整语义,目标明确,而非关键词)对大部分人来说(包括我)是比较困难的事情。这时候有一款帮你增强优化提示词的工具就再好不过了。长时间使用下来,从不会到惯用的固定模式,也是个好的办法。同时,现在AI请求的次数收费越来越高。完整的提示词也