简介

该用户还未填写简介

擅长的技术栈

可提供的服务

具身智能开发者一站式资源中心,信息资讯,教育培训,资料下载,供应链集成、研发服务。

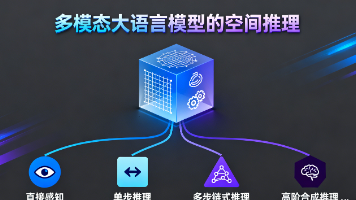

本文从认知视角构建空间推理任务分类体系,梳理文本、视觉 - 语言、具身场景下的基准数据集与评估指标,分析训练式、推理式两类提升空间推理能力的方法,揭示当前模型与人类空间智能的核心差距。

美国物流自动化企业 Logic Robotics 推出全球首款多设施自主移动托盘 Logic Pallet,48×40 英寸尺寸适配消费品与食品运输,具备 2000 磅(907kg)负载、160 小时超长续航、5 分钟完成拖车装卸能力,集成自主导航、自装卸、AI 库存管理功能,支持无通道高密度存储(容量提升 3 倍),通过 LINK AI 系统调度,替代传统托盘与叉车,实现跨设施 + 设施内全链路

高德千问开源行业首个三端的端云一体原生A2UI框架;魔芯科技连获两轮亿元融资,世界模型走出第三条技术路线;Anthropic启动300亿融资

ISO 10218:2025工业机器人功能安全标准落地指南,精准解读标准核心定义、实施必要性,明确适用企业、认证边界与人员配置方案,附全国及地方政策补贴清单,为国内企业合规落地提供全流程实操指引。

026年央视春晚机器人密集亮相,验证导览导购、特种作业、个人陪伴、家庭照护四大核心场景落地可行性。技术端,具身智能模型跨越7B参数激活门槛,通用小脑实现跨本体运动控制,真机数据、仿真合成数据、人类视频数据三线交织加速模型迭代。产业链方面,核心零部件(如灵巧手、电机)与具身智能大脑(大模型、世界模型)成为关键赛道,重点关注斯菱智驱、协创数据、索辰科技、群核科技等优质标的。本报告深度剖析技术演进、场景

Sunday Robotics 颠覆行业 “先造机器人再控场” 逻辑,以 “手套优先” 策略迭代 100 次 UMI 技能捕捉手套,采集百万级人类操作数据后才设计轮式机器人 Memo。依托被动稳定轮基、75% 人类操作速度、柔顺控制技术,聚焦家庭 manipulation 核心需求,2026 年启动 “Founding Family” Beta 计划,以商品级供应链控制成本,差异化对抗 Tesla

同济大学&华东师范大学&美的集团联合研发的基于多视图轨迹视频的高一致性具身世界模型MTV-World,通过多视图轨迹视频控制与空间补偿机制,突破上述技术瓶颈,实现兼具运动精度与物理一致性的视觉运动预测,为复杂双臂机器人操纵任务提供可靠的模拟支撑。

研究团队在《Advanced Science》发表成果,将龙虾(长臂虾)腹部外骨骼(食品废弃物)改造为生物混合机器人的柔性弯曲驱动器,结合合成部件实现高性能运动:运动频率达 8Hz、承重 680g(超自身 200 倍)、游泳速度 11cm/s,寿命从数小时延长至 38 小时。该技术通过三种增强策略突破传统坏死机器人局限,实现游泳、抓取、搬运等功能,构建 “合成部件可复用 + 生物部件可降解” 的循

宇树发布全球首款量产载人变形机甲;爱思唯尔起诉Meta盗版论文训练大模型;马斯克起诉OpenAI索赔1500亿

宇树发布全球首款量产载人变形机甲;爱思唯尔起诉Meta盗版论文训练大模型;马斯克起诉OpenAI索赔1500亿