简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

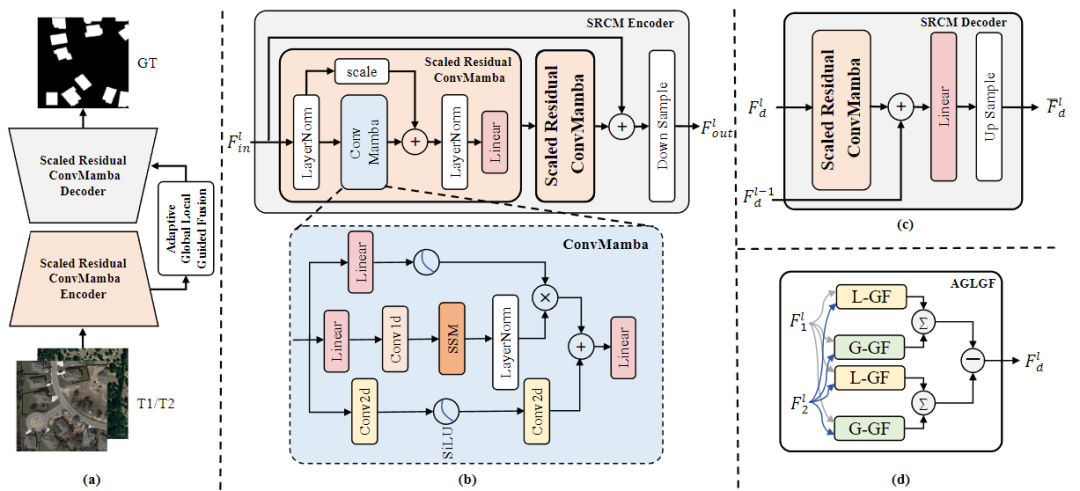

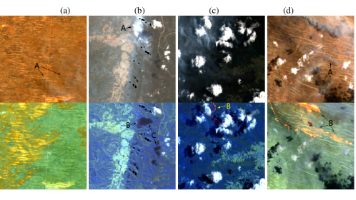

该模型结合了Mamba架构的全局特征提取能力和卷积操作的局部细节增强能力,通过引入Scaled Residual ConvMamba (SRCM)模块和Adaptive Global Local Guided Fusion (AGLGF)块,有效解决了现有Mamba方法在密集预测任务中缺乏详细线索的问题,并通过多时相特征交互提升了变化检测的准确性。3.设计了混合门模块(HGM),结合CNN算子的局

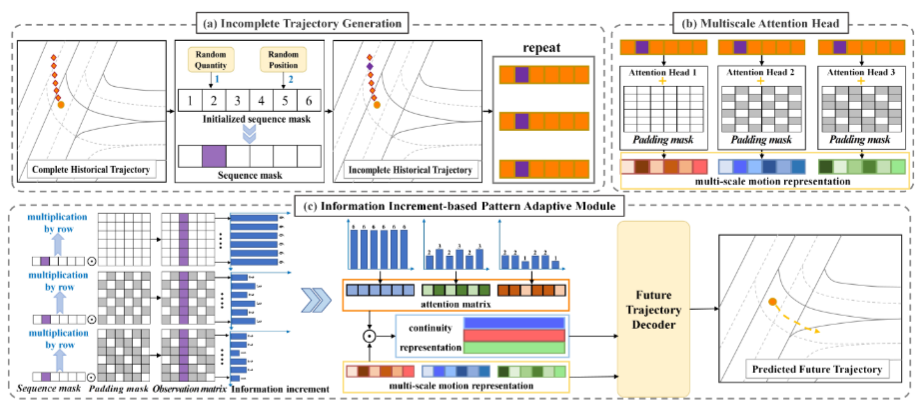

该模型通过引入多尺度特征提取和自注意力机制,有效地捕捉轨迹数据中的时空依赖关系,即使在输入信息不完全的情况下,也能提高轨迹预测的准确性。利用自注意力机制来建模轨迹点之间的关系,使得模型能够聚焦于与当前预测相关的重要轨迹片段,即使在输入信息不完整的情况下也能保持良好的性能。新的一年,多尺度深度学习领域出现一些投稿方向,这些方向将推动研究人员在复杂任务中取得更高的性能,并在多个应用场景中展现出广泛的潜

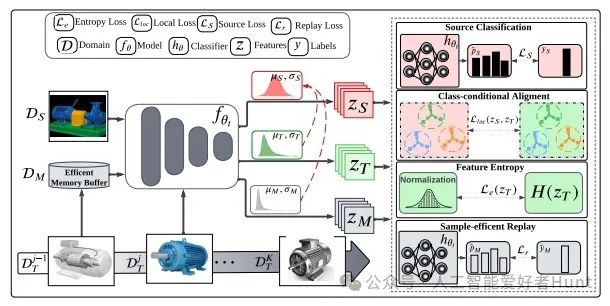

EverAdapt不仅保留了以前领域的统计信息,还能有效适应新场景。为了提高零故障标签模型转移的有效性,构建了一种新型联合领域对齐,旨在最小化源标签分布与目标分类结果分布之间的距离,这与传统的伪标签方法显著不同,因为后者并未全面利用目标领域的信息。随着现代工业的不断发展,传统的故障诊断技术已经很难满足生产需要,而深度学习以其强大的特征提取能力和在模式识别上的独特优势,为解决这类工业需求提供了一种可

GNN与强化学习的结合不仅推动了图机器学习的研究进展,还促进了新算法和模型的创新,为解决现实世界中的复杂问题开辟了新途径,在多个领域取得了显著的研究成果。

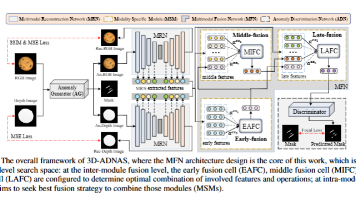

本文系统研究了多模态融合架构设计对3D异常检测(3D-AD)的影响,提出了一种新的神经架构搜索方法3D-ADNAS,首次同时搜索多模态融合策略和模态特定模块,显著提升了3D-AD在精度、帧率和内存使用方面的性能,并展现出处理小样本任务的潜力。这种创新不仅优化了数据处理效率,还让机器能够更自然地理解和交互,为人工智能的未来发展开辟了新的路径,开启了智能技术的多模态新时代。3D-ADNAS方法能够高效

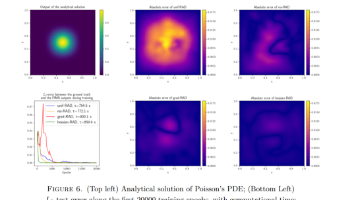

自适应物理信息神经网络(PINN)在解决复杂科学和工程问题中展现出显著优势。

UNet与Transformer的融合模型正成为医学影像、遥感分割等领域的研究热点。UNet擅长局部特征提取但长程建模不足,Transformer能捕捉全局依赖但计算成本高,二者互补形成高效架构。

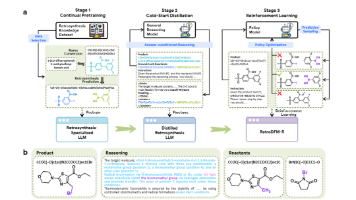

AI推理研究取得突破性进展:强化学习与符号推理的融合架构显著提升模型性能。化学逆合成领域,RETRODFM-R模型通过强化学习实现65%准确率,并增强可解释性;数学推理方面,双曲空间Transformer使多步推理准确率提升32%-45%。两项研究均证明:结合专业领域知识(化学规则/双曲几何)的强化学习框架,能有效解决传统模型在复杂推理中的逻辑连贯性和效率问题,为AI推理能力升级提供新范式。

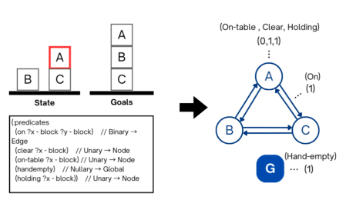

近期研究聚焦于图神经网络(GNN)与强化学习(RL)的融合,以突破传统方法在复杂关联场景中的局限。斯坦福团队提出图强化决策模型,在智能交通和电网调度中显著提升效率(30%通行率提升,22%能源浪费减少)。

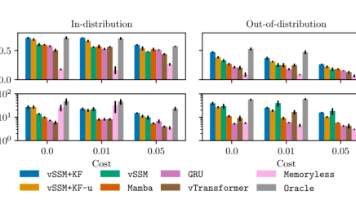

强化学习与卡尔曼滤波的交叉研究成为2025年前沿热点。最新研究表明,将卡尔曼滤波层嵌入强化学习框架能有效处理部分可观测环境下的不确定性,在非线性系统中显著优于传统方法。两大突破性成果显示:1)独立卡尔曼滤波层可实现端到端训练,在混沌系统中降低预测误差达30%;2)深度强化学习框架在非高斯数据处理上超越传统EnKF算法。该方向已形成三大技术路线:粒子融合、鲁棒建模和不确定性蒸馏,相关代码和论文资源已