简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

🔥 AI Agent本质与Harness工程指南 核心观点:真正的AI Agent是经过训练的神经网络模型本身,而非外部构建的工作流或框架。本文通过Claude Code案例,揭示了Agent开发的正确方向。 关键要点: 模型即Agent:智能体本质是具备决策能力的模型,Harness工程是为其配备执行工具和环境 发展历程:从DeepMind玩Atari到LLM编程Agent,证明智能是训练而非

本文提供了在Linux系统上配置Claude Code接入阿里云百炼Coding Plan的完整教程,包含以下核心内容:1) 创建.claude目录并配置settings.json文件;2) 通过claude.json文件跳过初始化引导;3) 常用命令和权限模式说明;4) 一键配置脚本;5) 常见问题解决方案。通过对接国产大模型,开发者可以在国内网络环境下流畅使用AI编程助手进行代码生成、调试和重

文章参考来源:InternVL3,这是一个高级多模态大型语言模型 (MLLM) 系列,展示了卓越的整体性能。与 InternVL 2.5 相比,InternVL3 表现出卓越的多模态感知和推理能力,同时进一步扩展了其多模态功能,包括工具使用、GUI 代理、工业图像分析、3D 视觉感知等。此外,我们将 InternVL3 与 Qwen2.5 Chat 模型进行了比较,其相应的预训练基础模型被用作 I

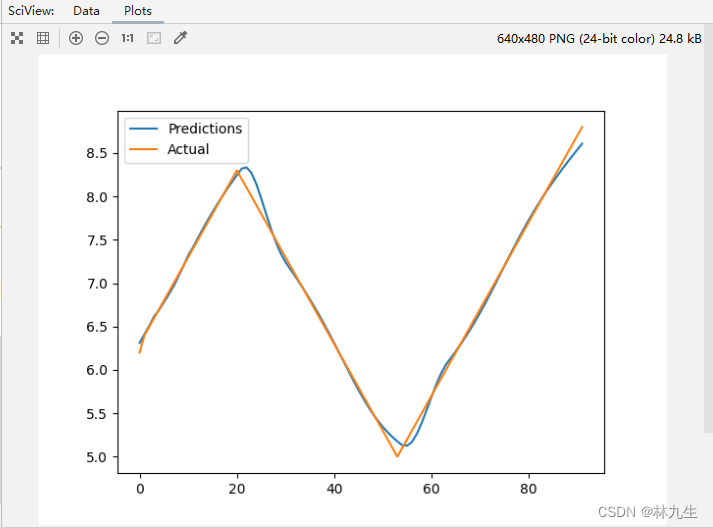

在本文中,我们将介绍如何使用 LSTM(长短期记忆)神经网络来预测水位数据。我们将使用 Python 中的一些流行库,如 NumPy、Pandas 和 Keras。首先,我们将加载数据,然后预处理它以进行适当的训练。接着,我们将构建 LSTM 模型,并对其进行训练。最后,我们将使用训练好的模型进行预测,并将结果可视化。

本文提供华为昇腾NPU部署Qwen3.5+SGLang的实战指南,包含Docker Compose配置和启动脚本说明。环境要求为昇腾910B/8.5.0,通过挂载模型目录和映射NPU设备实现快速部署。关键配置包括CPU调优、Ascend环境设置、多卡并行参数等,并给出启动验证步骤。文章还提供性能调优建议和常见问题排查方法,适用于单机多卡场景,支持多模态能力,可根据业务需求调整参数。

🔥 AI Agent本质与Harness工程指南 核心观点:真正的AI Agent是经过训练的神经网络模型本身,而非外部构建的工作流或框架。本文通过Claude Code案例,揭示了Agent开发的正确方向。 关键要点: 模型即Agent:智能体本质是具备决策能力的模型,Harness工程是为其配备执行工具和环境 发展历程:从DeepMind玩Atari到LLM编程Agent,证明智能是训练而非

本文提供了在Linux系统上配置Claude Code接入阿里云百炼Coding Plan的完整教程,包含以下核心内容:1) 创建.claude目录并配置settings.json文件;2) 通过claude.json文件跳过初始化引导;3) 常用命令和权限模式说明;4) 一键配置脚本;5) 常见问题解决方案。通过对接国产大模型,开发者可以在国内网络环境下流畅使用AI编程助手进行代码生成、调试和重

Flutter拍照/相册选择后对话框显示问题解决方案 主要问题: Context未挂载错误:异步操作完成后使用已失效的底部菜单context 布局渲染错误:对话框图片使用了无限宽度(double.infinity) 解决方案: 使用异步返回值传递选择结果,等待底部菜单关闭后再使用有效context执行后续操作 为对话框图片设置明确尺寸约束(固定宽度300),避免使用无限宽度 改进点: 优化底部菜单

本文提供华为昇腾NPU部署Qwen3.5+SGLang的实战指南,包含Docker Compose配置和启动脚本说明。环境要求为昇腾910B/8.5.0,通过挂载模型目录和映射NPU设备实现快速部署。关键配置包括CPU调优、Ascend环境设置、多卡并行参数等,并给出启动验证步骤。文章还提供性能调优建议和常见问题排查方法,适用于单机多卡场景,支持多模态能力,可根据业务需求调整参数。

除了显示名称和状态,我们还可以根据实际需要定制更详细的输出格式。{{.ID}}: 容器 ID{{.Names}}: 容器名称: 容器状态{{.Image}}: 使用的镜像{{.Ports}}: 容器的端口映射: 创建时间: 运行时间通过组合这些占位符,你可以根据自己的需求创建各种格式化输出。通过命令,你可以定制容器输出的格式,使其更加符合你的实际需求。无论是展示所有容器的详细信息,还是只显示简洁的