简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

微调(Fine-tuning)是指在已经预训练好的大语言模型基础上,使用特定领域或任务的数据集进行进一步的训练,使模型能够更好地适应并完成该领域或任务的具体要求。预训练的大语言模型通常在大规模通用语料库上进行训练,学习了语言的普遍规律和特征,但对于特定领域或任务的专业知识和特定需求,往往需要通过微调来优化。Swift提供的主要能力是efficient tuners,tuners是运行时动态加载到模

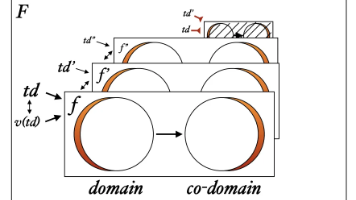

论文探讨了将大语言模型视为功能近似器的概念,提出了一个分析框架来评估这些模型在不同任务上的表现,强调了其通用性以及在交互式应用中的功能诱导过程,并讨论了这一视角下模型评估的相关问题。2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享**

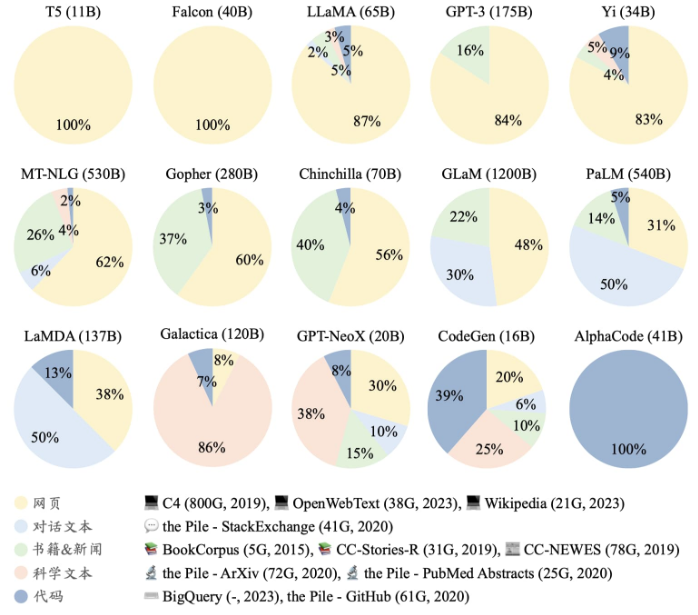

在规模扩展定律(Scaling Laws)被证明对语言模型有效之后,研究者构建出了许多大语言模型。尤其是 2022 年底面向普通消费者的 ChatGPT 模型的出现,正式标志着自然语言处理进入大语言模型时代。本章将简要梳理大语言模型的技术要点以及构建过程,并且列举了可用于预训练以及微调模型的常用数据集,介绍了目前开发大语言模型常用的代码库、预训练大语言模型的步骤以及涉及的关键技术,包括数据准备阶段

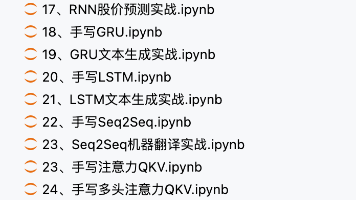

大语言模型是一种基于人工智能的自然语言处理技术,它具有庞大的语言知识和学习能力,可以生成自然语言文本、回答问题、完成任务等。这些模型通常使用深度学习技术,特别是递归神经网络(RNN)、卷积神经网络(CNN)或变换器架构(如GPT、BERT等)等。大语言模型之所以称为“大”,是因为它们具有巨大的参数数量,通常以数亿到数万亿的参数为基础构建。这些参数用来存储语言模型的知识,包括语法、语义、常识和文化背

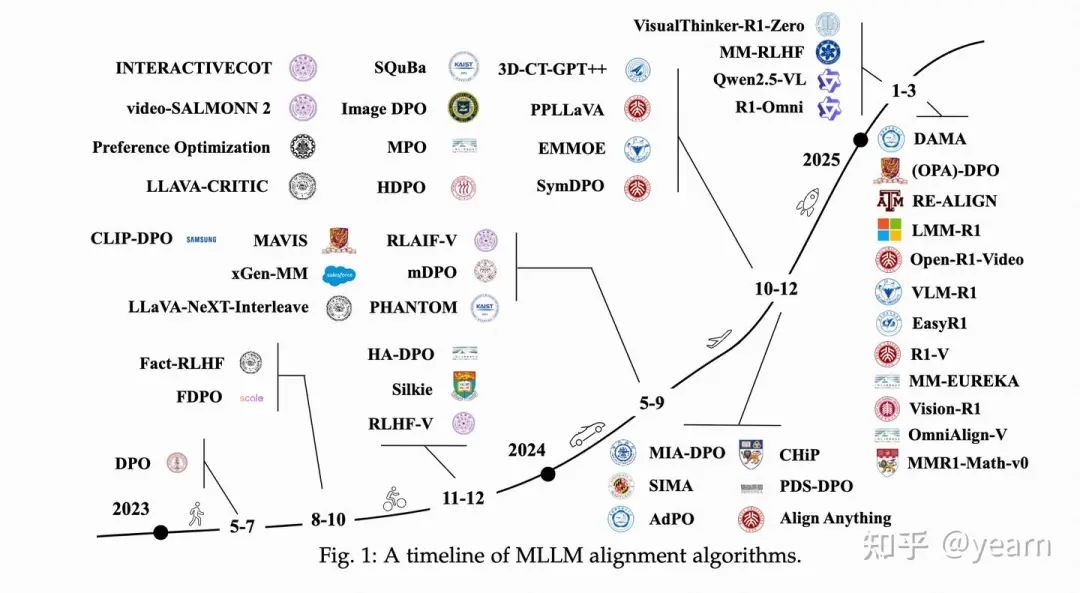

在多模态大型语言模型(MLLM)的研究中,对齐数据集是关键组成部分。由于多模态数据集的构建涉及到大量的数据来源、生成方法和注释技术,研究者们对不同构建方法进行了分类。这些数据集大致可以分为两类:引入外部知识的数据集和依赖自我标注的数据集。通过这些分类,研究者可以更清晰地了解不同数据集的特点,进而为多模态系统的优化提供支持。我们对现有MLLM对齐数据集进行了全面的分类与分析,详细介绍了不同构建方法的

↑↑↑ 点击关注,分享IT技术|职场晋升技巧|AI工具DeepSeek的成功已验证AI的强大,拥抱它不再是选择,而是生存之道!对于资源有限的中小企业,!想知道如何零基础快速搭建,实现服务升级、效率翻倍?这篇,就是你弯道超车的起点!先说思路:利用开源平台Dify搭建RAG+智能体,然后将其嵌入到你的官方网站。最终效果是这样的。默认右下角会有一个小气泡,当我们点击它之后,就会出现一个如上图这样的聊天窗

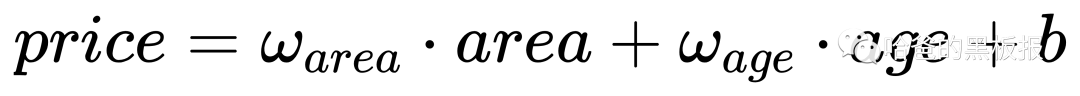

以下是一篇纯粹技术干货、深入到实现细节的万字长文,旨在从根本上解析大型语言模型(LLM)的工作原理。我们来直接解剖LLM的核心——Transformer架构,并系统性地阐述其从零开始的训练过程,以及当前最前沿的优化与扩展技术。现代所有最先进的LLM,无论其名称或开发者,其根基都是2017年提出的Transformer架构。理解Transformer,就是理解LLM的第一性原理。其设计的核心在于,通

Langchain-Chatchat是一个基于ChatGLM大语言模型与Langchain应用框架实现,开源、可离线部署的检索增强生成(RAG)大模型的本地知识库问答应用项目。

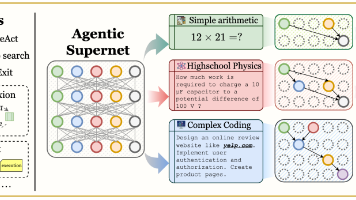

在本文中,多智能体系统设计的范式从“寻找最优的单个系统”,转变为“优化一个系统的动态分布”。所提出的MaAS框架,通过其核心的“智能体超网”概念,实现了对不同任务的“量体裁衣”,在大幅提升资源效率的同时,取得了SOTA的性能表现。我们相信,MaAS为构建更通用、更经济、更智能的自动化AI系统铺平了道路。

大语言模型(LLM)用于理解和生成自然语言和编程语言的人工智能模型。它可以帮助完成适用程度和成本效率不同的各种任务。本文通过测试来自同一基础模型的多个独立模型,以找到最佳的大语言模型。这一技术领域发展迅猛,尽管本文已尽可能保持时效性,也还是需要读者随时关注最新发布的模型,根据成本效益判断该模型是否更佳。官方网站:https://openai.com/图片来源:Unsplash。