简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

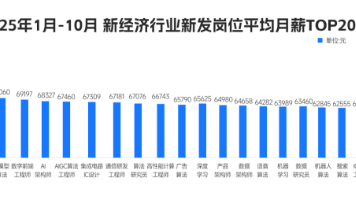

我在一线科技企业深耕十二载,见证过太多因技术卡位而跃迁的案例。那些率先拥抱 AI 的同事,早已在效率与薪资上形成代际优势,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑。✅从入门到精通的全套视频教程✅AI大模型学习路线图(0基础到项目实战仅需90天)✅大模型书籍与技术文档PDF✅各大厂大模型面试题目详解✅640套AI大模型报告合集✅大模型入门实

我在一线科技企业深耕十二载,见证过太多因技术卡位而跃迁的案例。那些率先拥抱 AI 的同事,早已在效率与薪资上形成代际优势,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑。✅从入门到精通的全套视频教程✅AI大模型学习路线图(0基础到项目实战仅需90天)✅大模型书籍与技术文档PDF✅各大厂大模型面试题目详解✅640套AI大模型报告合集✅大模型入门实

摘要: 2026年RAG面试重点在于深入理解技术选型与权衡,而非仅会使用工具。核心考察六大模块:检索全链路、混合检索与重排序、评估体系、幻觉治理、生产工程及前沿方向。关键问题包括: RAG全链路:七步流程中每一步的决策依据(如分块策略选择); 架构演进:从Naive RAG到Agentic RAG的迭代逻辑,需权衡成本与效果; 分块优化:根据文档类型选择策略(递归切分、滑动窗口等),Late Ch

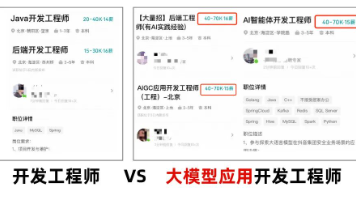

如果说AI大模型是蕴藏着巨大能量的“后台超级能力”,那么AI大模型应用开发工程师就是将这种能量转化为实用工具的执行者。AI大模型应用开发工程师是基于AI大模型,设计开发落地业务的应用工程师。这个职业的核心价值,在于打破技术与用户之间的壁垒,把普通人难以理解的算法逻辑、模型参数,转化为人人都能轻松操作的产品形态。

本文介绍了MCP(Model Context Protocol)协议及其实现方法。MCP作为AI领域的"USB接口",解决了工具接入需要重复适配的问题。主要内容包括:1)MCP的核心价值是标准化AI应用与工具间的交互;2)通过Python代码演示了MCP Server的实现,包括工具注册和请求处理;3)展示了MCP Client如何连接多个Server并统一调用工具。该协议使业务团队能独立开发工具

这篇文章详细介绍了如何从零开始训练自己的大语言模型(LLM)。项目通过PyTorch实现GPT风格模型,涵盖Tokenizer、Self-Attention、Transformer等核心组件,不依赖黑盒框架。文章强调亲手训练LLM的重要性,指出LLM本质是预测下一个词的概率模型,并解释Transformer的突破性在于并行计算的注意力机制。项目逐步演示了文本处理到模型训练的完整流程,包括分词、词向

本文系统阐述了编排工程的七层架构设计,将AI模型的应用流程划分为输入处理(认知层、工具层、契约层)、模型核心(LLM Core)、执行控制(编排层、记忆与状态层)和输出验证(评估层、约束与恢复层)四个阶段。通过Claude Code的实例分析,展示了如何通过外部架构设计显著提升模型表现,并提炼出四大核心原则:用代码约束替代指令、状态外部化、每步可验证、实现局部容错。该架构为优化AI应用提供了系统化

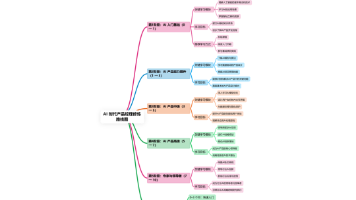

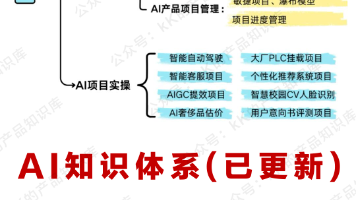

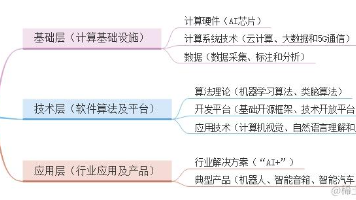

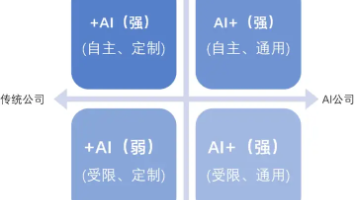

本文深入探讨了AI产品经理的核心特质,强调AI思维的重要性。文章解析了人工智能产品设计的原则,即简单操作背后是复杂系统支持。同时,详细阐述了人工智能产业链的三层结构:基础层(计算硬件、系统技术、数据)、技术层(算法、平台、应用技术)和应用层(行业解决方案、典型产品)。文章还分析了AI产品经理的四象限分类,包括突破型、创新型、应用型和普及型,并指出了AI产品经理能力提升的关键点,如明确自身定位、避免

本文系统分析了AI产品经理与传统产品经理的异同,指出AI产品经理需额外掌握AI技术、算法及数据理解能力。文章详细阐述了AI产品经理的核心技能要求,包括AI应用场景理解、数据重要性认知及评价指标熟悉度,并提供了转行建议:学习Python、机器学习等基础知识,通过实操项目积累经验。研究显示,掌握AI工具可带来34%的薪资溢价。文章还提出大模型学习的四阶段进阶路径(基础应用、RAG开发、Agent架构、

AI Agent元年:2026年趋势与机遇 2026年被视为AI Agent元年,随着GPT-5等技术的突破,AI Agent将实现自主规划、工具调用和长期记忆等核心能力,市场规模预计达500亿美元。其应用场景涵盖个人助理(如健康管理、投资顾问)、企业服务(如智能客服、销售转化)及垂直行业创新。主流平台如Manus、Coze等加速发展,但同时也面临安全风险、高成本和可靠性挑战。AI Agent技术