简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

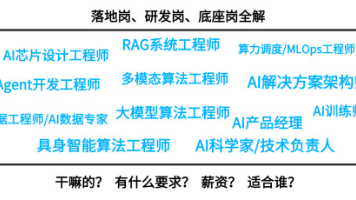

2026年技术圈的分化愈发明显:降薪裁员潮持续蔓延,传统开发、测试等岗位大批缩水,不少从业者陷入职业焦虑;与之形成鲜明对比的是,AI大模型相关岗位迎来疯狂扩招,薪资逆势飙升150%,大厂更是直接开出70-100W年薪,疯抢具备实战能力的大模型人才,甚至放宽年龄限制,只求能快速落地技术、创造价值!1、窗口期红利,入门门槛友好:不同于成熟赛道的“内卷式招聘”,2026年大模型人才缺口巨大,简历只要达标

2026年技术圈的分化愈发明显:降薪裁员潮持续蔓延,传统开发、测试等岗位大批缩水,不少从业者陷入职业焦虑;与之形成鲜明对比的是,AI大模型相关岗位迎来疯狂扩招,薪资逆势飙升150%,大厂更是直接开出70-100W年薪,疯抢具备实战能力的大模型人才,甚至放宽年龄限制,只求能快速落地技术、创造价值!1、窗口期红利,入门门槛友好:不同于成熟赛道的“内卷式招聘”,2026年大模型人才缺口巨大,简历只要达标

2026年技术圈的分化愈发明显:降薪裁员潮持续蔓延,传统开发、测试等岗位大批缩水,不少从业者陷入职业焦虑;与之形成鲜明对比的是,AI大模型相关岗位迎来疯狂扩招,薪资逆势飙升150%,大厂更是直接开出70-100W年薪,疯抢具备实战能力的大模型人才,甚至放宽年龄限制,只求能快速落地技术、创造价值!1、窗口期红利,入门门槛友好:不同于成熟赛道的“内卷式招聘”,2026年大模型人才缺口巨大,简历只要达标

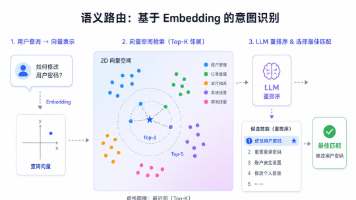

这一步让系统行为可预测、可调试、可监控。Agent 中的意图识别,已经从"分个类"演进为"理解任务结构"。代际方案核心思想第一代规则+关键词if-else 匹配第二代NLU分类softmax 分类第三代语义路由embedding 匹配,粗召回+精排第四代LLM驱动直接输出结构化 JSON第五代层次化+Planner任务结构提取 + 技能图路由而真正能上线的,是混合架构——规则兜底、向量召回、LLM

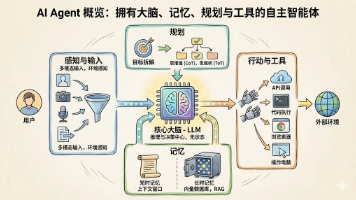

AI Agent(智能体),是能感知环境、自主推理决策并采取行动,最终实现既定目标的计算系统。传统 AI 多为被动响应模式,需等待人类下达具体指令,再处理输入数据并返回结果,这种模式被称为 “人机回圈”,整个过程的控制权完全由人类掌握。而 AI Agent 实现了从 “被动工具” 到 “主动代理” 的转变,它并非单纯的高性能搜索引擎或聊天机器人,而是具备主观能动性的数字实体。

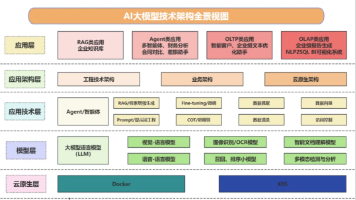

AI应用开发工程师,也常被称为大模型应用开发工程师,2026年核心定位更偏向“大模型落地赋能者”,核心职责是将OpenAI、Qwen、通义千问等主流大模型的技术能力,落地到企业实际产品和业务场景中,简单说就是“让大模型从‘实验室’走进‘业务端’,能用、好用、落地能产生价值”。这里必须重点区分(2026年招聘高频误区):它和AI算法岗完全是两个赛道——算法岗侧重“造模型”,专注于大模型的底层研发、参

很多后端同行转型,不是不够努力,而是没人指路,盲目跟风学错方向,浪费时间还打击信心。我从Java后端转型AI应用,踩过无数坑,也帮10+同行成功转型,深知转型路上的迷茫和难点—— 不知道该学什么、该练什么,遇到卡点没人解答,面试不知道怎么准备。2026年技术圈的分化愈发明显:降薪裁员潮持续蔓延,传统开发、测试等岗位大批缩水,不少从业者陷入职业焦虑;与之形成鲜明对比的是,AI大模型相关岗位迎来疯狂扩

很多后端同行转型,不是不够努力,而是没人指路,盲目跟风学错方向,浪费时间还打击信心。我从Java后端转型AI应用,踩过无数坑,也帮10+同行成功转型,深知转型路上的迷茫和难点—— 不知道该学什么、该练什么,遇到卡点没人解答,面试不知道怎么准备。

2026年技术圈的分化愈发明显:降薪裁员潮持续蔓延,传统开发、测试等岗位大批缩水,不少从业者陷入职业焦虑;与之形成鲜明对比的是,AI大模型相关岗位迎来疯狂扩招,薪资逆势飙升150%,大厂更是直接开出70-100W年薪,疯抢具备实战能力的大模型人才,甚至放宽年龄限制,只求能快速落地技术、创造价值!1、窗口期红利,入门门槛友好:不同于成熟赛道的“内卷式招聘”,2026年大模型人才缺口巨大,简历只要达标

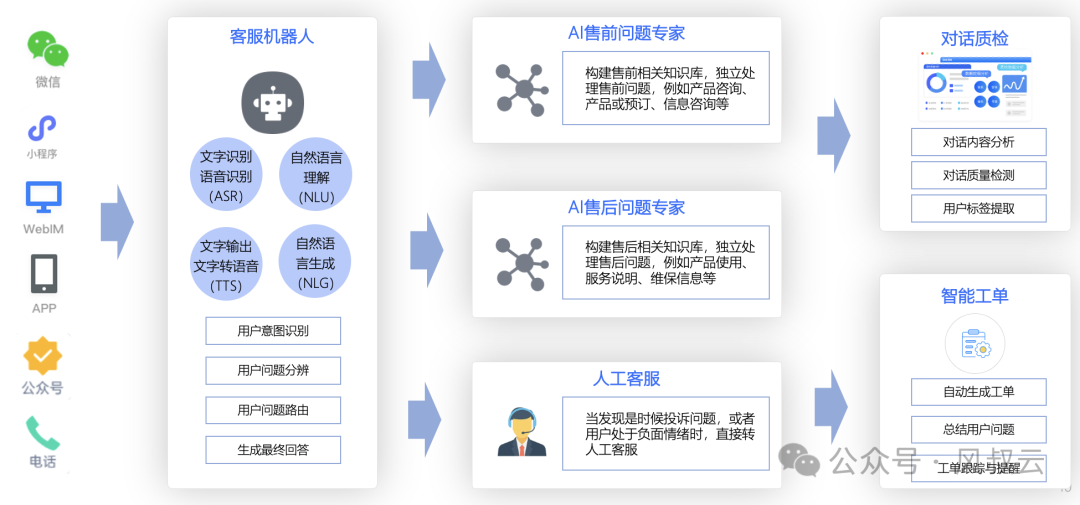

本篇文章,我们重点围绕客服场景,详细介绍如何通过AI 大模型替代传统智能客服系统。传统智能客服系统主要包括知识库、机器人、人工坐席、智能质检、工单管理等核心模块。虽然智能客服已经是一个发展了很多年的成熟领域,但仍然面临非常多的痛点。