简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本报告对当前主流AI大模型在纯文本理解场景下的性能进行系统评估,涵盖DeepSeekV4、GLM-5、Qwen3.5等10款模型。DeepSeekV4-Pro以1M上下文、88.7 MMLU得分成为开源天花板;GLM-5在AAIntelligenceIndex获50分,与ClaudeOpus4.5同级;Qwen3.5-397B以91.5 MMLU得分居开源第一。报告建议:追求性能选DeepSeek

2026年主流编程大模型横向评测:DeepSeek V4-Pro以1.6T参数和1M上下文窗口展现全能表现,MiniMax M2.5以80.2% SWE-bench得分和100TPS推理速度成为性价比之王,GLM-5.1以58.4% SWE-benchPro得分创开源纪录,Qwen3-Coder-30B专注代码生成,Kimi-K2擅长思维链推理,MiniMax M2.7强化多智能体协作能力。评测涵

本文系统解析了AIAgent工程化的三代技术演进。第一代Prompt Engineering通过优化提示词解决基础交互问题;第二代Context Engineering通过上下文管理解决信息边界问题;第三代Harness Engineering构建完整工程框架,实现任务规划、执行评估和安全管控的三层闭环架构。文章详细阐述了三代技术的核心方法、适用场景及相互关系,并分享了全球大厂的成功案例。

本文系统解析了AIAgent工程化的三代技术演进。第一代Prompt Engineering通过优化提示词解决基础交互问题;第二代Context Engineering通过上下文管理解决信息边界问题;第三代Harness Engineering构建完整工程框架,实现任务规划、执行评估和安全管控的三层闭环架构。文章详细阐述了三代技术的核心方法、适用场景及相互关系,并分享了全球大厂的成功案例。

RSE(检索增强摘要生成)流程通过五个关键步骤实现高效信息提取:数据切分将文档分段向量化;相似度筛选保留高相关片段;上下文窗口查找捕捉边界信息;片段总值计算量化整体相关性;阈值筛选确定最终高相关片段。文章结合案例和Python代码示例,展示了该流程在信息检索和摘要生成中的应用优势,并展望了通过优化切分策略、相似度计算和机器学习算法进一步提升其性能的可能性。RSE流程为处理海量文本数据提供了精准高效

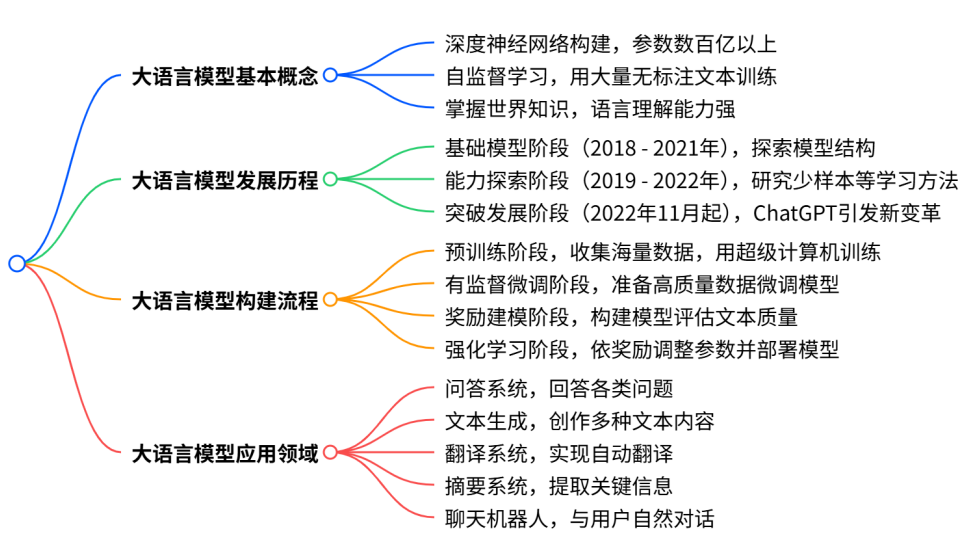

在自然语言处理(NLP)领域,大规模语言模型(Large Language Models, LLM)正引领着一场技术革命。这些模型以其庞大的参数规模、强大的语言理解能力和广泛的应用场景,成为人工智能研究与应用中的一颗璀璨明星。本文将深入探讨LLM的基本概念、发展历程、构建流程以及其在多个领域的应用。

阿里通义千问Qwen3.5-Plus技术测试报告显示,该模型采用稀疏MoE、混合注意力和原生多模态三大创新架构,397B总参数仅激活17B,实现高效部署。实测验证其性能超越GPT-5.2等闭源模型,256K长文本处理速度提升19倍,多模态识别准确率达98%,Agent任务完成率100%,且百万Token成本仅0.8元。报告证实Qwen3.5在架构效率、多模态融合和场景落地方面表现优异,为中小企业提

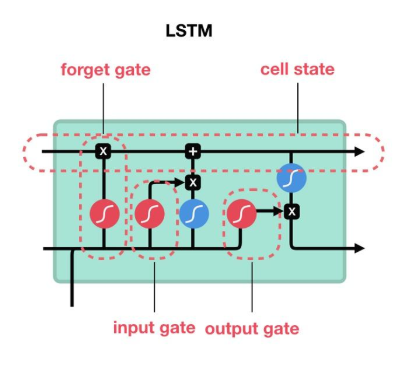

循环神经网络(RNN)为处理序列数据提供了基础框架,但其在长序列处理上的局限性促使了长短期记忆网络(LSTM)和门控循环单元(GRU)的诞生。LSTM 通过精细的门控机制和细胞状态,有效地解决了梯度问题,能够处理复杂的长序列数据。GRU 则在保持一定性能的同时,通过简化结构提高了训练效率。在实际应用中,我们需要根据具体任务的特点和需求,选择合适的模型。希望通过本文的介绍,你对 RNN、LSTM 和

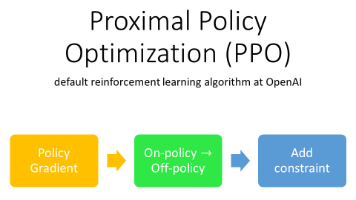

在大模型与强化学习交叉的技术领域面试中,PPO(Proximal Policy Optimization)和GRPO这两种算法常常成为面试官考察候选人对强化学习算法理解深度与工程实践能力的重点。今天,我们就从面试高频问题出发,深入剖析二者的核心差异。

Open-WebUI 是一款专为大模型设计的开源可视化交互工具,它通过类 ChatGPT 的直观界面,让用户无需代码即可管理、调试和调用本地或云端的大语言模型(LLMs),成为私有化部署的便捷工具,本文将介绍如何部署并使用Open-WebUI。