简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍了如何使用Streamlit快速构建交互式Web应用。主要内容包括:1)安装配置Streamlit基础环境;2)数据展示功能(标题、文本、表格、图片);3)表单组件(输入框、下拉菜单、文件上传等);4)页面布局设计(侧边栏、分栏、标签页);5)会话状态管理;6)流式输出实现;7)基于OpenAI API的智能问答机器人开发实例,包含API调用、对话历史维护和实时响应展示。通过具体代码示例,

本文介绍了使用Docker部署Weaviate向量数据库的步骤:1)创建数据存储目录并设置权限;2)通过cat命令生成docker-compose.yml配置文件,配置了华为云镜像、端口映射和数据卷;3)验证文件后启动容器,检查日志确认服务状态;4)最后通过curl命令测试API接口验证部署成功。文档提供了详细的命令和配置说明,包括数据目录权限设置、YAML文件生成方法及服务验证方式。

首次提交代码git add 文件名→git commit -m "备注"→git push 远程别名 分支名同步远程最新代码git pull 远程别名 分支名→ 解决冲突(如有)→git push 远程别名 分支名多分支开发git switch -c 功能分支→ 开发 →git switch 主分支→git merge 功能分支→git push避坑关键推送前先git pull,避免本地分支落后;

构建词汇表是将文本Token转换为整数索引的关键步骤,主要流程包括:统计Token频率、定义特殊Token、筛选普通Token并分配索引。特殊Token(如<PAD>、<UNK>)需固定索引,普通Token根据频率排序分配。词汇表大小可限制以控制模型复杂度,低频Token映射为<UNK>。最终通过词汇表实现Token到索引的映射,同时需保存词汇表以便复用。整个过

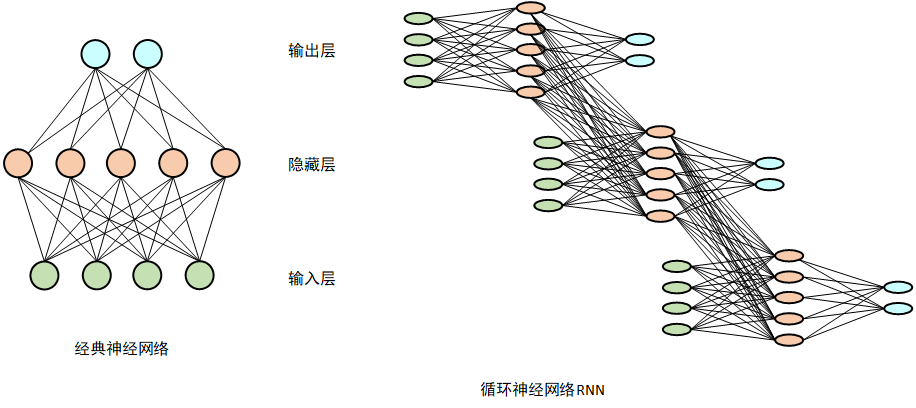

文章摘要:嵌入层(Embedding)是将离散整数索引转换为连续稠密向量的关键模块,解决了整数索引离散无语义和维度不匹配的问题。其本质是一个可学习的参数矩阵,通过查表方式将索引映射为固定维度的语义向量。相比独热编码,嵌入层具有维度低、能学习语义关联的优势。嵌入层与RNN配合时,输出三维张量可直接作为RNN输入。工程实践中需注意特殊Token处理、预训练词向量加载、维度选择等关键细节。嵌入层通过反向

传统机器学习与大语言模型(LLM)存在本质差异:传统ML是"专项智能",依赖少量标注数据,模型简单(如决策树),针对特定任务(如图像识别);而LLM是"通用智能",通过海量无监督文本学习,采用复杂Transformer架构(如GPT-4万亿参数),具备语言理解、生成、推理等综合能力。核心区别在于LLM能跨领域应用(聊天、写作、编程等),采用生成式推理,但可解

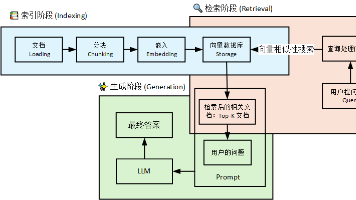

文本分割是RAG流程中的关键步骤,主要解决长文档处理、检索质量和语义完整性问题。LangChain框架提供了专业化的文本分割工具,支持多种文档类型,通过chunk_size、chunk_overlap等参数控制分割粒度。分割后的文本块保留元数据,便于后续向量化和检索。合理分割能提升检索精度,避免信息丢失或冗余,是构建高效RAG系统的基础。

大语言模型存在幻觉、信息过时、专业不足和推理薄弱等问题。RAG(检索增强生成)技术通过构建"专属智能图书馆"来解决这些问题。其工作流程分为离线准备(数据切分和向量化建库)和在线问答(检索相似资料并生成答案)两个阶段。RAG让AI在回答前先检索相关最新或专属资料,确保答案准确有依据,避免胡编乱造。该技术可应用于需要时效性、专业性或私密性的场景,显著提升AI回答质量。

《提示词工程手册》摘要:提示词工程是通过结构化设计提示词(Prompt)来优化大模型输出的方法论,涵盖指令、上下文、示例和输出约束等要素。它连接人类需求与大模型能力,适用于自然语言处理、代码开发、数据分析等多场景。手册系统讲解从基础到高阶的提示词设计技巧,包括核心原则(清晰具体、角色设定、逻辑分层等)、进阶方法(Few-shot、CoT、ToT等)及分场景实践(代码开发、SQL生成等)。同时提供模

摘要:Transformer架构是当前大语言模型(LLM)的核心基础,由Google团队在2017年提出,取代了传统的循环神经网络(RNN)。其核心创新在于:1)完全基于注意力机制,实现全局依赖捕捉;2)支持全并行计算,大幅提升训练效率;3)采用多头注意力设计,可同时建模不同维度的语义关联。原始Transformer采用编码器-解码器双塔结构,通过自注意力、前馈网络等模块堆叠实现序列建模。现代大模