简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

七、FastAPI:API服务的“高性能框架”#大模型#实战技巧#开源工具#模型量化#模型评估。六、Gradio:AI应用的“极速展示台”实战技巧:AI项目中常用的10个开源工具推荐。五、vLLM:大模型推理的“速度之王”八、MLflow:实验管理的“记账本”四、Ray:分布式训练的“调度大师”三、RAG系统的“数据管家”一、模型库的“一站式商店”二、大模型应用的“脚手架”九、模型服务的“体检中心

数据可视化#Tableau#Python#数据准备。数据可视化实战:用AI工具制作专业数据分析图表。

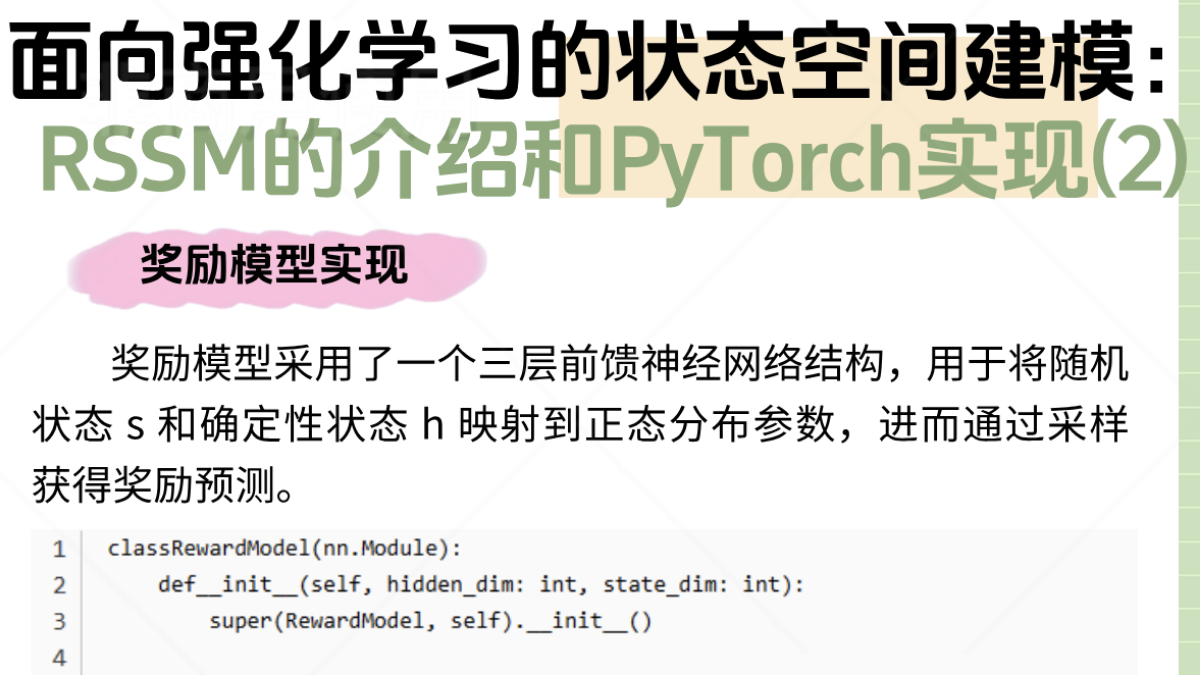

面向强化学习的状态空间建模:RSSM的介绍和PyTorch实现(2)三、RSSM 整体架构。

人工智能#具身智能#VLA#大模型#AI#LLM#Transformer 架构#AI技术前沿#Agent大模型#工信部证书#人工智能证书#职业证书。DNN案例一步步构建深层神经网络。二、应用的包import。一、总体目标与大致结构。

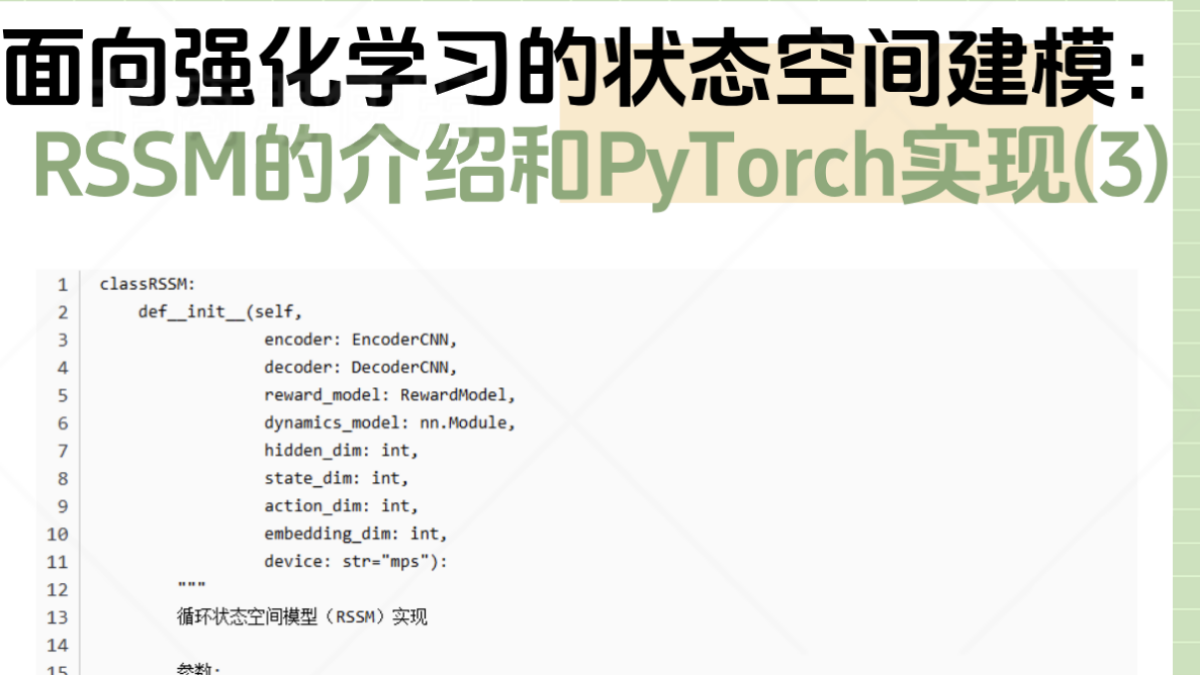

面向强化学习的状态空间建模:RSSM的介绍和PyTorch实现(3)面向强化学习的状态空间建模:RSSM的介绍和PyTorch实现(3)一、RSSM 整体架构。三、经验回放缓冲区实现。

Transformer是一种基于自注意力机制(Self-Attention)的神经网络架构,最早是在2017年由谷歌大脑团队Ashish Vaswani和多伦多大学的一个团队发表的一篇名为"Attention is All You Need"的论文中描述的。与传统的循环神经网络(RNN)不同,Transformer能够并行处理序列中的所有位置,通过注意力权重矩阵捕获任意距离的依赖关系。其中,编码组

五、 未来方向:迈向“ grounded ”的大模型。#世界模型#具身智能#因果推理#动态系统#内部模拟。三、 世界模型的构建路径:从文本到具身。世界模型视角下的大模型认知边界。四、 大模型的认知边界在哪里?二、 大模型有世界模型吗?一、 什么是世界模型?

三、如何找到 LoRA 模型。二、深入剖析LoRA 模型。大模型-LORA模型详解。四、如何使用 LoRA?

人工智能#具身智能#VLA#大模型#AI#LLM。4.向量数据的应用-RAG技术。1.为什么需要向量数据库。向量数据库拥抱大模型。

3.2 可学习的嵌入 (Learnable Embedding)大模型-详解 Vision Transformer (ViT)3.3 位置嵌入 (Position Embeddings)3.1 图像块嵌入 (Patch Embeddings)3.4 Transformer 编码器。3.5 ViT 张量维度变化举例。3.6 归纳偏置与混合架构。3.7 微调及更高分辨率。