简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

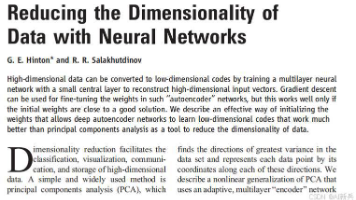

2006-2012年深度学习迎来关键突破期。2006年Hinton团队提出深度信念网络(DBN),通过分层预训练策略有效解决了深层网络训练难题,奠定理论基础。2012年AlexNet在ImageNet竞赛中以显著优势获胜(错误率15.3% vs 26.2%),其创新性采用GPU并行计算、ReLU激活函数、Dropout和数据增强等技术,引爆了深度学习革命。这两项里程碑式成果分别从理论方法和实际应用

摘要:20世纪80-90年代,深度学习迎来重要突破。杨立昆提出首个商用卷积神经网络LeNet-5,在手写数字识别上取得突破。同时,为解决序列数据处理问题,研究者提出循环神经网络(RNN)及其改进版LSTM、GRU。然而这一时期的AI发展并非一帆风顺,专家系统的商业化失败导致第二次AI寒冬(1987-1993),神经网络研究虽继续但进展缓慢。这些技术突破为21世纪深度学习的爆发奠定了基础。

摘要:20世纪80-90年代,深度学习迎来重要突破。杨立昆提出首个商用卷积神经网络LeNet-5,在手写数字识别上取得突破。同时,为解决序列数据处理问题,研究者提出循环神经网络(RNN)及其改进版LSTM、GRU。然而这一时期的AI发展并非一帆风顺,专家系统的商业化失败导致第二次AI寒冬(1987-1993),神经网络研究虽继续但进展缓慢。这些技术突破为21世纪深度学习的爆发奠定了基础。

GPT系列是由OpenAI开发的专注于语言生成的AI模型,基于Transformer解码器架构,采用单向预训练方法。从GPT-1(2018)确立"预训练+微调"范式,到GPT-2(2019)实现零样本学习,再到GPT-3(2020)展现1750亿参数的强大上下文学习能力。ChatGPT(2022)通过对话优化和人类反馈强化学习实现类人交互,GPT-4(2023)则突破多模态理解和复杂推理。最新的G

2010年代深度学习迎来产业应用爆发期,"深度学习三巨头"Hinton、LeCun和Bengio的突破性贡献获得2018年图灵奖。AlexNet(2012)和ResNet(2015)推动计算机视觉发展,GAN(2014)为AIGC奠定基础,TensorFlow/PyTorch等框架降低开发门槛。AlphaGo(2016)战胜李世石成为公众关注里程碑,展示了深度学习在复杂决策中的能力。这些突破推动深

2014年,伊恩・古德费洛在蒙特利尔小酒馆灵光一闪,提出让两个神经网络互相对抗的构想,由此诞生了改变AI领域的生成对抗网络(GANs)。这一技术通过生成器与判别器的对抗训练,实现了从随机噪声生成逼真图像的能力。从最初的DCGAN到后来的StyleGAN,GANs技术不断演进,在图像生成、艺术创作、医学影像等领域展现出惊人创造力。在大模型时代,GANs与Transformer等技术的融合进一步拓展了

GPT系列是由OpenAI开发的专注于语言生成的AI模型,基于Transformer解码器架构,采用单向预训练方法。从GPT-1(2018)确立"预训练+微调"范式,到GPT-2(2019)实现零样本学习,再到GPT-3(2020)展现1750亿参数的强大上下文学习能力。ChatGPT(2022)通过对话优化和人类反馈强化学习实现类人交互,GPT-4(2023)则突破多模态理解和复杂推理。最新的G

GPT系列是由OpenAI开发的专注于语言生成的AI模型,基于Transformer解码器架构,采用单向预训练方法。从GPT-1(2018)确立"预训练+微调"范式,到GPT-2(2019)实现零样本学习,再到GPT-3(2020)展现1750亿参数的强大上下文学习能力。ChatGPT(2022)通过对话优化和人类反馈强化学习实现类人交互,GPT-4(2023)则突破多模态理解和复杂推理。最新的G

摘要:20世纪80-90年代,深度学习迎来重要突破。杨立昆提出首个商用卷积神经网络LeNet-5,在手写数字识别上取得突破。同时,为解决序列数据处理问题,研究者提出循环神经网络(RNN)及其改进版LSTM、GRU。然而这一时期的AI发展并非一帆风顺,专家系统的商业化失败导致第二次AI寒冬(1987-1993),神经网络研究虽继续但进展缓慢。这些技术突破为21世纪深度学习的爆发奠定了基础。

摘要:Transformer架构已成为现代大语言模型(如GPT、PaLM等)的核心基础,其并行计算、长距离依赖建模和灵活扩展性支撑了模型规模的持续扩大。关键技术突破包括混合专家模型(MoE)、稀疏注意力机制和位置编码改进,显著提升了效率和性能。同时,Transformer正拓展至多模态领域,成功应用于视觉、语音等任务。尽管面临部署挑战,但通过模型压缩、硬件加速和算法优化等方案持续推动应用落地。Tr