简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

因此, 除了最后一个报文之外,其他报文的长度必须是 8 的整数倍(否则报文就不连续了)。如果一个组织内部组建局域网,IP 地址只用于局域网内的通信,而不直接连到 Internet 上,理论上 使用任意的 IP 地址都可以,但是 RFC 1918 规定了用于组建局域网的私有 IP 地址。在复杂的网络结构中,找出一条通往终点的路线;4位首部长度:表名IP协议报头的长度,单位是4字节,所以IP协议报头的

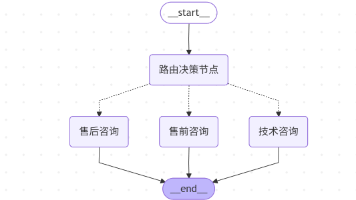

文章摘要:本文介绍了四种工作流模式在AI应用开发中的应用。1)提示链模式:通过串联节点实现内容创作流程(大纲→初稿→润色→终稿);2)并行化模式:同时执行市场、竞品、技术分析任务后汇总;3)路由模式:智能客服系统根据问题类型自动分流处理;4)协调者-工作者模式:协调者动态分配任务给工作者(如文档翻译)。这些模式通过LangGraph实现,展示了不同场景下的任务编排方式,从线性处理到动态任务分配,为

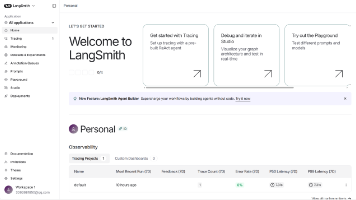

LangGraph 是 LangChain 生态中用于构建有状态、图驱动、支持循环 / 分支 / 多智能体协作的LLM工作流编排框架,核心是用「状态 + 节点 + 边」建模复杂 AI 流程,解决传统线性链难以处理的循环、多轮决策、多角色协作问题。在 LangChain 中,我们接入 LLM 构建的 AI 系统有以下特点:单次对话,“记不住”太多上下文主要是问答模式相对简单的任务以前用 LangCh

Kurator作为一款云原生管理工具,凭借其丰富的功能和灵活的架构,帮助开发者和企业简化了云原生应用的管理。本文通过多个示例详细展示了如何使用Kurator进行容器管理、跨云迁移、自动扩展等操作。无论是微服务应用的部署,还是跨云平台的资源管理,Kurator都提供了强大的支持,并且其活跃的社区和开源精神使其不断推动云原生技术的进步。

字典树通过。

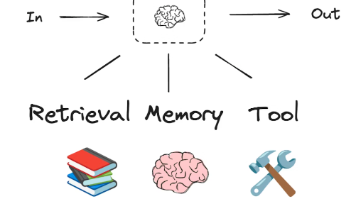

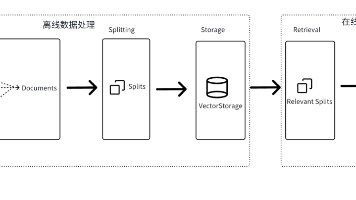

概念:RAG(Retrieval-Augmented Generation,检索增强生成)是当下 LLM 应用开发的核心技术范式,核心解决LLM 知识陈旧、幻觉、无法引用外部数据的问题 —— 简单说就是「先检索外部知识库中的相关信息,再让 LLM 基于这些信息生成回答」,而不是让 LLM 凭空「编造」内容。为了更好的理解 RAG,我们先用AI 搜索来引出 RAG。对于【AI 大模型】来说,它最擅长

一个简单的例子,假设我们想根据一个城市名询问 LLM 其历史,按照之前的做法,我们可以定义HumanMessage("请介绍上海的历史") 、 HumanMessage("请介绍西安的历史") 消息等等。在更复杂的场景下,我们可能会使用消息列表来跟踪状态,例如我们可能只想将这个完整消息列表的子集传递模型调用,而不是所有的历史记录。这使得与LLM 的交互从“模糊的文本对话”变成了“精确的数据 API

本文介绍了LangChain框架中聊天模型(LLM)的核心功能与应用。主要内容包括:1)聊天模型的定义与接口调用方式;2)LCEL语言用于组件编排;3)参数控制(temperature、max_tokens);4)工具调用功能实现外部服务集成;5)结构化输出支持JSON/Pydantic等格式;6)流式输出技术实现实时响应;7)使用LangSmith平台进行应用监控和调试。文章通过代码示例详细演示

本文介绍了模型和大语言模型的基本概念与应用。模型本质上是学习数据规律的数学函数,通过输入输出关系完成特定任务。大语言模型(LLM)是基于大规模神经网络的语言模型,采用自监督或半监督方式训练,具备强大的文本生成能力。主流LLM包括GPT-5、DeepSeekR1等,可通过API、开源模型本地部署或SDK方式接入。此外,文章还阐述了嵌入模型的作用,它能将文本转换为数值向量,应用于语义搜索、推荐系统等场

开发环境:SQL Server 2022,Qt Creator 4.11.1 (Community)屏幕录制 2025-05-20 183909(1)应用系统背景随着互联网技术的发展,传统线下投票方式(如纸质投票、会议举手表决等)逐渐暴露出效率低、成本高、统计复杂、安全性差等问题。网上投票管理系统旨在通过数字化手段实现投票流程的自动化,支持多场景投票需求(如企业决策、校园活动、社会调研等),提供高