简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

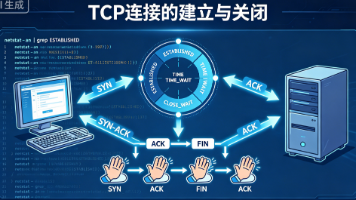

本文从Java开发者视角解析TCP三次握手和四次挥手机制。通过Socket连接实例,揭示了connect()、accept()、close()等操作背后的内核状态变化,重点分析了TIME_WAIT和CLOSE_WAIT状态的成因及影响。针对高并发场景下的端口耗尽问题,提出了设置SO_REUSEADDR、使用连接池等解决方案,并给出netstat排查命令和系统参数调优建议。文章特别强调finally

2026年Java开发者AI技能指南 摘要: 随着AI技术深入发展,Java在工程化领域的优势日益凸显。本文针对学生群体提出10个核心AI技能点:1)LLM原理与API调用;2)嵌入模型与向量化;3)RAG系统搭建;4)向量数据库应用;5)MCP协议实践;6)Agent技能开发;7)Agent编排设计模式;8)上下文记忆管理;9)GraphRAG技术;10)评估与可观测性。这些技能覆盖了从基础调用

《团队协作中的Git分支管理实践》摘要: 本文针对开发者从个人项目转向团队协作时遇到的Git管理问题,系统梳理了主流分支策略与实践方案。核心要点包括:1)对比GitFlow、GitHubFlow和GitLabFlow三种模型的适用场景,小型团队推荐GitHubFlow的轻量级方案;2)详解merge与rebase策略的选择逻辑及冲突解决方法;3)提出分支命名规范、保护规则和Commit信息标准;4

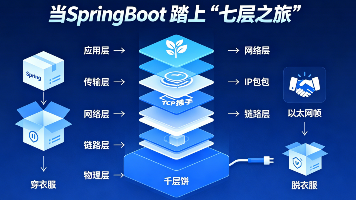

本文通过一个SpringBoot请求示例,生动解析了网络数据传输的封装过程。当浏览器发起GET请求时,数据会经历OSI七层模型的层层封装:从应用层的HTTP头添加、传输层的TCP封装、网络层的IP打包,到链路层的MAC地址包装。接收端则反向解封装,最终SpringBoot Controller获取原始JSON数据。文章对应Java组件详细说明了各层实现:@RestController处理应用层,S

本文探讨了限流算法的选择与实践经验。作者通过项目实践对比了滑动窗口和令牌桶两种主流限流算法:滑动窗口通过细分时间格实现精确控制,有效防止边界突刺,适合严格限制频率的场景;令牌桶则允许短时突发流量,适合需要弹性处理的场景。文章分析了阿里Sentinel选择滑动窗口的原因,并给出项目选型建议:严格防刷用滑动窗口,允许突发用令牌桶。最后强调限流应作为系统设计的必要环节,即使当前QPS不高,也要防范恶意攻

摘要:本文探讨了I/O多路复用技术在AI Agent并发调用外部工具中的应用。传统多线程方案会导致线程爆炸,而借鉴操作系统epoll机制的事件驱动模型能有效解决这一问题。文章对比了select/poll/epoll的演进过程,分析了Java NIO和Netty的实现原理,并将其思想映射到Agent工具调度场景。通过单线程事件循环+异步回调的设计,Agent可以高效管理多个并发工具调用,避免线程资源

摘要:本文探讨了I/O多路复用技术在AI Agent并发调用外部工具中的应用。传统多线程方案会导致线程爆炸,而借鉴操作系统epoll机制的事件驱动模型能有效解决这一问题。文章对比了select/poll/epoll的演进过程,分析了Java NIO和Netty的实现原理,并将其思想映射到Agent工具调度场景。通过单线程事件循环+异步回调的设计,Agent可以高效管理多个并发工具调用,避免线程资源

摘要:本文探讨了I/O多路复用技术在AI Agent并发调用外部工具中的应用。传统多线程方案会导致线程爆炸,而借鉴操作系统epoll机制的事件驱动模型能有效解决这一问题。文章对比了select/poll/epoll的演进过程,分析了Java NIO和Netty的实现原理,并将其思想映射到Agent工具调度场景。通过单线程事件循环+异步回调的设计,Agent可以高效管理多个并发工具调用,避免线程资源

ClaudeCode源码泄露事件揭示了AI编程工具的核心架构设计。2026年3月,Anthropic意外泄露了包含51万行TypeScript代码的ClaudeCode源代码,暴露了其多Agent系统的实现细节。文章分析了三个关键架构模式:Orchestrator-Worker模式实现任务分发、ReAct范式支持单Agent循环推理、KAIROS机制提供后台常驻能力。作者基于泄露的架构设计,在Ja

2026年AI编程工具三巨头对比:Cursor、ClaudeCode和OpenClaw各有侧重。Cursor是嵌入式AI IDE,擅长代码补全和实时协作;ClaudeCode作为终端代理,对复杂项目理解力强,适合架构级重构;OpenClaw则是任务执行中枢,能真正操作电脑完成任务。三者互补而非替代:Cursor提升日常编码效率,ClaudeCode处理深度代码分析,OpenClaw实现自动化执行。