简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

BLIP-2通过利用预训练的视觉模型和语言模型来提升多模态效果和降低训练成本,预训练的视觉模型能够提供高质量的视觉表征,预训练的语言模型则提供了强大的语言生成能力。如下图所示,由一个预训练的,一个预训练的和一个可学习的Q-Former组成。image.png:负责从输入图片中提取视觉特征。:负责文本生成。Q-Former:负责弥合视觉和语言两种模态的差距,由和两个子模块构成,它们共享相同自注意力层

官方提供了类似 GitHub,DockerHub 一般的,可类比理解为 ModelHub,用于存放大语言模型的仓库(有 llama 2,mistral,qwen 等模型,同时你也可以自定义模型上传到仓库里来给别人使用)。包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!观看零基础学习书籍和视频,看书籍和视频学习

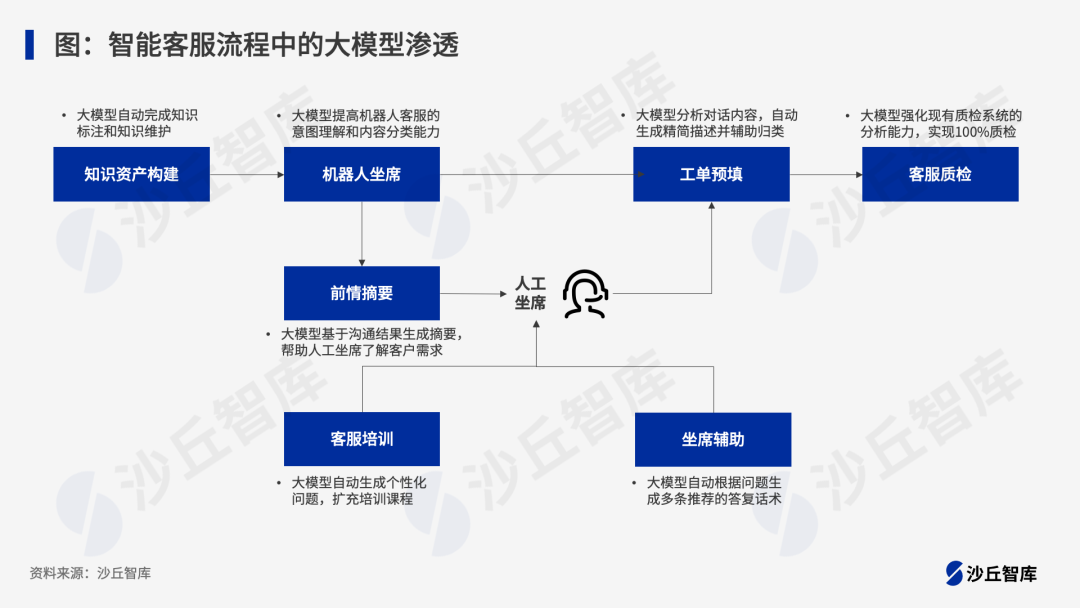

在数字化时代,客户服务的效率和质量直接影响到企业的品牌形象和客户满意度。随着大模型技术的兴起,智能客服系统正在经历一场新的变革。大模型已经在多个领域展现出强大的语言理解和生成能力。在智能客服场景中,这种能力被广泛应用于理解用户提出的问题、生成与用户需求匹配的回复,甚至是预测用户行为和提供个性化推荐。这不仅极大地提高了客户服务的效率和质量,还为企业节省了大量的人力和时间成本。从智能客服的完整流程来看

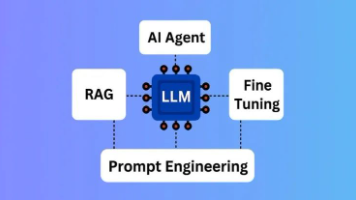

随着大语言模型(LLM)热潮兴起并在企业中的加速落地,其在自然语言处理(NLP)领域展现出强大的能力,已被广泛认可。然而,许多团队也逐渐意识到,仅依赖大模型本身仍存在一系列不可忽视的问题:

前排提示,文末有大模型AGI-CSDN独家资料包哦!大模型,通常指的是在人工智能领域中的大型预训练模型。你可以把它们想象成非常聪明的大脑,这些大脑通过阅读大量的文本、图片、声音等信息,学习到了世界的知识。这些大脑(模型)非常大,有的甚至有几千亿个参数,这些参数就像是大脑中的神经元,它们通过复杂的计算来理解和生成语言、图片等。举个例子,你可能听说过GPT-3,它就是一个非常著名的大模型。GPT-3可

随着大模型在人工智能领域的广泛应用,其背后的技术体系正变得愈发复杂与精细。从 Transformer 架构的性能优化,到多模态模型的交互设计,再到软硬件协同的高效实现,大模型系统的构建已不仅是单一技术的堆叠,而是跨越算法、硬件和系统架构的全方位整合。11 月 14-15 日,由 CSDN 联合高端 IT 咨询与教育平台 Boolan 举办的“2024 全球机器学习技术大会”特设了“大语言模型技术演

AI智能体,也被称为人工智能代理,人工智能智能体。AI智能体是一种计算机程序,它能够根据其环境、输入和预定义目标做出决策,自主执行任务。这些AI 智能体代表了传统自动化的飞跃,因为它们不仅被设计为遵循一组指令,而且能够独立思考、适应和行动。AI智能体是能够在无需人工干预的情况下执行任务的自主计算机程序。它们可以独立运作,也可以通过自然语言或其他通信模式与其他智能体或人类交互。设想一下,一个AI智能

微软亚洲研究院提出GMPO算法,将算术平均奖励优化转变为几何平均优化,有效抑制了异常值对大语言模型训练的影响。相比传统GRPO方法,GMPO具有更稳定的策略更新、更高的奖励、减少过拟合风险和更强的探索能力。实验证明,GMPO在多项语言与多模态推理任务中表现出更优的稳定性和整体性能,为强化学习在大语言模型中的应用提供了更可靠的解决方案。

现在有很多支持本地运行大预言模型的项目和使用知识库的项目或者平台,之所以想介绍ChatOllama是因为个人使用过后感觉比其他项目好用。特别是它的本地知识库,也就是RAG问答效果,是我到现在用过的几个知识库中能检索到信息最准确的

尽管LLMs在许多领域展示了卓越的性能,但它们仍存在一些问题,例如隐私、安全和公平等方面的挑战。未来的研究应着重于解决这些问题,以确保LLMs在更广泛的应用中发挥其最大潜力。