简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在这个日新月异的科技时代,机器学习作为人工智能领域的核心驱动力,正以前所未有的速度改变着我们的世界。从智能家居的个性化推荐到自动驾驶汽车的精准导航,从医疗诊断的辅助分析到金融市场的风险预测,机器学习技术以其强大的数据处理能力和自我优化特性,不断拓宽着人类认知与应用的边界。未来,我们有望看到更加智能、高效、人性化的机器学习应用不断涌现,为人类社会带来更多的便利和福祉。通过对用户行为数据的深度挖掘和分

联邦学习是一种分布式机器学习范式,其核心思想是利用分散在各参与方的数据集,通过隐私保护技术融合多方数据信息,协同构建全局模型。在模型训练过程中,各参与方仅交换模型参数、梯度等中间结果,而本地训练数据则不会离开本地,从而大大降低了数据泄露的风险。自治和联合。自治:各参与方在本地使用自己的数据进行模型训练,得到各自的模型参数。联合:各参与方将本地训练的模型参数上传至中心服务器(或采用去中心化方式),中

大模型作为人工智能领域的重要技术之一,其魅力不仅在于卓越的性能和广泛的应用前景,更在于推动技术进步和引领未来发展的潜力。通过不断的研究和创新,我们可以克服当前面临的挑战,推动大模型技术的不断发展和进步。

FFmpeg是一个开源、跨平台的多媒体处理工具和开发库,用于录制、转换、流式传输音频和视频。它支持几乎所有常见的音视频格式,并且功能强大,是许多音视频软件和平台(如 YouTube、VLC、Blender 等)的核心依赖。接下来我们开始安装。

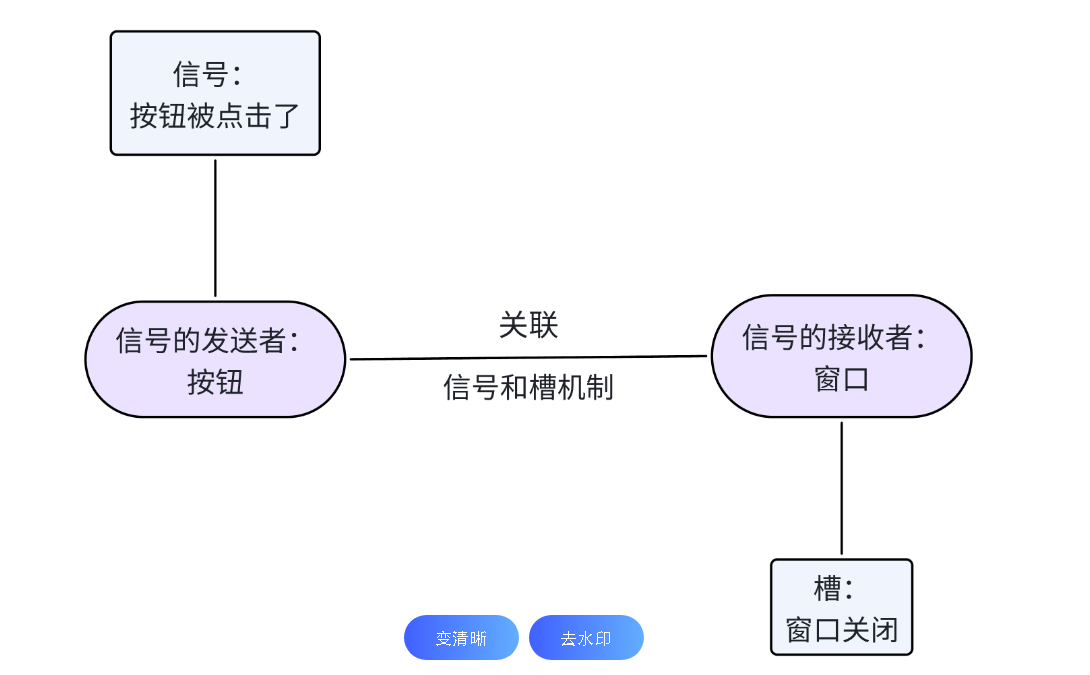

信号与槽机制是QT框架中最强大和独特的特性之一,它极大地简化了对象间的通信,特别是在GUI编程中处理用户交互事件时。QT的信号与槽机制是其核心特性之一,提供了一种强大的对象间通信方式,比传统的回调函数更加灵活和安全。

很多应用程序都具备操作文件的能力,包括对文件进行写入和读取,创建和删除文件等等,甚至某些应用程序的就是为了操作文件,像WPS Office。与单独使用QFile类相比,QTextStream类提供了很多读写文件相关的方法,还可以设定写入到文件的数据格式,比如对齐方式,写入数据是否带前缀等等。与单独使用QFile类相比,QTextStream类提供了很多读写文件相关的方法,还可以设定写入到文件的数据

很多应用程序都具备操作文件的能力,包括对文件进行写入和读取,创建和删除文件等等,甚至某些应用程序的就是为了操作文件,像WPS Office。与单独使用QFile类相比,QTextStream类提供了很多读写文件相关的方法,还可以设定写入到文件的数据格式,比如对齐方式,写入数据是否带前缀等等。QFile类支持对文件进行读取和写入,删除,重命名,拷贝等常见的文件操作,它既可以操作文本文件,也可以用来操

在这个日新月异的科技时代,机器学习作为人工智能领域的核心驱动力,正以前所未有的速度改变着我们的世界。从智能家居的个性化推荐到自动驾驶汽车的精准导航,从医疗诊断的辅助分析到金融市场的风险预测,机器学习技术以其强大的数据处理能力和自我优化特性,不断拓宽着人类认知与应用的边界。未来,我们有望看到更加智能、高效、人性化的机器学习应用不断涌现,为人类社会带来更多的便利和福祉。通过对用户行为数据的深度挖掘和分