简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

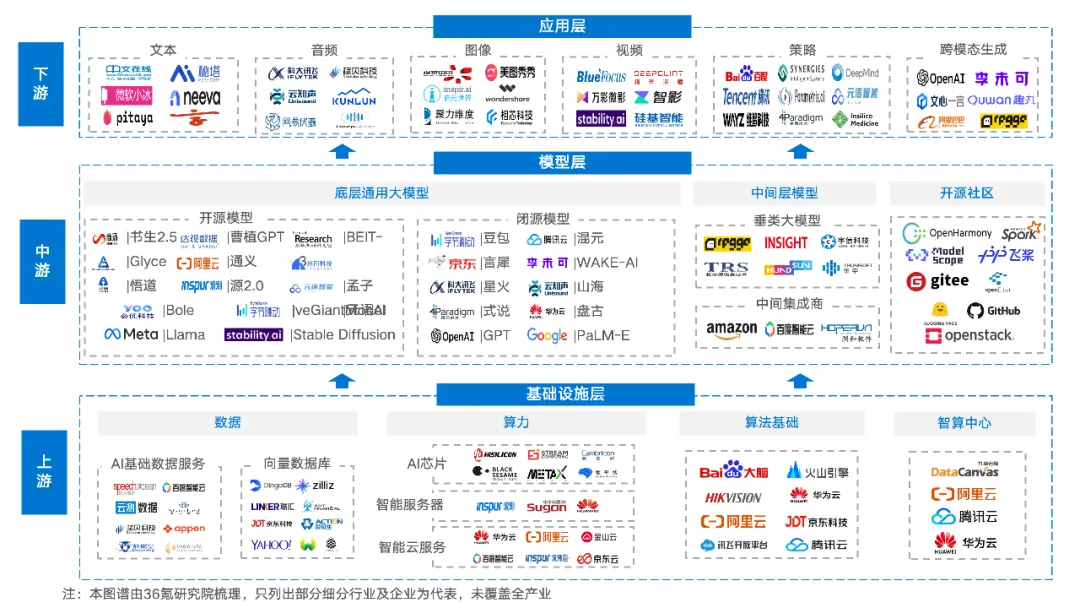

2024年2月,OpenAI发布其首款视频生成模型Sora,用户仅需输入一段文字即可生成长达一分钟场景切换流畅、细节呈现清晰、情感表达准确的高清视频,与一年前的AI生成视频相比,在各维度均实现了质的提升。这一突破再次将AIGC推向大众视野。AIGC即通过大量数据训练而成的人工智能系统,可根据用户的个性化指令生成文本、音频、图像、代码等内容。自2022年频频出圈的ChatGPT推出以来,生成式AI在

文章介绍如何使用Coze工作流搭建AI智能体,自动化生成历史故事视频。作者详细讲解工作流步骤并提供成品,降低学习门槛。通过AI工具,创作者可高效生产历史类短视频,解决创意和产出速度问题,适合想利用AI提高内容制作效率的人群。

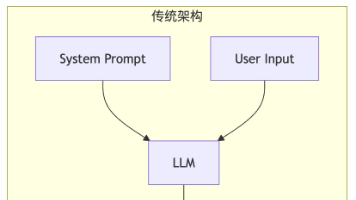

2023年,让整个人类最为振奋的AI技术就是ChatGPT。“大语言模型(Large Language Model)”这个词也随之映入人们的眼帘。ChatGPT让人觉得惊艳之处,能够结合上下文,像人一样有逻辑性地回答问题,就算生成超长的文本也不会跑偏。)是一种机器学习算法,它可以根据给定文本来预测下一个词语或字符的出现的概率,通过大量的文本数据来学习语言的统计特征,进而生成具有相似统计特征的新文本

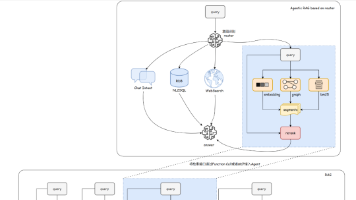

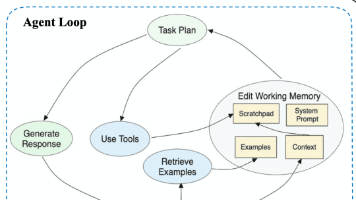

RAG(检索增强生成)是结合检索与生成的重要技术,适用于时效性强、算力有限的场景。文章详细介绍了其架构演进从简单RAG到Agentic RAG,涵盖索引构建、多路召回策略、Rerank模型和Embedding训练等技术。针对不同数据模态(语音、文本、图片)提出了处理方案,并讨论了效果评估方法和未来优化方向。RAG已成为连接LLM与知识库的基础设施,在Agent框架中发挥重要作用。

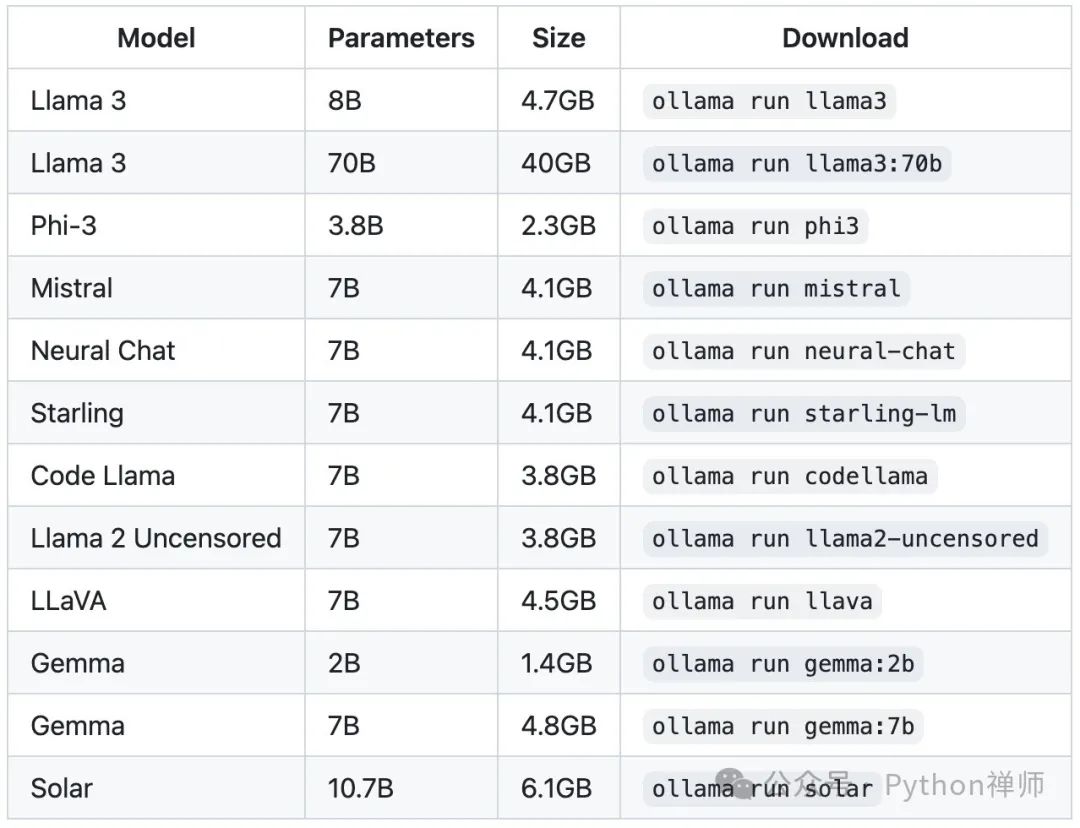

如何学习AI大模型?这段时间,随着 DeepSeek 影响力的持续破圈,各大算力平台和第三方都在积极支持并上线 DeepSeek。那除此之外,很多小伙伴也在自己的机器上尝试了 DeepSeek 的本地部署。那关于本地部署,之前我们曾分享过一篇文章,是有关 DeepSeek-R1 在本地部署的教程。当时评论区包括私信就有不少小伙伴咨询了有关 DeepSeek-R1 不同版本在部署时所对应的电脑配置要

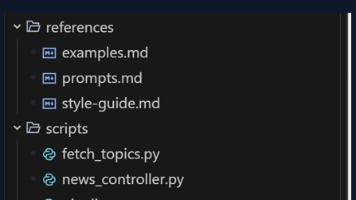

Google Antigrgravity支持Agent Skills功能,通过简单的SKILL.md文件指导AI完成任务。测试显示,Claude Code、Codex和Antigravity等平台在基础功能上表现一致。Skills具有三大价值:一次编写全平台通用、降低创作门槛、启动生态效应。随着模型能力增强和协议对齐,Skills可能开启大模型应用开发的新时代,就像早期App Store一样。

Claude的Skills机制是一种按需加载的专业知识模块,具有"用完即回收"特点,与传统工具调用和Multi-Agent架构有本质区别。Skills通过临时增强System Prompt实现Token效率的量级提升,同时保持单体架构的简单性。文章探讨了Skills与Sub-Agent的区别,提出了根据任务复杂度选择架构的原则,强调模块化是应对复杂性的根本策略,建议从简单开始渐进演进。

AI Agent是具备自主决策、规划和执行能力的数字实体,是2026年AI生态核心。主流架构包括感知、规划/推理、行动、记忆和反思/评估等组件。A2A协议促进Agent间协作,MCP标准化工具调用,Agent Skills实现能力模块化,使开发者能像搭乐高一样构建专业AI助手。

Anthropic推出的Agent Skills是一套可复用指令集,让AI Agent按需挂载能力,解决提示词痛点。Skills具有可组合、可移植、高效特点,已被OpenAI等主流工具兼容。国内特赞团队的skill0平台已聚合423个Skills,支持多款工具直接装配。Skills让AI从"能做事"走向"能按标准稳定做事",2026年或将成为规模化落地元年,国内团队在这场技术变革中并未缺席。