简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

从Dirty Pipe到Copy Fail,再到如今的Dirty Frag,Linux内核的页缓存机制似乎成了一个“漏洞富矿”。这并非意味着Linux不安全,而是揭示了操作系统在追求极致性能时,所面临的巨大安全挑战。对于运维人员和安全工程师来说,这无疑是一个必须修复的高危漏洞。但危机也是机遇,它促使我们重新审视自身系统的安全基线,加固每一道防线。记住,没有绝对安全的系统,只有不断进化的防御。希望本

从Dirty Pipe到Copy Fail,再到如今的Dirty Frag,Linux内核的页缓存机制似乎成了一个“漏洞富矿”。这并非意味着Linux不安全,而是揭示了操作系统在追求极致性能时,所面临的巨大安全挑战。对于运维人员和安全工程师来说,这无疑是一个必须修复的高危漏洞。但危机也是机遇,它促使我们重新审视自身系统的安全基线,加固每一道防线。记住,没有绝对安全的系统,只有不断进化的防御。希望本

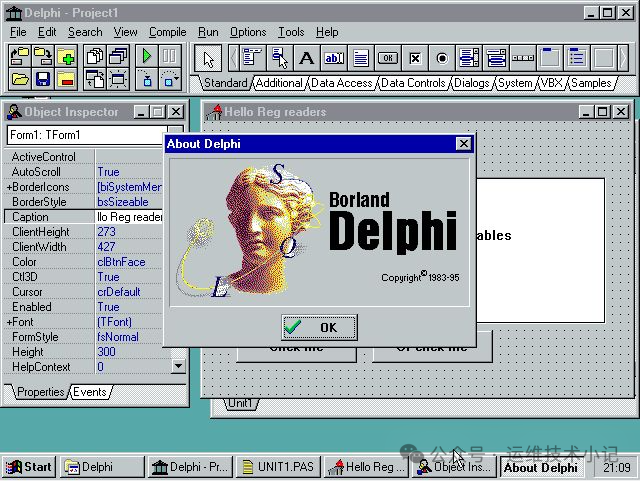

**.NET 平台支持**:推出了支持.NET 框架的版本,允许开发者使用 Delphi 编写基于.NET 的应用程序。- **设计模式和架构支持**:引入了一些新的设计模式和架构思想,如分层架构、MVC(模型 - 视图 - 控制器)模式等。- **AI 与机器学习集成**:随着人工智能和机器学习技术的发展,Delphi 12.2 集成了一些相关的工具和库,如 TensorFlow 等,方便开发者

去年介绍过使用ollama把deepseek 模型部署到本地,,今天升级了ollama,下载了两个新模型:gemma4和qwen3.5,这两个模型不是云端模型,不需要订阅ollama pro或max会员,不用花一分钱。

我们这个项目是用一个脚本读取 yml 文件去拉取各程序包镜像的。表格参数核心作用默认值对外暴露http.port外部客户端访问 ES 的 HTTP API 端口9200是集群节点间内部通信的端口9300否关键结论1. 单节点场景下,只需关注http.port(保持默认 9200,通过 Docker 映射宿主机端口即可),无需修改;2. 多节点集群需确保端口在节点间互通,http.port仅用于外部

达梦的DATETIME → PostgreSQL 的TIMESTAMP;复制调整后的 DDL 脚本,在 DBeaver 中打开 PostgreSQL 目标库的对应模式,新建 SQL 编辑器并粘贴脚本,执行前核对模式名、表名是否正确,确认无误后执行,完成单表 / 批量表的结构创建(建议按模式分批次执行,每批执行后检查表是否成功创建)。右键点击选中的表,依次选择「生成 SQL」→「DDL」,DBeav

我用qbittorrent主要是下载高清视频,下载在群晖里后,配合KODI或者EMBY、Jellyfin这些个人影院系统观看那简直不要太爽,在这里如果是各视频app的VIP会员直接app里看就好不用像我折腾了,还有PT网站下载的这些高清视频上是没有牛皮癣广告满足完美党的要求。另外存储空间的设置我是在群晖里docker目录下面创建了qt文件夹,qt文件夹下面创建了config、data、downlo

今天我以 Jellyfin 为例,来给群晖 NAS 里容器里的应用升级。因为大家都知道的原因,群晖里容器不能直接拉取镜像的最新版本。我想到的办法是手动下载并将镜像打包,再在群晖里手动导入镜像包,来实现升级容器应用的目的。访问渡渡鸟镜像同步站https://docker.aityp.com,搜索 jellyfin,找到合适的版本,这里我选择最新版,是昨天才发布的版本。在映像菜单里点击操作---导入-

本文介绍如何使用pip在Windows机器上安装Open Webui,配合Ollama调用本地大模型的方法

前面的文章我介绍过使用 Ollama 在家里的台式机上部署本地 DeepSeek-R1 模型,我分别下载了 7b、8b、14b、32b、70b、671b 这些模型。但是很不幸的是,台式机的 CPU 是 AMD 5600G,内存 32G,只有核显,没有独立显卡,7 b、8 b 速度还算可以,14b、32b 就需要十几分钟才能回答一个问题,70b 就直接提示内存不足了。这是因为输入框下面的知识库图标我