简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

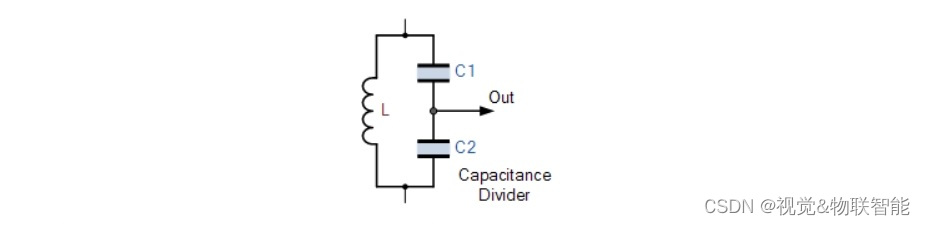

Colpitts 振荡器设计使用两个中心抽头电容器与并联电感器串联,形成产生正弦振荡的谐振储能电路。

文章聚焦人工智能安全,指出传统措施难应对AI运行时风险,模型与数据暴露隐患突出。虽标准机构明确风险,却缺运行时保护细则。提出使用中加密革新安全范式,弥补策略与实践差距,为AI全生命周期安全运行,筑牢关键防护屏障。

TCS3200 和 TCS3210 可编程彩色光频率转换器在单个单片 CMOS 集成电路上结合了可配置的硅光电二极管和电流频率转换器。 输出是方波(50% 占空比),其频率与光强度(辐照度)成正比。

过去十载,企业对人工智能的应用呈现出一种可预见的轨迹:巨额资金投入、前景广阔的试点探索,以及成效参差不齐的运营实践。不过,在银行业与保险业,人工智能早已褪去实验色彩,深度嵌入到欺诈检测、信贷审批、承保及理赔等高风险决策环节。这些决策承载着巨大的财务、声誉及监管风险,且其形成不仅受单一模型左右,更受代理驱动的工作流程以及跨越多系统、多流程阶段的自动化决策管道影响。

人工智能工具的登场,往往伴随着令人耳熟能详的宣传话语。它们宣称能够精简工作流程、提升生产效率,并接手那些鲜有人愿做的工作。而在多数情形下,这些承诺确实得以兑现。它们优化登录流程、整合文档内容、实现工作流自动化,让日常事务的处理变得轻而易举。

数百年来,人类对思维本质的理解始终被理性主义范式所主导。传统认知科学将心智视为符号操作系统,强调逻辑推理与演绎证明的核心地位。这种认知图式不仅塑造了心理学、哲学的研究范式,更直接影响早期人工智能的符号主义发展路径。然而,深度学习先驱杰弗里·辛顿(Geoffrey Hinton)提出的"类比机器"理论,正在引发认知科学领域的根本性变革。通过整合神经科学与认知心理学的研究成果,该理论揭示:人类认知的本

随着人工智能(AI)技术的迅猛发展,对高效且可扩展的推理解决方案的需求急剧上升。随着企业致力于快速运行模型以进行实时预测,AI 推理的重要性预计将迅速超越训练。这一转变突显了对强大基础架构的需求,以便以最小的延迟处理海量数据。

在网络安全领域,人工智能(AI)引发的网络威胁正对全球个人和组织构成重大风险。传统网络钓鱼攻击因AI工具的滥用不断升级,其频率、复杂性和隐蔽性逐年攀升。其中,**AI语音钓鱼(Vishing)**因其技术先进性和高欺骗性,成为最值得关注的新型攻击手段。

人工智能(AI)在软件开发中的作用已经从最初的语法校正和自动格式化,发展到能够生成完整代码块的高度复杂系统。最初,AI工具仅用于执行如语法检查、自动格式化和提供基本代码建议等次要任务,帮助开发者简化开发流程。

在过去的一年里,黑客攻击、服务中断、立法变革以及快速涌现的技术趋势共同塑造了全新的网络安全格局。人工智能(AI)持续以惊人的速度演进,生成式和代理式AI正推动各组织深入思考其在业务各个领域的应用潜力。与此同时,新的安全类别应运而生,助力各组织在云服务不断拓展及网络威胁日益复杂的环境下,更为高效地管理数据。此外,全球各地纷纷出台相关立法,旨在帮助各组织有效降低风险,确保网络弹性。