简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

OCR 是一种通过计算机算法将图像中的文字(数字、字母、汉字等)转换为可编辑文本的技术。其核心目标是模拟人类视觉系统对字符的识别过程,解决 “图像文字无法直接被机器解析” 的问题。在验证码识别中,主要用于处理由字符构成的静态图形验证码(如登录页常见的 4 位数字字母组合验证码)。OpenCV(Open Source Computer Vision Library)是一个跨平台的开源计算机视觉库,包

PPO 的成功,在于它完美平衡了简单性、稳定性和效率用 “截断目标函数” 替代 TRPO 的复杂约束,实现了策略的稳定更新;允许同一批数据多次更新,大幅提高了数据利用率;仅需普通梯度下降即可实现,工程落地门槛极低。理解 PPO 的核心 ——“在保证策略不突变的前提下,用数据高效地更新”,不仅能掌握一个强大的工具,更能体会到强化学习中 “实用主义” 的设计哲学。用最简单的办法,让策略更新既稳又快。它

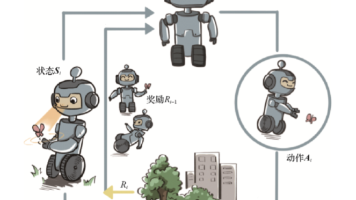

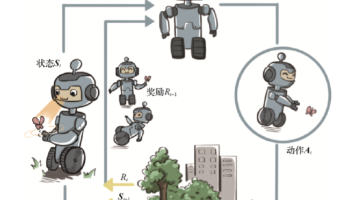

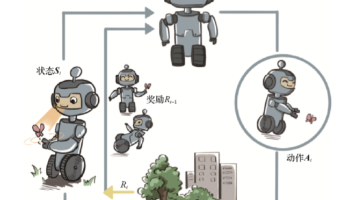

就是 “逛超市时,你现在在哪,决定了你下一步可能去哪,并且每到一个地方能攒多少积分,最后算清楚每个地方到底值多少分拆成 4 个你能摸到的东西:状态:超市里的位置,比如 “入口、零食区、生鲜区、收银台(结账走人)”。转移:从当前位置能走到哪。比如 “在零食区,60% 概率去生鲜区,40% 概率回入口”(只和现在在哪有关,和你之前去过玩具区没关系 —— 这就是 “马尔可夫性”)。奖励:到每个位置给的积

在马尔可夫决策过程(MDP)中,动态规划(Dynamic Programming, DP)算法是求解最优策略和最优价值函数的经典方法。其核心思想是利用,通过迭代更新价值函数或策略,最终收敛到最优解。和。

循环神经网络(Recurrent Neural Network, RNN)是一种专门处理序列数据的神经网络模型,其核心特点是引入 “记忆” 机制——网络在处理当前输入时,会结合之前的输入信息(即 “历史状态”),从而捕捉序列数据中的时序依赖关系。与传统的前馈神经网络(如 CNN、MLP)不同,RNN 的结构中存在循环连接隐藏层的输出不仅取决于当前输入,还取决于上一时刻的隐藏状态。这种设计使其天然适

定义输入数据包含多个通道(例如彩色图像的 RGB 三通道)。每个通道有独立的卷积核集合,分别处理不同通道的信息。定义每个卷积层生成多个输出通道(也称为 “特征图”)。每个输出通道对应一组独立的卷积核,提取不同类型的特征。

连续使用 3 个 3×3 卷积核(感受野 7×7)等效于 1 个 7×7 卷积核,但参数量减少 3×(3×3) = 27 vs7×7 = 49,且增加了非线性(更多 ReLU 层)。VGG 有多个版本(如 VGG11、VGG13、VGG16、VGG19),数字代表网络的层数(卷积层 + 全连接层)。: 预训练的 VGG 模型是计算机视觉领域最常用的特征提取器之一,尤其在数据有限的场景下。: 每个块

重置门负责筛选历史信息,帮助模型关注 "当前相关" 的历史内容。更新门负责平衡新旧信息,帮助模型在 "记忆" 和 "遗忘" 之间找到平衡点。

指的是对超出模型单次处理能力(或固定长度限制)的超长序列进行读取、拆分和预处理的过程。其。

核心思想将不同的卷积层通过并联的方式结合在一起,经过不同卷积层处理的结果矩阵在深度这个维度拼接起来,形成一个更深的矩阵。通过这种方式对网络的深度和宽度进行高效扩充,在提升深度学习网络准确率的同时防止过拟合现象的发生。结构特点多尺度卷积核:通常使用 1×1、3×3、5×5 等不同尺寸的卷积核,增加了网络对不同尺度的适应性。小卷积核(如 1×1)可捕捉精细细节并降维,大卷积核(如 3×3、5×5)有助