简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

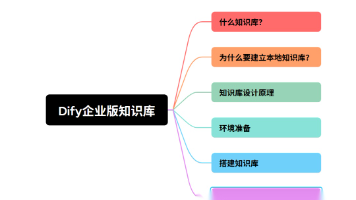

本文详细介绍了如何使用Dify平台搭建企业级本地知识库,解决了数据安全、定制化需求等痛点。从环境准备、知识库创建、文档上传处理到对话应用构建,提供了完整的企业级知识库搭建流程。支持多种文档格式,可处理扫描件,适合企业内部使用,有效避免数据泄露风险,满足金融、医疗等行业的合规要求。

第一章小程序基本介绍一、背景与趋势微信自从问世以来,现在已经是民众必不可少的交流工具。微信小程序,是一种不需要下载安装就可以使用的应用软件,微信小程序的出现实现了应用触手可及的梦想,使用者只需要轻轻的扫一扫或者搜一下就可以打开应用,用户使用起来特别的方便快捷,今天就同大家一同来了解一下微信小程序未来的发展趋势和前景。1、微信小程序发展趋势微信小程序的开发将实现企业和用户的更好交流,也能够大幅度增加

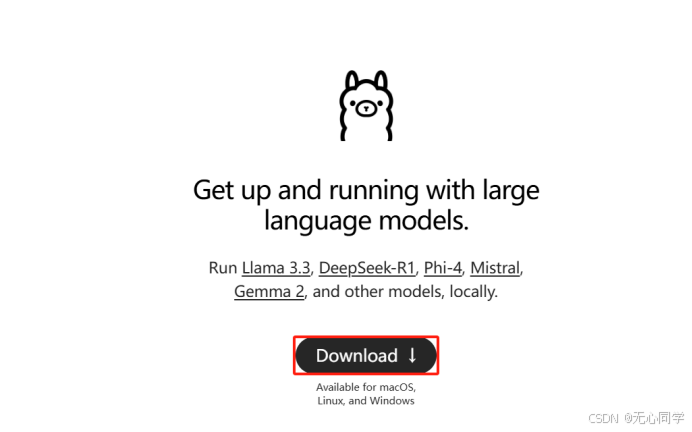

很多人有这样的需求:网上爆火的deepseek、chatgpt、QWen等AI大模型属于通用AI模型,但是想将AI应用到自己所在的行业,也就是训练一个行业专业的AI专家,模型微调操作复杂、需要大量数据支撑、需要好的硬件配置进行长时间的训练,因此搭建本地的个人知识库是一个很好的选择,适用于小规模数据集并且不需要额外的资源消耗,本地搭建知识库更符合企业安全可靠的需求。

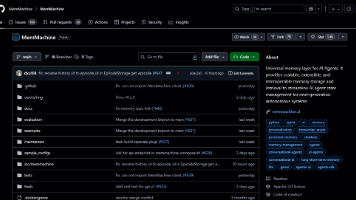

本文介绍如何使用MemMachine开源项目为AI Agent添加长期记忆功能,不同于传统RAG,它提供"剧情脑"和"档案脑"两种记忆方式,使AI能记住用户的前因后果和个人偏好。文章详细讲解了MemMachine的安装配置过程,包括OpenAI和阿里云API两种方案,并通过实战案例展示了如何让AI记住用户饮食习惯。该系统具有记忆动态进化、数据隐私保护和良好开发者体验三大优势,特别适合陪伴类、客服类

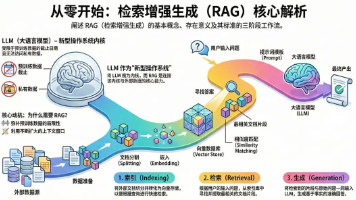

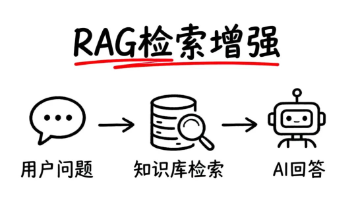

文章详解AI项目三大技术选型:RAG(检索增强生成)适合知识不足场景,知识存于外部;In-Context Learning通过示例激发能力,无需训练;Fine-tuning通过训练将能力嵌入模型,效率高但成本高。分析了它们的本质区别、适用场景、优缺点、成本对比及组合策略,帮助开发者根据实际需求做出正确选择,避免资源浪费。

“我们定义AI为研究从环境中接收感知并执行动作的智能体。”

本文详细介绍了Claude的Agent Skills功能,这是一种扩展大模型能力的模块化解决方案。Skills通过文件系统架构实现渐进式信息披露,包含元数据、指令和资源三级加载,有效降低上下文成本。文章深入探讨了Skills的优势、架构设计、使用方法、安全考虑及跨平台部署策略,帮助开发者将通用AI助手转变为特定领域的专家工具,提升工作效率和专业能力。

那在这节课中,我们将通过大模型底层调用代码来一起深入的了解一下大模型是如何实现调用的。

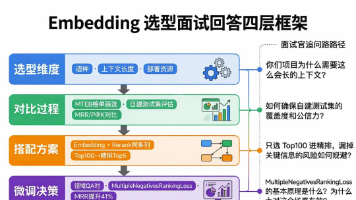

本文系统剖析RAG技术栈三大支柱:对比主流Embedding模型选型;整理20个高频面试题及12种调优策略;深入解析向量搜索与Rerank的区别(Bi-encoder与Cross-encoder)。内容详实,助你掌握大模型落地核心技能。

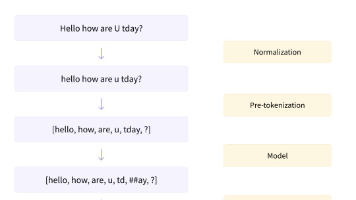

本文阐述了RAG解决大模型数据局限性的动机,详细拆解了RAG的核心三阶段:索引、检索与生成,涵盖文档分割、向量化及逻辑链构建。同时介绍了利用LangSmith进行追踪和可观测性的重要性,为后续深入技术细节做铺垫。我们详细介绍了 RAG 出现的背景以及动机,知道了为什么需要 RAG 以及最后 RAG 能帮我们完成哪些事情。在本节内容中我们将会就 RAG 开发的基本流程进行介绍。