简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在传统闭卷模式下,大模型只能依赖训练时 “记住” 的知识回答问题。当问题涉及模型训练数据之外的最新资讯或特定领域知识时,模型要么拒绝回答要么张冠李戴,难以令人满意。Retrieval-Augmented Generation(检索增强生成,简称 RAG)提供了一种折中的解决方案:不给模型继续 “补课” 微调,而是在回答时临时为它提供一份外部资料。这样模型就像开卷考试一样,可以一边参考资料一边作答,

这个方案从开发到调试约 2 天,封装后后续项目调用豆包双模型,只需拷贝后端代码、修改.env配置、引入前端组件即可使用。如果您也需要做豆包模型的流式调用,希望这篇能帮您少走弯路。若有更好的实现方式,欢迎在评论区交流~

传统的基于大语言模型的BaseAgent因其随机决策的特性,难以保障复杂任务的可靠执行。本文将深入探讨如何结合LangChain(能力组件库)与LangGraph(流程操作系统),设计一个可闭环集成到现有架构的 WorkflowAgent,以解决上述痛点,并通过实战案例展示其从设计到落地的全过程。LangChain与LangGraphLangChainLangGraph二者协同,从根本上解决了Ba

这真的是AI在思考吗?还是它只是在用难以想象的复杂性来做统计?两者都是。从某种意义上,统计足够复杂,就变成了智能。正如人类的思维也是由神经元的电化学过程组成的,但我们说人在"思考"一样。拆成Token理解上下文计算概率选择词汇重复迭代但这个过程重复数百次、数千次,加上数万亿个参数的协同作用,就产生了让人惊叹的结果。这也是为什么有人说:大模型是"大力出奇迹"——因为它真的就是靠着巨量的参数、巨量的数

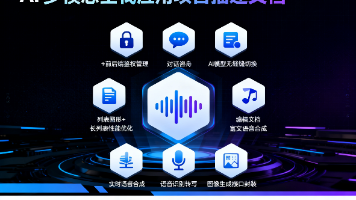

✅流式响应 + 格式保护:解决 AI 对话实时性与完整性的核心矛盾✅多模态能力无缝集成:文本、图像生成一站式实现,接口设计统一✅工程化规范完善:从代码规范到部署流程,可直接复用为企业级项目模板✅性能优化到位:虚拟滚动、懒加载等技术确保大规模数据下的流畅体验✅TypeScript 全栈覆盖:类型安全提升开发效率,降低维护成本智能汇 AI 项目的核心价值,在于将复杂的多模态 AI 能力与现代化全栈技术

安全性:JWT+HttpOnly Cookie 防护,bcrypt 加密,CORS/CSRF 防护,输入校验与限流。性能优化:虚拟滚动减少 95% DOM,分页加载提升 83% 首屏速度,流式传输降低 80% 语音延迟。用户体验:实时流式反馈(对话 / 语音),智能交互(快捷键 / 自动定位),流畅操作(滚动 / 位置保持)。工程化:分层架构清晰,统一错误处理,完善日志,可观测性强。可维护性:模块

topic: strdraft: strLangGraph 并不是 LangChain 的替代品,而是它的结构补全。多 Agent长流程强控制可回溯可演进LangGraph 几乎是必然选择。

LangChain 的价值不在于“帮你写 Prompt”,而在于让大模型应用具备工程结构和系统能力。当 LLM 应用从 Demo 走向生产环境,LangChain 几乎是绕不开的技术栈之一。如果你正在构建真实的 AI 应用系统,理解并掌握 LangChain,是非常值得投入的一步。

chat.js模块通过 “解析 - 传输 - 服务 - 业务”四层架构技术屏蔽:把 SSE 协议解析、流控逻辑封装成黑盒,业务层不用关心底层实现;工程化适配:解决环境切换、错误统一、资源释放等工程问题,提升模块稳定性;业务弹性:通过参数差异化适配不同 AI 对话场景,支持快速扩展新功能。这个架构不仅适用于豆包模型 API 封装,还能用到其他流式数据场景(比如实时日志、进度推送),为前端构建高可用、

多模态人工智能(Multimodal AI)标志着 AI 能力从处理孤立数据(如纯文本、纯视觉)向整合型、跨模态推理的深刻转变。这种转变旨在模拟人类的认知过程,即综合处理来自多种感官的信息以做出决策和理解世界 1。实现这一目标,需要开发鲁棒的机制来协调和统一异构数据源,例如将医疗影像、临床笔记、实验室结果等结构化和非结构化数据统一到一个框架内进行分析,从而实现更全面的病理理解和诊断 2。