简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

开源语音克隆模型MOSS-TTS-Nano突破技术瓶颈,仅0.1B参数即可在CPU上实现48kHz立体声实时生成。该模型采用创新的纯自回归架构,支持20种语言,无需GPU即可流畅运行,在MacBook Air M4上仅需单核CPU。其核心是20M参数的轻量化音频分词器,通过残差矢量量化技术实现高保真重建。开发者可通过简单命令行或Web界面快速部署,适用于浏览器插件、智能硬件等场景,大幅降低高质量语

AI时代HTML正取代Markdown成为文档新标准。Claude团队工程师Thariq Shihipar提出HTML比Markdown更适合AI生成内容,因其支持交互组件、结构化展示等优势。开源项目html-anything让本地AI直接输出HTML,实现"草稿→成品"的转换。这种转变反映了AI时代文档从"写作工具"向"阅读产品"的演进

在 AI 技术日新月异的今天,像 Voice-Pro 这样原本走商业订阅路线、如今却选择全面开源并完全免费的项目,简直是科技界和创作者圈的“大慈善家”。它不仅打破了 ElevenLabs 等行业巨头的收费垄断,更为广大的独立内容创作者、播客创作者以及出海自媒体人,提供了一把无限制的“生产力利器”。如果你也想在 2026 年弯道超车,用 AI 赋能自己的视频内容,赶紧去 GitHub 给这个宝藏项目

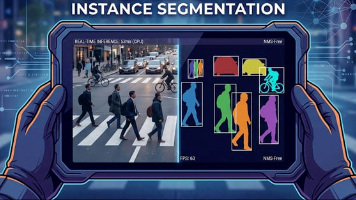

计算机视觉让机器真正"看懂"图像,从识别物体到诊断病情。其核心过程包括识别、重建和重组关系。在医学影像诊断中,计算机视觉通过数据收集、预处理、模型选择和训练四个步骤学习识别病情特征。主要应用包括图像分类、对象检测、面部识别等,已广泛应用于医疗、自动驾驶、零售等行业。开发工具如OpenCV、TensorFlow等让计算机视觉更易实现。经过60年发展,从最初的线条识别到如今的复杂应

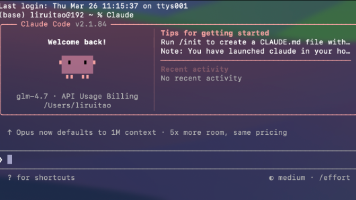

AI Agent是一种能够感知环境、自主规划和执行任务的智能系统,相比大语言模型(LLM)具有更强的主动性和执行能力。其核心组件包括大脑(LLM)、工具(Tools)、记忆(Memory)和规划能力(Planning)。Claude Code作为AI Agent的典型应用,是一款自主编程工具,支持自动化任务、开发新功能、调试Bug等,并可通过自然语言指令进行操作。最新特性包括自动模式、语音模式和远

摘要:现代AI助手如ClaudeCode的核心架构其实非常简单——一个while循环加上工具调用机制。文章解析了这种被称为"AgentLoop"的模式:语言模型通过循环不断接收工具执行结果,自主决定何时停止。核心实现包括安全执行层、工具定义和消息历史管理,整个系统仅需30行代码即可构建基础功能。这种设计让模型能自主判断任务完成度,只需添加工具即可扩展能力边界,是构建复杂AI助手

阿里云发布千问Qwen3.6-Plus模型,实现编程智能体、通用智能体和工具调用三大能力跃升。该模型配备100万token超长上下文窗口,在编程基准测试中紧追ClaudeOpus4.5,部分表现超越;在通用智能体评测中与顶级模型同梯队,多模态能力全面提升。支持主流Agent框架,API调用价格低至2元/百万tokens。实测显示其"氛围编程"能力可快速生成完整应用,标志AI工作

本文介绍了一种通过DispatchMap模式扩展AI Agent工具能力的方法。核心思路是保持主循环不变,通过字典映射将工具名与处理函数关联,实现零成本工具扩展。文章详细解析了路径沙箱(safe_path)安全机制、四个专用工具(read/write/edit文件及bash)的实现,以及如何通过TOOL_HANDLERS字典实现工具分发。这种设计遵循开放-封闭原则,新增工具只需注册到字典而无需修改

智谱AI发布全新旗舰模型GLM-5.1,综合能力对标ClaudeOpus4.6,在代码能力评测中刷新全球纪录。该模型具备200K上下文窗口和128K输出能力,支持8小时持续工作,可完成从规划到交付的完整闭环。在SWE-BenchPro测试中以58.4分超越GPT-5.4等国际主流模型,并在12项基准评测中表现优异。典型案例显示其能构建完整Linux系统、优化数据库性能等。GLM-5.1提供完善AP

摘要:Harness是Anthropic推出的托管智能体运行框架,它重新定义了AI应用开发方式。作为连接LLM与现实世界的"操作系统",Harness解决了传统Agent开发中80%的基础设施构建难题,包括工具调用、状态管理、异常处理等。系统包含四大核心概念:Agent(配置定义)、Environment(运行容器)、Session(任务实例)和Events(通信单元)。通过与