简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

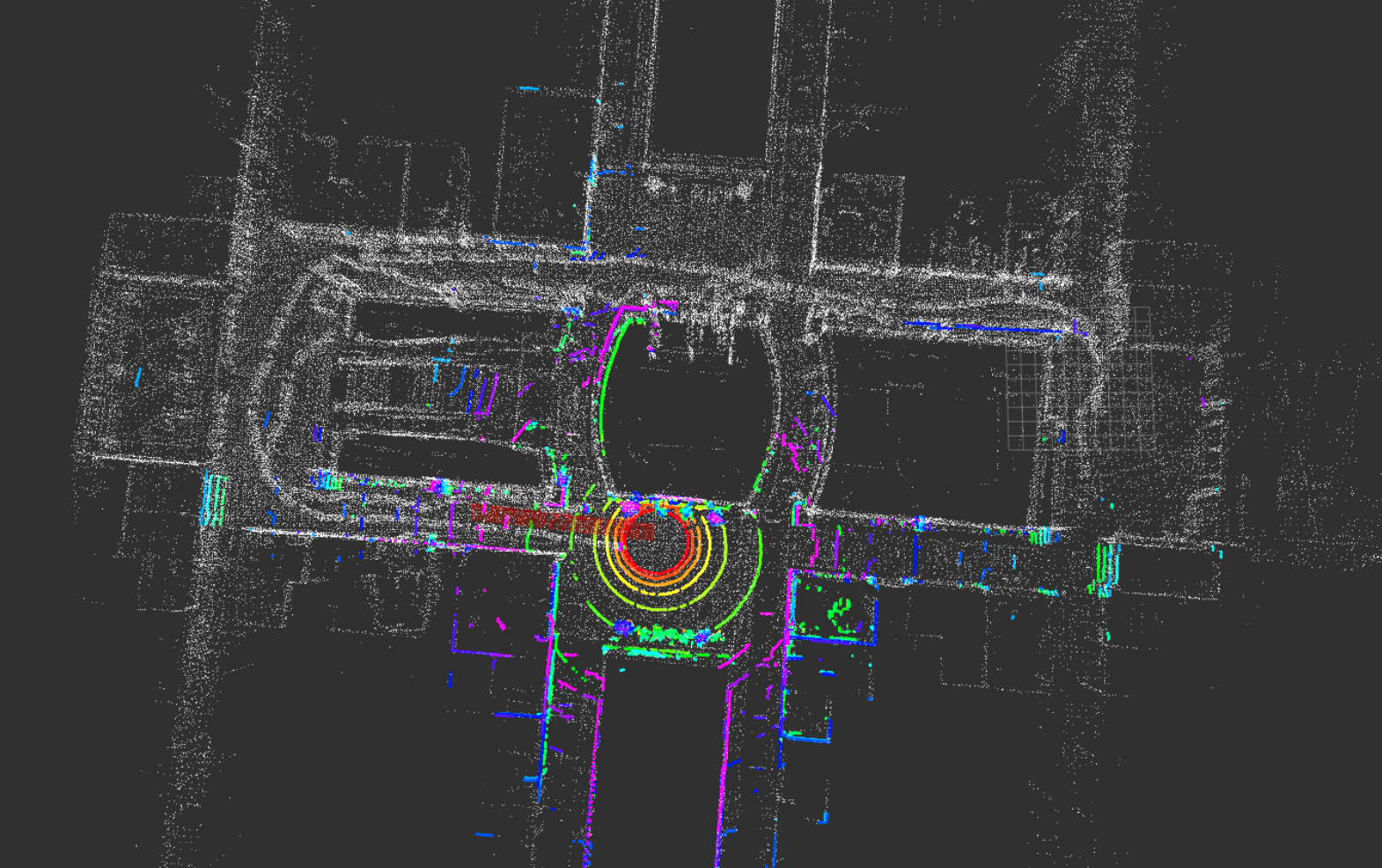

作为SLAM项目,从0开始,基于C++,在ROS环境下实现了一个激光里程计,能够在RVIZ下实时显示位姿的变化和运动的轨迹,可视化效果好,同时具备很高的旋转精度,不错的平移精度,可以在gazebo中仿真使用,也能够用自己的激光雷达进行运行

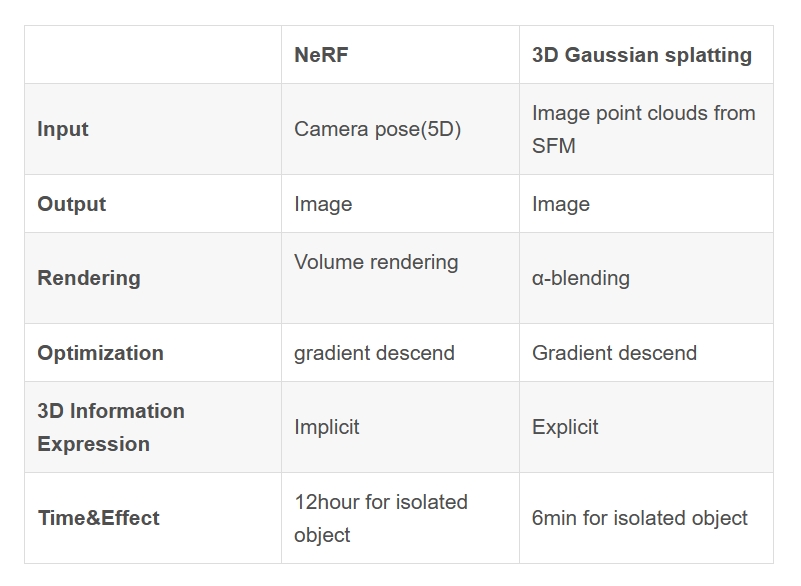

本文从数据输入、数据输出、渲染方式、优化方式、三维信息表达、时间与效果等几个方面对三维重建方法NeRF和3D Gaussian Splatting方法进行了横向比较,分析其异同

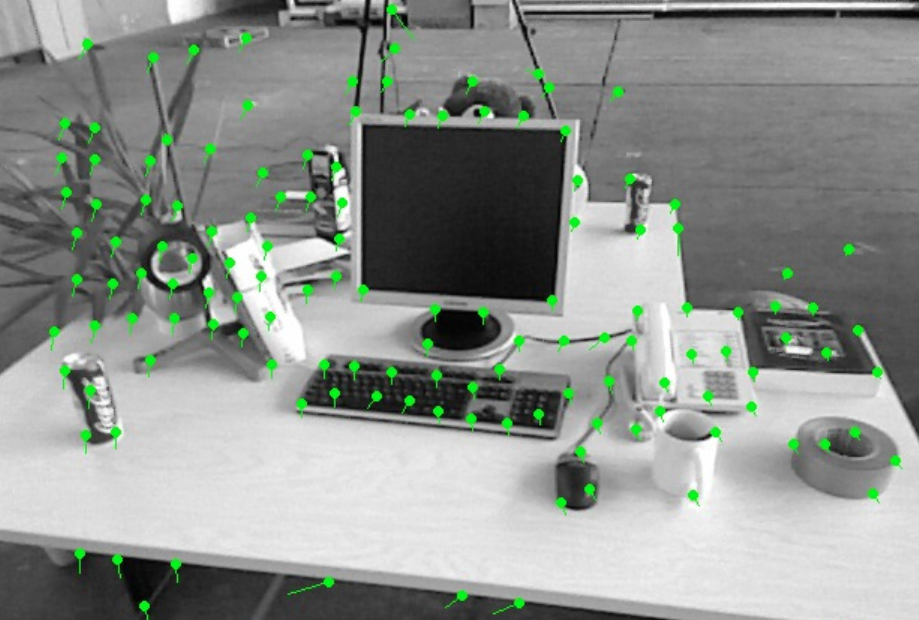

这篇文章的主要记录我对于基于优化方法的视觉里程计的理解,并利用C++代码实现了一个输入两张图片和图片对应的深度,输出一个位姿变换的视觉里程计算法。视觉里程计是视觉SLAM中最重要的部分之一,其位于整个视觉SLAM的前端,核心任务是为整个SLAM过程提供一个不错的位姿估计,实现视觉里程计的方法有很多,本文主要探讨基于优化方法实现的视觉里程计的原理和代码实现。

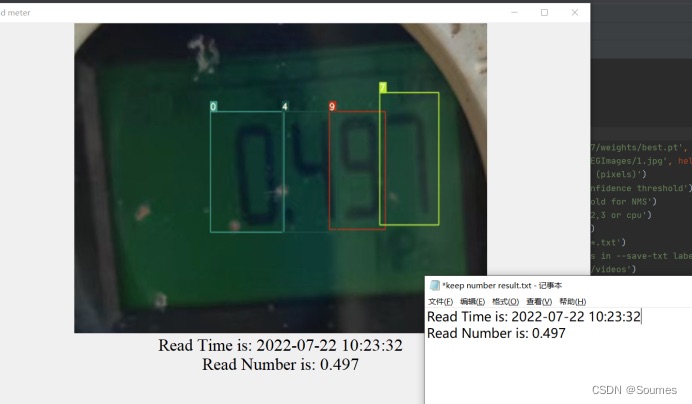

利用python+opencv+yolov5实现数字仪表读数,并将读数结果输出到UI界面显示,并保存到本地,包含图像处理,数据增强,YOLOv5源码改写,编写输出接口等

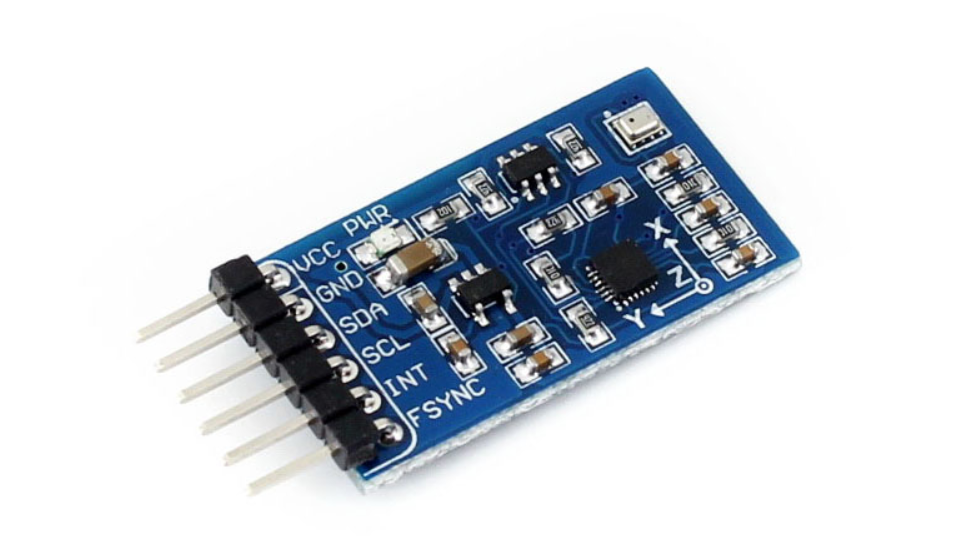

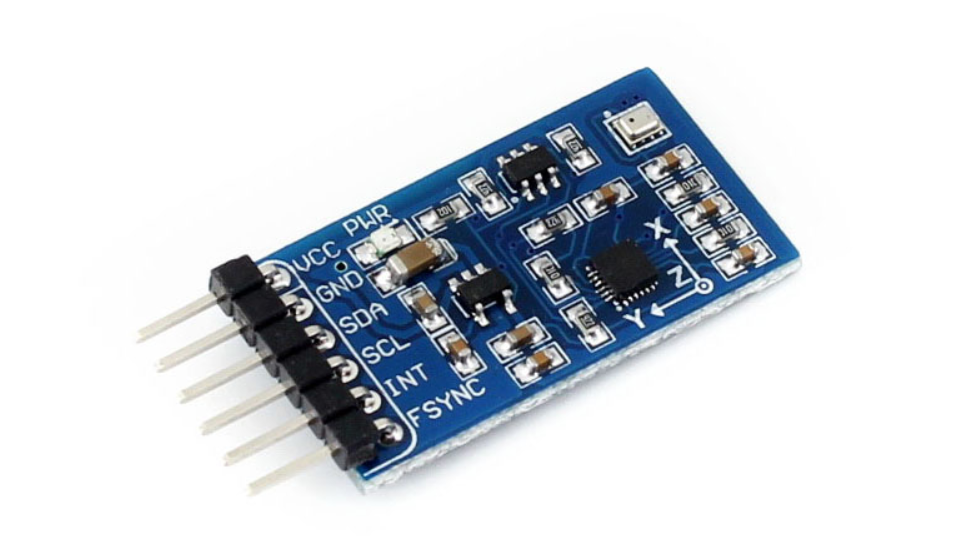

只利用IMU单个传感器,实现对人行走距离的检测,精度达到0.5m左右。同时还利用峰值检测算法实现了一个精确的计步器。

复现出一套完整的二维激光SLAM算法,能够快速进行扫描匹配,建立栅格地图,算法运行速度是hector的8倍,gmapping的16倍,能够在一帧雷达数据的周期中完成3次计算,建图效果好,能够在机器人快速运动的情况下依旧建立清晰可靠的地图。

只利用IMU单个传感器,实现对人行走距离的检测,精度达到0.5m左右。同时还利用峰值检测算法实现了一个精确的计步器。

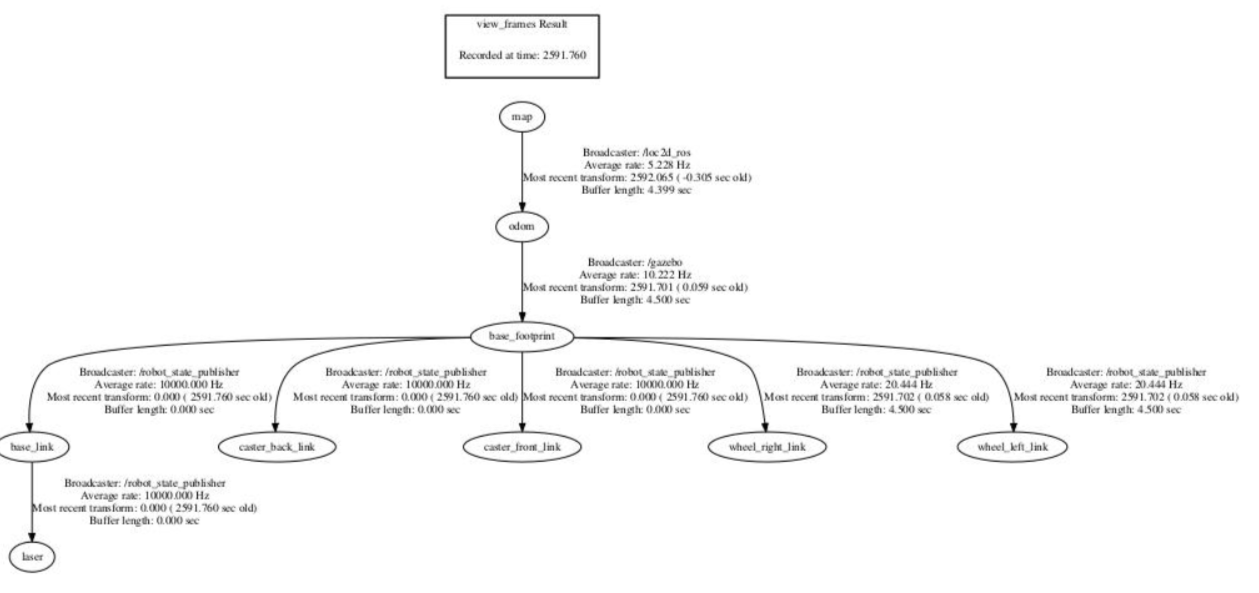

由于SLAM过程中需要用到不同的传感器对环境进行感知和观测,而每一个传感器都应一种坐标系,所以在整个SLAM过程中涉及到非常多次的坐标变换,想要搞清楚SLAM的过程,需要对这些坐标变换有充分的理解,本文主要记录一下我对于激光SLAM中坐标变换的理解(ROS下)

利用python+opencv+yolov5实现数字仪表读数,并将读数结果输出到UI界面显示,并保存到本地,包含图像处理,数据增强,YOLOv5源码改写,编写输出接口等