简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

DeeplabV3算法参数配置关于数据集的配置训练集参数数据预处理模块DataSet构建模块测试一下数据集去正则化参数配置关于数据集的配置parser = argparse.ArgumentParser()# Datset Optionsparser.add_argument("--data_root", type=str, default=r'D:/',help="path to Dataset

神经网络进行气温预测导入库数据读取构建模型更简单的构建网络模型训练网络测试导入库import numpy as npimport pandas as pdimport matplotlib.pyplot as pltimport torchimport torch.optim as optimimport warningswarnings.filterwarnings("ignore")数据读取f

YOLO v3论文地址:https://pjreddie.com/media/files/papers/YOLOv3.pdf论文:YOLOv3: An Incremental Improvement[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-DpKYQScV-1646385980332)(…/images/yoloV3/image-2022020219462078

espcn原理算法请参考上一篇论文,这里主要给实现。数据集如下:尺寸相等即可针对数据集,生成样本代码preeate_data.pyimport imageiofrom scipy import misc, ndimageimport numpy as npimport imghdrimport shutilimport osimport jsonmat = np.array([[ 65.481,

Streamlit 是一个开源框架,用于快速构建和部署数据应用程序。它特别适用于数据科学家和机器学习工程师,无需前端开发经验就可以创建交互式应用。

先回忆一下:SRCNN缺点依赖于图像区域收敛速度慢哈尺度固定计算量大模型输入:原始低分辨率图片核心:亚像素卷积。在网络的最末端实现LR到HR的分辨率背景:之前的SRCNN,通过双三次插值得到的高分辨率的图像,直接从低分辨率LR得到了高分辨率的图片。(输入是双三次插值的高分辨率图像(类似于粗糙的高分辨率图像)),那么在网络卷积中就会造成,粗糙的高分辨率图和标签进行计算。这样计算时间复杂度较大。ESP

更新版本实现了生成对抗网络在超分辨率上的使用更新了损失函数,增加先验函数SRresnet实现import torchimport torchvisionfrom torch import nnclass ConvBlock(nn.Module):def __init__(self, kernel_size=3, stride=1, n_inchannels=64):super(ConvBlock,

机器学习在测井解释上的应用越来越广泛,主要用于提高油气勘探和开发的效率和精度。通过使用机器学习算法,可以从测井数据中自动识别地质特征,预测岩石物理性质,以及优化油气储层的评估和管理。:机器学习模型能够分析测井数据,如声波、电阻率、伽玛射线等,来识别不同的岩石类型和沉积环境。:使用机器学习算法可以根据测井数据预测岩石的孔隙度和渗透性,这对于评估储层质量和油气潜力非常关键。:机器学习方法可以帮助解释和

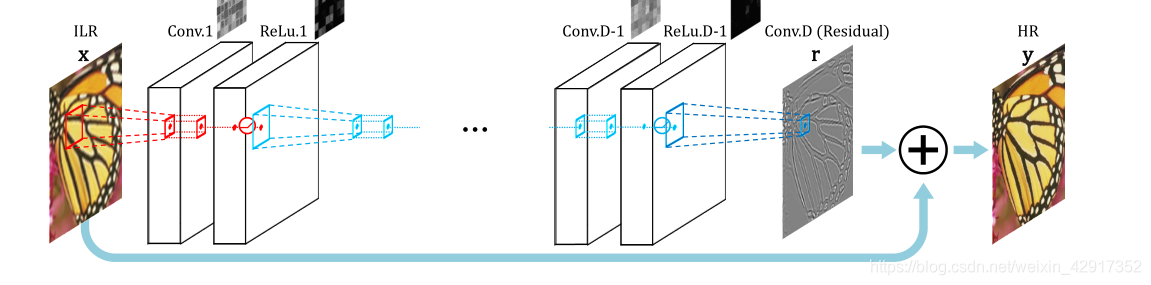

比较于之前的FSRCNN来说,VDSR我认为主要引入了以下优秀特点首先是卷积层数的上的增加,卷积层数直接代表着模型提取特征的能力强弱小卷积核的进一步引入,利用卷积核3x3堆叠层数,模型一共20层。引入残差网络缺点:原文依然采用的MSE损失,单纯比较像素之间的差异。图像相对比较平滑。训练依然采用是SRCNN的训练方法,先上采样到高分辨率尺寸大小再进行训练。两张图理解:(输入尺寸等于输出尺寸的模型实现

网络为基础卷积层tensorflow 1.14scipy 1.2.1numpy 1.16大概意思就是针对数据,我们先把图片按缩小因子照整数倍进行缩减为小图片,再针对小图片进行插值算法,获得还原后的低分辨率的图片作为标签。main.py 配置文件from model import SRCNNfrom utils import input_setupimport numpy as npimport t