简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍了OpenClaw的安装和使用指南:1)通过PowerShell管理员模式安装OpenClaw;2)运行新手引导向导完成配置;3)启动Gateway网关访问本地服务。详细说明了智谱AI、通义千问和硅基流动三大模型的注册流程及API密钥获取方法,并列出了各厂商的核心API地址。文章还提供了不同系统的模型导入脚本使用方法,以及当服务无法访问时的重启解决方案。

(5)关闭防火墙端口:firewall-cmd --zone=public --remove-port=9200/tcp --permanent。(4)开启防火墙端口:firewall-cmd --zone=public --add-port=9200/tcp --permanent。(3)查看开放的端口:firewall-cmd --list-ports。(1)查看防火墙状态:firewall-

本文介绍了OpenClaw的安装和使用指南:1)通过PowerShell管理员模式安装OpenClaw;2)运行新手引导向导完成配置;3)启动Gateway网关访问本地服务。详细说明了智谱AI、通义千问和硅基流动三大模型的注册流程及API密钥获取方法,并列出了各厂商的核心API地址。文章还提供了不同系统的模型导入脚本使用方法,以及当服务无法访问时的重启解决方案。

本文探讨了大语言模型(LLM)推理迁移的关键技术与实现方法。推理迁移是将训练好的大模型通过优化适配迁移至特定硬件(如昇腾NPU)进行高效推理的过程,旨在提升性能、减少资源占用并简化部署。文章详细介绍了四个主要阶段:基础环境搭建、模型分析、模型开发与替换、框架接口调用,并解析了显存估算、时延吞吐等关键技术点。最后以ChatGLM2-6B为例,展示了从环境准备到精度测试的完整迁移流程。通过ATB加速库

本文介绍了OpenClaw的安装和使用指南:1)通过PowerShell管理员模式安装OpenClaw;2)运行新手引导向导完成配置;3)启动Gateway网关访问本地服务。详细说明了智谱AI、通义千问和硅基流动三大模型的注册流程及API密钥获取方法,并列出了各厂商的核心API地址。文章还提供了不同系统的模型导入脚本使用方法,以及当服务无法访问时的重启解决方案。

全文覆盖项目核心架构、市场定位、全平台保姆级安装教程、多场景使用方法、金融投研 / 开发运维 / 自媒体等行业实战案例,同时分析了项目技术演进路线与 AI 执行时代的行业趋势。本文兼顾新手零门槛落地实操与开发者深度架构解析,帮助读者从零搭建专属私有化 AI 执行引擎,实现个人生产力全面跃升。

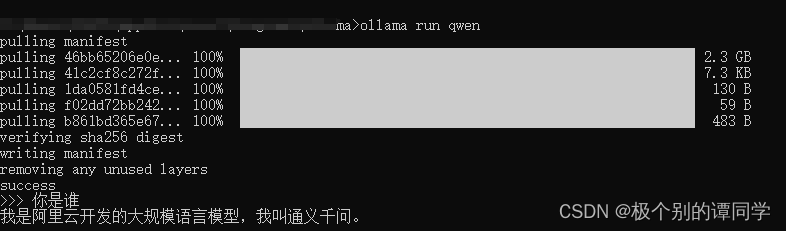

5、安装AnythingLLM工具后打开初始化界面,会进入到配置页面,在【LLM Preference】选项卡中,选择Ollama,然后配置【http://127.0.0.1:11434】、选择运行的大模型【qwen:4b】,token填【8192】6、下一步是配置【Embedding Preference】选项卡中,一样选择 Ollama,然后配置【http://127.0.0.1:11434】

本文探讨了大语言模型(LLM)推理迁移的关键技术与实现方法。推理迁移是将训练好的大模型通过优化适配迁移至特定硬件(如昇腾NPU)进行高效推理的过程,旨在提升性能、减少资源占用并简化部署。文章详细介绍了四个主要阶段:基础环境搭建、模型分析、模型开发与替换、框架接口调用,并解析了显存估算、时延吞吐等关键技术点。最后以ChatGLM2-6B为例,展示了从环境准备到精度测试的完整迁移流程。通过ATB加速库

本文介绍了MCP(模型上下文协议)智能问数服务如何通过三层架构(协议层、智能层、资源层)实现从"数据检索"到"数据对话"的转变。该服务利用大型语言模型解析自然语言查询,自动生成数据操作指令,并通过标准化协议与数据源交互,显著提升企业数据交互效率。文章以贵安新区"全域一张图"为例,展示了MCP服务在数据治理、智能问答和决策支持方面的实践价值

本文探讨了大语言模型(LLM)推理迁移的关键技术与实现方法。推理迁移是将训练好的大模型通过优化适配迁移至特定硬件(如昇腾NPU)进行高效推理的过程,旨在提升性能、减少资源占用并简化部署。文章详细介绍了四个主要阶段:基础环境搭建、模型分析、模型开发与替换、框架接口调用,并解析了显存估算、时延吞吐等关键技术点。最后以ChatGLM2-6B为例,展示了从环境准备到精度测试的完整迁移流程。通过ATB加速库