简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

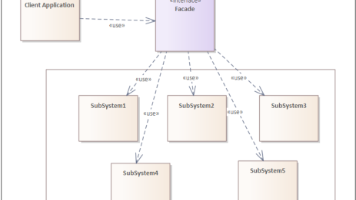

外观模式(Facade Pattern)摘要 外观模式是一种结构型设计模式,旨在通过统一的高层接口简化复杂子系统的使用。它封装子系统细节,客户端只需与"门面"交互(如调用startEvening()一键开启家居设备),无需了解内部实现(灯光、空调、音响的协同逻辑)。该模式显著降低系统耦合度,符合迪米特法则,适用于需要为复杂模块提供统一入口、隔离依赖或简化客户端调用的场景。其核心

Streamlit是一个开源的Python框架,帮助数据科学家快速构建交互式Web应用,无需掌握复杂的前端技术。文章详细介绍了Streamlit的安装方法、基础应用创建过程及运行机制,并深入解析其核心功能,包括文本展示、数据可视化、交互式组件(按钮、滑块等)、文件上传及布局设计。此外,还讲解了高级特性如状态管理、主题定制和机器学习模型集成。文章还提供了多种部署选项(Streamlit社区云、Her

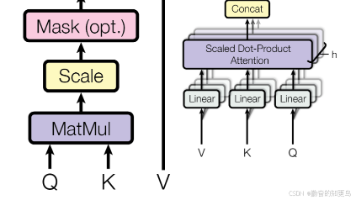

Encoder 编码器:读懂输入的句子,把每个词变成一个向量,提取出句子中各词之间的关系。Decoder 解码器:根据 Encoder 的输出,逐个生成目标语言的单词。优点说明并行处理不像RNN那样一步步,速度更快全局依赖建模注意力机制可以看全局信息模块化设计每一块都很独立,扩展容易表达能力强多头注意力可以挖掘复杂关系通用性强既能做文本,又能做图像、音频、代码!

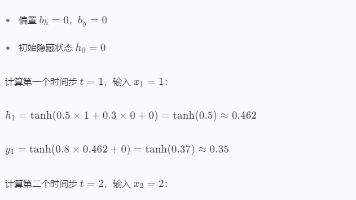

摘要 循环神经网络(RNN)是一种专门处理序列数据的神经网络,通过引入时间维度和记忆机制捕捉序列元素间的依赖关系。其核心结构包括隐藏状态传递和展开计算,使用BPTT算法进行训练,但面临梯度消失/爆炸问题。改进方案包括双向RNN、深度RNN及门控结构(LSTM/GRU)。RNN广泛应用于自然语言处理、时间序列分析等领域,但存在长期依赖、计算效率等挑战。示例代码展示了PyTorch实现简单RNN进行时

特点说明全局建模可以一次性看全句所有词并行计算不像 RNN 要一个个处理,可以并行聚焦关键自动抓住关键内容易扩展可堆叠、可组合,非常灵活Attention 就是让模型学会“聚焦重点”的机制,就像你看书时自动划重点一样,它能帮助模型更聪明地理解输入数据的结构和语义。

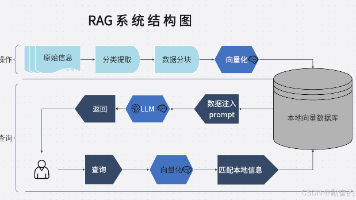

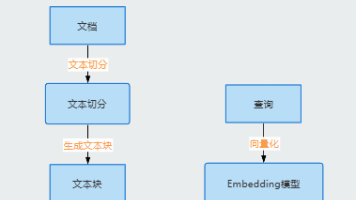

RAG(检索增强生成)技术通过结合信息检索与生成模型的优势,有效解决了大模型在知识密集型任务中的局限性。其核心包括检索模块、增强模块和生成模块三个组件,工作流程涵盖离线数据处理和在线检索两个阶段。关键技术涉及向量化、双塔模型架构、高效检索算法和提示构建策略。RAG具有提高回答准确性、实时更新知识等优势,但也面临检索准确性、资源需求高等挑战。该技术在问答系统、内容创作等领域有广泛应用前景,未来将随着

BERT是由Google在2018年提出的预训练语言模型,采用深度双向Transformer架构,能够同时从前后文理解语义。相比单向模型(如Word2Vec),BERT通过掩蔽语言模型和下一句预测任务进行预训练,显著提升了NLP任务表现。模型结构包含多层Transformer编码器,输入融合词、位置和段落信息。使用Hugging Face库可轻松实现BERT应用,如文本分类。示例代码展示了加载预训

摘要: Spring AI是Spring官方推出的AI开发框架,为Java应用提供统一、可扩展的AI能力集成方案。核心模块包括ChatClient(统一模型交互)、PromptTemplate(动态Prompt管理)、Tool API(函数调用)、VectorStore(向量检索)等,支持OpenAI、Azure、HuggingFace等主流模型。通过依赖注入和模块化设计,Spring AI简化了

LLaMA-Factory是一款开源大语言模型微调框架,支持LLaMA、ChatGLM等模型的快速适配。它提供全量微调、LoRA等多种方式,简化了模型定制过程。使用步骤包括:安装依赖、准备模型与数据(支持Alpaca等格式)、启动微调(可通过命令行或WebUI)、推理部署(支持Gradio交互)。关键功能包括:降低显存消耗(混合精度训练)、多GPU加速、数据增强。典型应用包括客服机器人、文案生成和

RAG问答系统技术摘要 本项目构建了一个基于LangChain框架的RAG(检索增强生成)问答系统,主要特点包括: 多源知识库:支持加载PDF、文本文件和网页内容,实现动态更新知识库 本地化部署:使用Ollama运行LLM本地模型(如Qwen、LLaMA3等) 核心功能: FAISS向量数据库存储文档嵌入 HuggingFace sentence-transformers生成嵌入 支持4种本地大语