简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

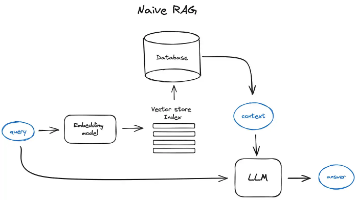

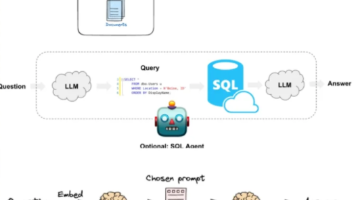

RAG(检索增强生成)系统通过1.2 技术栈选型建议二、数据准备与预处理。

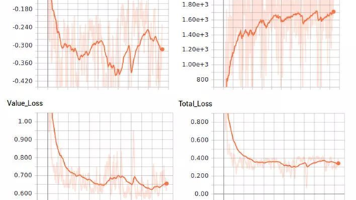

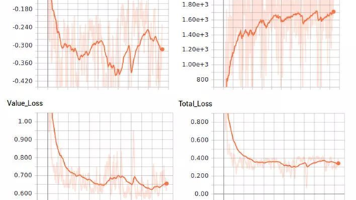

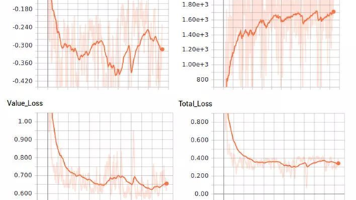

强化学习(Reinforcement Learning, RL)是机器学习的一个分支,它关注的是智能体(Agent)如何在动态环境中通过与环境的交互来学习策略,以最大化累积奖励。智能体在环境中采取动作,环境根据动作反馈给智能体奖励和新的状态,智能体的目标是通过不断试错,找到能够获得最大长期奖励的策略。本文介绍了强化学习的基础概念、常见算法以及 Agent 训练的步骤,并通过代码示例展示了 Q -

强化学习(Reinforcement Learning, RL)是机器学习的一个分支,它关注的是智能体(Agent)如何在动态环境中通过与环境的交互来学习策略,以最大化累积奖励。智能体在环境中采取动作,环境根据动作反馈给智能体奖励和新的状态,智能体的目标是通过不断试错,找到能够获得最大长期奖励的策略。本文介绍了强化学习的基础概念、常见算法以及 Agent 训练的步骤,并通过代码示例展示了 Q -

在数字化转型加速的背景下,大模型技术凭借其强大的数据分析、逻辑推理和决策优化能力,正成为物流供应链领域的核心驱动力。本文深入探讨大模型如何通过需求预测、智能调度、供应链协同、风险管控等关键环节,推动物流行业从 "经验驱动" 向 "数据智能驱动" 转型,结合具体案例解析技术落地路径与价值创造,为行业从业者提供技术应用参考。大模型技术正在引发物流供应链的 "认知革命",从辅助工具升级为核心生产力。

强化学习(Reinforcement Learning, RL)是机器学习的一个分支,它关注的是智能体(Agent)如何在动态环境中通过与环境的交互来学习策略,以最大化累积奖励。智能体在环境中采取动作,环境根据动作反馈给智能体奖励和新的状态,智能体的目标是通过不断试错,找到能够获得最大长期奖励的策略。本文介绍了强化学习的基础概念、常见算法以及 Agent 训练的步骤,并通过代码示例展示了 Q -

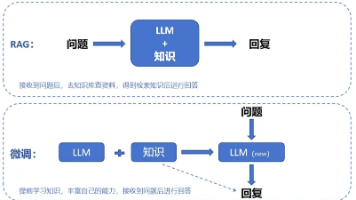

对于大多数企业,建议采用 “RAG 先行,渐进式微调” 的策略:先用 RAG 快速验证业务价值,再根据需求逐步引入微调优化核心场景。这种分层实施路径既能控制风险,又能最大化技术投入的 ROI。在大模型应用落地的实践中,RAG(检索增强生成)与微调(Fine-tuning)已成为知识更新的两大核心技术路径。:某法律科技公司采用 “微调 + RAG” 组合,先通过微调让模型掌握法律条款,再利用 RAG

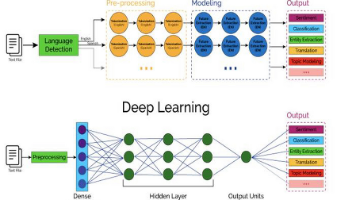

本文通过实战案例展示了使用 Hugging Face 搭建文本分类模型的全流程,包括数据加载、预处理、模型选择、训练、评估和部署。Hugging Face 的强大生态系统(如 Trainer、Evaluate、SetFit)极大简化了 NLP 开发流程,即使是新手也能快速上手。未来可以探索更复杂的模型(如 DeBERTa)或结合领域数据进行微调,以进一步提升性能。参考资料Hugging Face

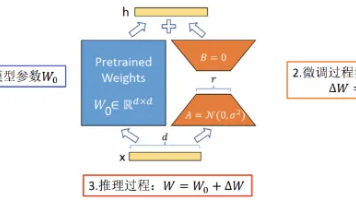

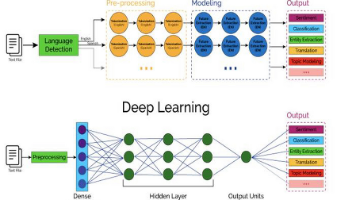

在当今的人工智能领域,大型预训练模型如 GPT、BERT 等已成为解决自然语言处理(NLP)任务的强大工具3。然而,要让这些模型更好地适应特定任务或领域,往往需要进行微调3。

本文通过实战案例展示了使用 Hugging Face 搭建文本分类模型的全流程,包括数据加载、预处理、模型选择、训练、评估和部署。Hugging Face 的强大生态系统(如 Trainer、Evaluate、SetFit)极大简化了 NLP 开发流程,即使是新手也能快速上手。未来可以探索更复杂的模型(如 DeBERTa)或结合领域数据进行微调,以进一步提升性能。参考资料Hugging Face

第一步:判断数据量。数据稀疏 → RAG;数据丰富 → 微调。第二步:判断时效性。需实时更新 → RAG;知识稳定 → 微调。第三步:判断任务复杂度。复杂任务 → 混合策略;简单任务 → 单一方法。