简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

轻量化:0.77B 参数,大幅降低训练 / 部署成本;免预训练:无需大规模机器人数据,数据收集成本骤降;强泛化:两阶段训练保护语义表征,面对干扰(如背景变化、目标移位)仍稳定;高实用:实时推理 + 低显存,适配消费级 GPU 和真实机器人场景。为推动未来研究,作者团队公开了代码、训练数据和模型权重,以鼓励轻量级高性能 VLA 模型的进一步研究与实际开发。

RoboBench是一个面向具身智能的多模态大语言模型评估基准,旨在系统性评估 MLLMs 作为机器人"具身大脑"的认知能力。该基准针对动态非结构化环境中的操作任务,定义了五个核心评估维度:指令理解、感知推理、广义规划、可操作性预测和失败分析,覆盖 14 项能力、25 项任务和 6092 个问答对。1)构建真实场景数据集,整合大规模真实机器人数据与自采数据,涵盖单臂/双臂/移动操作、多视角遮挡场景

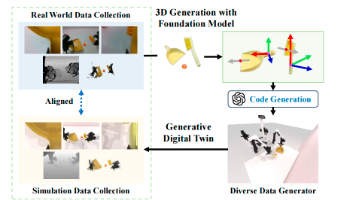

核心贡献公开了 GR00T-N1-2B 模型权重、训练数据、仿真环境(GitHub+HuggingFace),降低通用机器人研究门槛;技术突破:双系统 VLA 架构解决 “推理慢 + 动作笨” 的矛盾,数据金字塔解决 “数据稀缺”,为后续通用机器人模型提供范式;落地验证:在真实 GR-1 人形机器人上实现 “语言指令控制双手操作”,证明基础模型在人形机器人上的可行性。局限性任务范围:目前仅支持 “

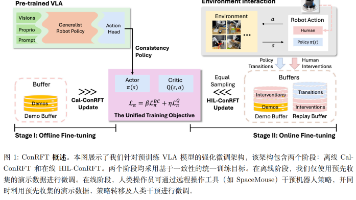

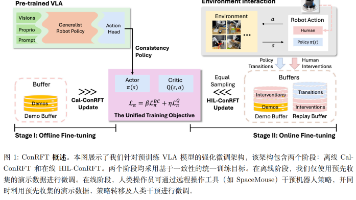

ConRFT 是一种高效、安全、实用的VLA模型强化微调方法,只需 20 个演示+ 1 小时在线训练,就能让机器人在复杂真实任务中达到 96% 成功率,比传统方法快、稳、强。后续可探索 “更智能的奖励设计”“感知 - 动作联合微调”,进一步提升 VLA 模型的通用操控能力。

RoboBench是一个面向具身智能的多模态大语言模型评估基准,旨在系统性评估 MLLMs 作为机器人"具身大脑"的认知能力。该基准针对动态非结构化环境中的操作任务,定义了五个核心评估维度:指令理解、感知推理、广义规划、可操作性预测和失败分析,覆盖 14 项能力、25 项任务和 6092 个问答对。1)构建真实场景数据集,整合大规模真实机器人数据与自采数据,涵盖单臂/双臂/移动操作、多视角遮挡场景

轻量化:0.77B 参数,大幅降低训练 / 部署成本;免预训练:无需大规模机器人数据,数据收集成本骤降;强泛化:两阶段训练保护语义表征,面对干扰(如背景变化、目标移位)仍稳定;高实用:实时推理 + 低显存,适配消费级 GPU 和真实机器人场景。为推动未来研究,作者团队公开了代码、训练数据和模型权重,以鼓励轻量级高性能 VLA 模型的进一步研究与实际开发。

Self-RAG:在 RAG 框架中引入自我反思机制,提高检索增强的效果

ConRFT 是一种高效、安全、实用的VLA模型强化微调方法,只需 20 个演示+ 1 小时在线训练,就能让机器人在复杂真实任务中达到 96% 成功率,比传统方法快、稳、强。后续可探索 “更智能的奖励设计”“感知 - 动作联合微调”,进一步提升 VLA 模型的通用操控能力。

根据 “没有免费午餐定律” ,在所有机器学习算法中,并不存在最厉害的算法。没有最好的模型,只有最合适的模型。机器学习算法虽然只有几种,但需要解决的问题千千万万,哪种模型适合你所需要解决的问题,还需要具体的问题具体分析。性能衡量指标就是一种常用的分析标准。在分类问题中,将机器学习模型的预测与实际情况进行对比后,结果可以分为四种:TP、TN、FN 和 FP。每一种结果由两个字母组成,第一个字母为T或F

关键词:#具身智能 #双臂机器人 #benchmark。