简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

摘要: 90后AI天才郭达雅从珠海一中普通学生到Nature封面科学家,创造了多项业界传奇:博士入学3天满足毕业要求,连续三年横扫腾讯算法大赛,提出颠覆性的GRPO强化学习方法让大模型自主学会"思考"。2026年4月,这位DeepSeek核心成员正式加入字节跳动Seed团队,标志着中国AI顶级人才流动的重要节点。其技术哲学"少即是多"颠覆传统训练范式,在De

中国AI大模型行业经历从“六小龙”到“四小强”的洗牌。智谱AI、MiniMax、月之暗面和阶跃星辰凭借自研基础模型能力坚守赛道,而百川智能和零一万物转向垂直领域。行业分化源于开源模型冲击、资本退潮及巨头入场,2026年将是关键分水岭,考验企业商业化落地能力。这场大浪淘沙标志着行业从技术理想回归商业现实。

有人问达里奥,你为什么总是像个“末日论者”?他愤怒地回应:“当有人说‘这个人是末日论者,他想要放慢进度’时,我真的很生气。你听到我父亲的故事了吗?我父亲死于一桩本可以在几年前就有治疗方法的疾病。我清楚这项技术的益处,我正是因为想要它来得更快、更安全,才如此焦虑。达里奥的父亲,那个一生研究皮革极限的工匠,可能从未想过,他的孩子们把这种“研究材料极限”的精神,用在了人类文明最前沿的工具——人工智能上。

阿里最年轻P10技术高管林俊旸突然离职引发AI圈震动。这位32岁的北大跨界学霸从计算机转向语言学,为其AI研发奠定独特优势。6年内从应届生晋升为阿里史上最年轻P10,带领通义千问团队打造出唯一能与Llama抗衡的中国开源大模型。离职背后暗藏开源与商业化的矛盾,以及组织架构调整的影响。林俊旸在告别长文中提出AI正从"推理式"向"智能体式"转变的新观点,其下一步

摘要: 郭达雅从珠海普通中学生成长为Nature封面作者、DeepSeek核心研究员,再到字节跳动AI Agent负责人,其成长轨迹揭示了普通人逆袭的底层逻辑: 超前自学:高考后自学大学课程,博士入学三天完成毕业要求,通过“饱和式积累”实现加速度成长; 全栈攻坚:在DeepSeek主导代码生成、数学推理到R1模型的完整技术链,构建不可替代的系统能力; 趋势卡位:选择字节跳动专注Agent方向,因代

摘要: 梁文锋从广东农村走出,凭借超前自学能力考入浙大,在量化交易领域用8万元本金起步,创立幻方量化并布局算力基建。2023年转型AI创立DeepSeek,以极简团队、不融资策略和低价普惠模式打破行业常规,用29.4万美元低成本训练出媲美GPT-4的模型。其成长心法在于:超前复利学习、危机中逆向思维、提前十年布局核心资源。2026年因人才竞争压力首次开放融资,展现了理想主义与现实平衡的艰难抉择。他

摘要: 宋俊潇,DeepSeek核心研究员,凭借深厚的数学功底和强化学习专长,从港科大博士到启元世界研究科学家,最终成为DeepSeek的“定海神针”。他主导开发的GRPO算法革新了大模型训练范式,以数学降维打击推动AI推理能力突破。在行业离职潮中坚守初心,其成长心法可总结为:夯实数学地基、建设可迁移能力资产、保持长期定力。宋俊潇证明,真正的技术突破源于对底层原理的极致追求,而非短期风口。

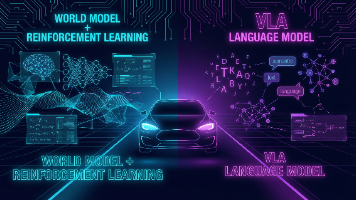

物理直觉派相信:驾驶是一种技能,可以通过在虚拟世界中“刻意练习”达到超人水平。语言智慧派相信:驾驶是一种智能,需要先理解世界才能正确行动。历史告诉我们,最终胜出的往往是融合者。但在此之前,物理派用更低的成本、更快的响应、更聚焦的优化,将在未来三年内赢得大多数消费者的信任。

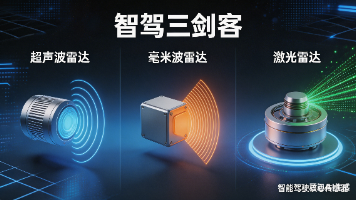

智能驾驶系统中的三大雷达传感器各有特点:超声波雷达成本低、近距离精度高,主要用于泊车和盲区监测;毫米波雷达全天候工作能力强、可直接测速,是自适应巡航的核心;激光雷达分辨率高、可三维建模,适合高阶自动驾驶。目前主流方案采用多传感器融合,让不同雷达与摄像头协同工作,形成优势互补。随着自动驾驶发展,多传感器融合将成为主流趋势,三大雷达各司其职又互为冗余,共同保障行车安全。

写完整篇文章,我突然想问一个问题:李震宇到底算不算天才?在学历通胀到博士满地走的AI圈,他的北航硕士学位并不耀眼。在百度,他不是那个被美国媒体排进“全球60位自动驾驶关键人物”的明星。在华为,他拿过金牌奖,但远不是那个被反复传颂的“华为天才少年”。但就是这样一个看起来“不太天才”的人,在华为啃下了金牌奖这个百里挑一的硬骨头;在百度,当所有比他更耀眼的天才纷纷出走,是他稳住了快要散架的团队;当整个自