简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

github如何上传自己的项目(图文介绍)

以图文的方式介绍如何在GitHub上传自己的代码,包含一些常见问题的介绍

深度学习中Batch Normalization(BN)原理、作用浅析

浅析深度学习中BN层的原理和作用,以及为什么使用BN层通常可以帮助网络更好的学习

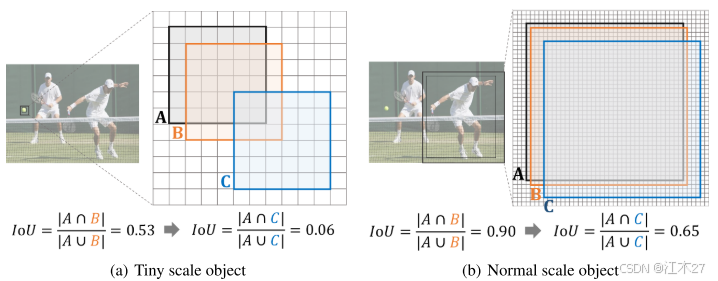

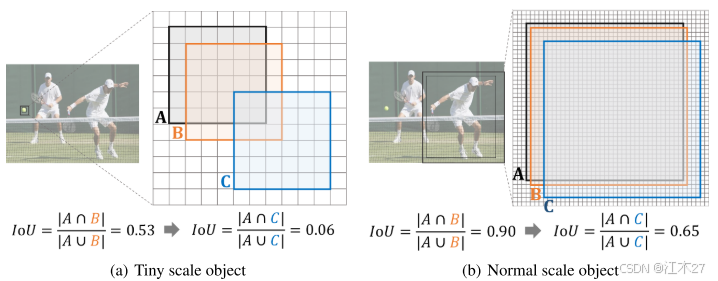

论文《NWD》和YOLOv8中的实现提升小目标检测A Normalized Gaussian Wasserstein Distance for Tiny Object Detection

对小目标检测的损失优化思路和代码复现、和A Normalized Gaussian Wasserstein Distance for Tiny Object Detection论文的理解

论文Learning Efficient Convolutional Networks through Network Slimming(剪枝相关)

我们提出了网络瘦身技术来学习更紧凑的CNN。它直接对批量归一化层中的缩放因子施加稀疏性引起的正则化,因此可以在训练过程中自动识别不重要的通道,然后进行修剪。在多个数据集上,我们已经证明所提出的方法能够显着降低最先进网络的计算成本(高达20倍),并且不会损失准确性。更重要的是,所提出的方法同时减少了模型大小、运行时内存、计算操作,同时为训练过程引入最小的开销,并且生成的模型不需要特殊的库/硬件来进行

深度学习中LayerNorm与RMSNorm对比

对比LayerNorm和RMSNorm的区别和应用场景

OpenClaw本地安装记录

Openclaw本地安装记录

linux非root用户安装CUDA和cudnn(centos7/Ubuntu cuda12.3为例)

介绍了cuda和cudnn安装的完整过程

论文《NWD》和YOLOv8中的实现提升小目标检测A Normalized Gaussian Wasserstein Distance for Tiny Object Detection

对小目标检测的损失优化思路和代码复现、和A Normalized Gaussian Wasserstein Distance for Tiny Object Detection论文的理解

深度学习中LayerNorm与RMSNorm对比

对比LayerNorm和RMSNorm的区别和应用场景

深度学习中TorchScript原理、作用浅析(Trace/Script)

关于torch.jit.trace和torch.jit.script的使用以及其工作原理的理解