简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

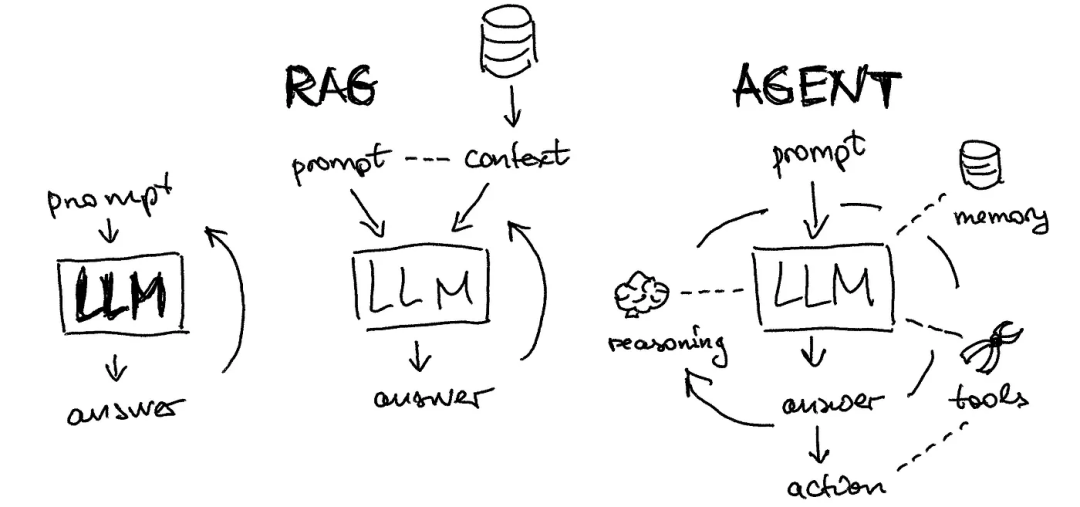

代理”这个词在AI出现之前就有了,哲学家们研究过它。像亚里士多德和大卫·休谟这样的大思想家都讨论过代理的概念,他们认为只要能自己做决定,不管是人、动物还是别的东西,都能称作代理。到了20世纪80年代,AI的研究者也开始关注这个概念了。目前,我们倾向于把所有能够感知环境、做出决策并采取行动的实体或系统视为人工智能领域的代理。而AI Agent,即人工智能代理,被定义为一个能够自主执行任务、做出决策并

空间-时间图神经网络(STGNNs)在时间序列预测中表现良好,但在股票预测中效果不佳,因缺乏明确的空间关系。一些STGNNs通过时间序列学习空间关系,但往往不够全面。研究表明,使用特征变化作为标记建模时间序列能揭示不同信息。本文提出双路径自适应相关空间-时间反转Transformer(DPA-STIFormer),通过特征变化建模节点。DPA-STIFormer引入双向自适应融合机制,分解节点编码

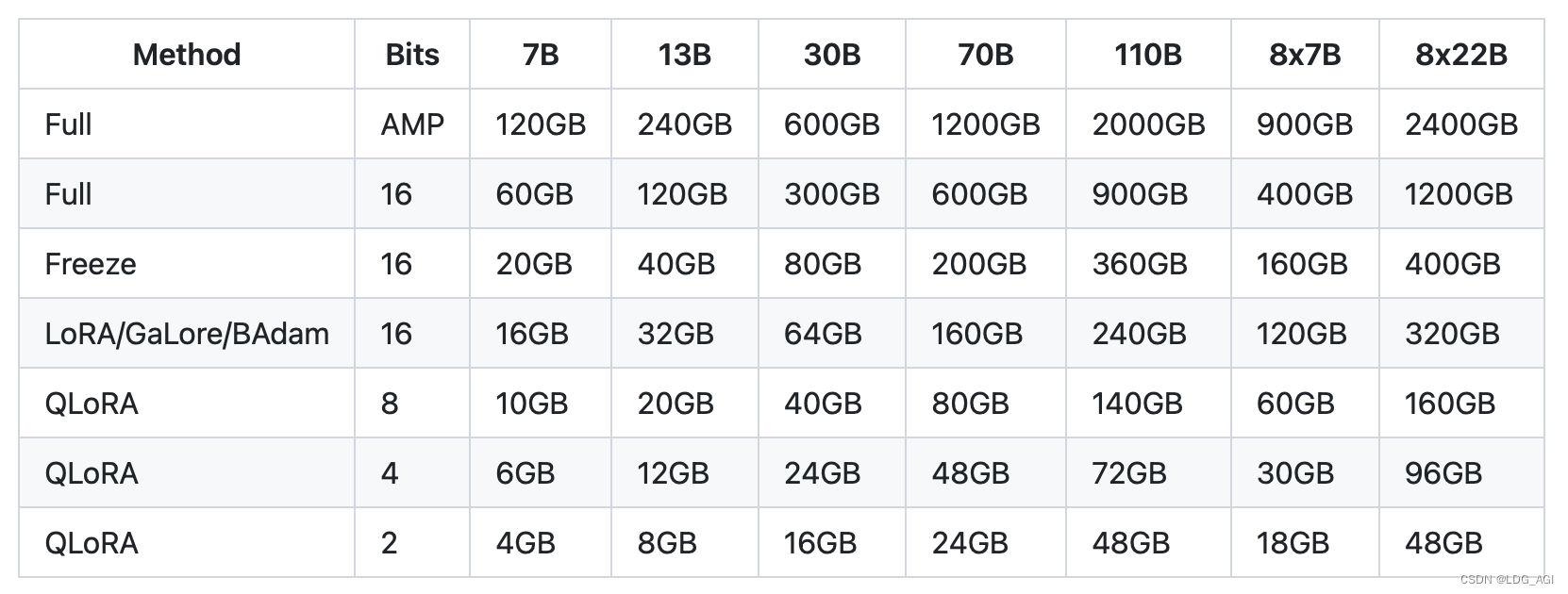

本文首先对量化和微调的原理进行剖析,接着以Qwen2-7B为例,基于QLoRA、PEFT一步一步带着大家微调自己的大模型,本文参考全网peft+qlora微调教程,一步一排坑,让大家在网络环境不允许的情况下,也能丝滑的开启大模型微调之旅。

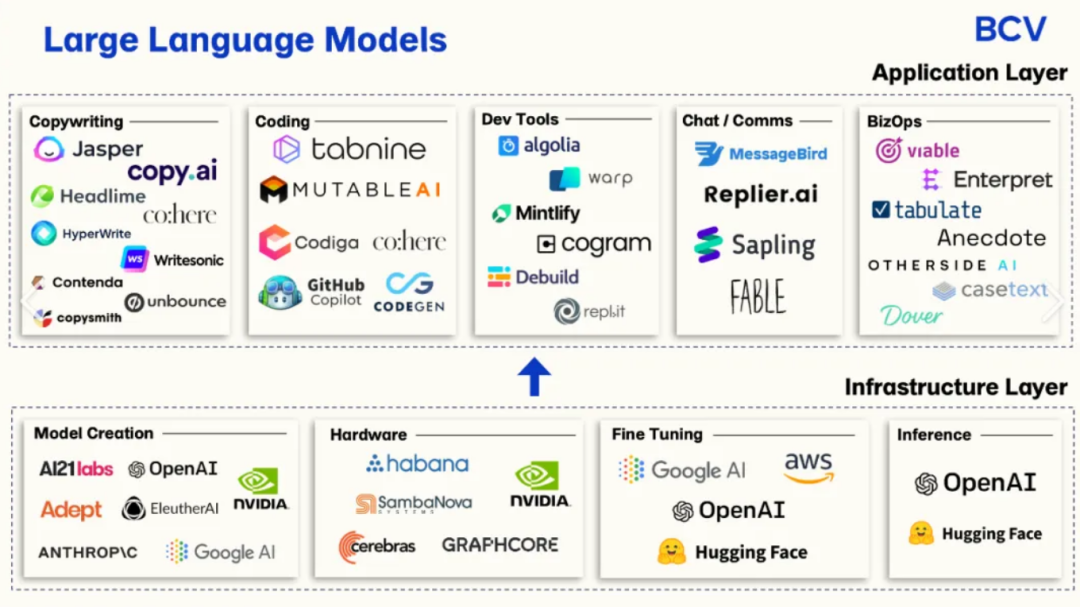

大语言模型(Large Language Models)是一种采用大量数据进行训练的人工智能模型,旨在理解和生成自然语言文本。这些模型通常基于深度学习技术,能够捕捉语言的复杂性和多样性。大语言模型在自然语言处理(NLP)领域中扮演着重要角色,广泛应用于文本生成、机器翻译、情感分析、问答系统等多种任务。

随着科技的不断发展,人工智能已经成为了当今世界的热门话题之一。在这个领域,研究和发展的趋势也在不断变化。强化学习是人工智能领域的一个重要分支,它通过智能体与环境的交互学习来实现目标。近年来,随着深度学习技术的不断进步,强化学习取得了许多突破,成为人工智能研究的热点之一。自然语言处理是人工智能领域的重要应用之一,它涉及到语音识别、语义理解、机器翻译等多个方面。随着深度学习技术的应用,自然语言处理的效

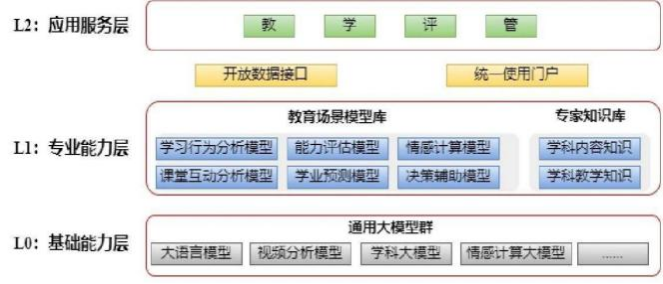

7月1日下午,2024全球数字经济大会人工智能专题论坛在中关村国家自主创新示范区会议中心举办。论坛紧扣大模型应用落地这一热点,以“应用即未来——大模型赋能千行百业,新生态拥抱产业未来”为主题,备受社会各界关注。

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。LLM是一种人工智能技术,可以生成类似人类语言的文本,而LLM智能体则是一种扩展了LLM的系统,它可以执行更复杂的任务,例如搜索信息、使用工具和执行操作。由于新岗位的生产效率,要优于被取代岗

基于规则的文本摘要技术:这一阶段的文本摘要技术主要依赖于人工设计的规则和策略,如关键词提取、短语提取、句子压缩等。这些方法虽然简单易用,但缺乏通用性和灵活性。基于机器学习的文本摘要技术:随着机器学习技术的发展,基于机器学习的文本摘要技术逐渐成为主流。这一阶段的方法主要包括:基于模板的方法:这种方法通过训练模板模型,将原始文本映射到预定义的摘要模板上,生成摘要。基于序列标注的方法:这种方法将文本摘要

多模态大模型是指能够同时处理和整合来自多种输入形式(如文本、图像、音频等)的大型机器学习模型。这些模型通过理解和生成多种形式的数据,能够执行跨模态任务,例如从图像生成描述性文本,或根据文本生成相关的图像。这类模型结合了视觉和语言理解能力,使得它们能够在多种应用场景中发挥作用,从而突破单一模态的限制,提供更加丰富和交互性强的用户体验。文章有点长,简单帮大家总结下:首先,对于微小目标识别,医疗影像中的

国内第1本Transformer——变形金刚红书如果一定要说未来谁能引领人工智能世界,是Transformer而非chatGPT!编辑推荐★★★★★ChatGPT红得发紫,强得让人类心悸。但在它的背后,还隐藏着一位真正的大佬。它的名字叫做——Transformer!