简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

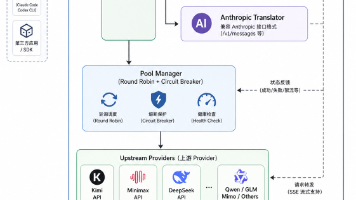

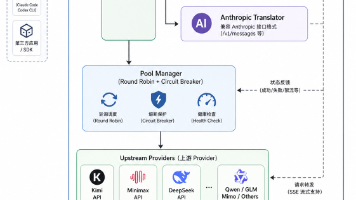

one-codingplan (ocp) 是一个轻量级AI编程工具聚合器,可统一管理多个AI编程服务(如Kimi、Claude、DeepSeek等)。核心功能包括:1)多Provider支持,开箱即用;2)智能故障转移,自动切换可用服务;3)兼容OpenAI和Anthropic两种API格式;4)完整的访问控制和额度管理。采用Go语言开发,内置SQLite数据库和React管理后台,实现零依赖部署

one-codingplan (ocp) 是一个轻量级AI编程工具聚合器,可统一管理多个AI编程服务(如Kimi、Claude、DeepSeek等)。核心功能包括:1)多Provider支持,开箱即用;2)智能故障转移,自动切换可用服务;3)兼容OpenAI和Anthropic两种API格式;4)完整的访问控制和额度管理。采用Go语言开发,内置SQLite数据库和React管理后台,实现零依赖部署

摘要:Ubuntu 24.04用户在升级OpenClaw至2026.3.2版本后遇到systemctl用户服务检查失败问题。根本原因是新版本增加了对用户级systemd服务的严格检查,而Ubuntu 24.04的非登录会话可能未正确初始化用户级systemd环境。临时解决方案包括:1)设置XDG_RUNTIME_DIR和DBUS_SESSION_BUS_ADDRESS环境变量;2)创建占位服务文件

摘要:Ubuntu 24.04用户在升级OpenClaw至2026.3.2版本后遇到systemctl用户服务检查失败问题。根本原因是新版本增加了对用户级systemd服务的严格检查,而Ubuntu 24.04的非登录会话可能未正确初始化用户级systemd环境。临时解决方案包括:1)设置XDG_RUNTIME_DIR和DBUS_SESSION_BUS_ADDRESS环境变量;2)创建占位服务文件

摘要:Ubuntu 24.04用户在升级OpenClaw至2026.3.2版本后遇到systemctl用户服务检查失败问题。根本原因是新版本增加了对用户级systemd服务的严格检查,而Ubuntu 24.04的非登录会话可能未正确初始化用户级systemd环境。临时解决方案包括:1)设置XDG_RUNTIME_DIR和DBUS_SESSION_BUS_ADDRESS环境变量;2)创建占位服务文件

本文中使用的语言为c++,使用的三方库为fftw,libsndfile音频的时域转频域这一部分主要使用傅里叶变换,将时域转成频域。这一块的帖子已经很多,这里不再赘述了。主要注意点如下:fftw库的使用,请参考 fftw官网libsndfile库的使用,请参考 libsndfile官网窗体采用汉宁窗,宽度为512ms,处理音频采样率为8k,16bit,单声道,窗体移动为1/2窗体宽度...

时域上尝试如原始音频时域如下:假如将所有数据乘上5. 可以发现有些地方都“破音”了。for (int i = 0; i < N; ++i) {in[i] =in[i]*5;}效果如下,频域上的尝试这种操作在频域中也可以做。将时域数据通过DFT转成频域数据,然后在实数部分和虚数部分都乘以相同系数5。for (int i = ...

torch.nn.GroupNorm字面意思是分组做Normalization,官方说明在这里。torch.nn.GroupNorm(num_groups, num_channels, eps=1e-05, affine=True, device=None, dtype=None)计算公式E[x]是x的均值;Var[x]是标准差;gama和beta是训练参数,如果不想使用,可以通过参数affine

转载于https://cloud.tencent.com/developer/article/1049579,如有侵权,请联系 chris.zhang@wiz.ai 删除深度学习模式可能需要几个小时,几天甚至几周的时间来训练。如果运行意外停止,你可能就白干了。在这篇文章中,你将会发现在使用Keras库的Python训练过程中,如何检查你的深度学习模型Checkpoint神经网络模型应用程序Chec

有的时候我们需要计算多个batch的CrossEntropyLoss, 如下面的代码片段从官网上的例子来看, 一般input为(Number of Batch, Features), 而target一般为 (N,)