简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

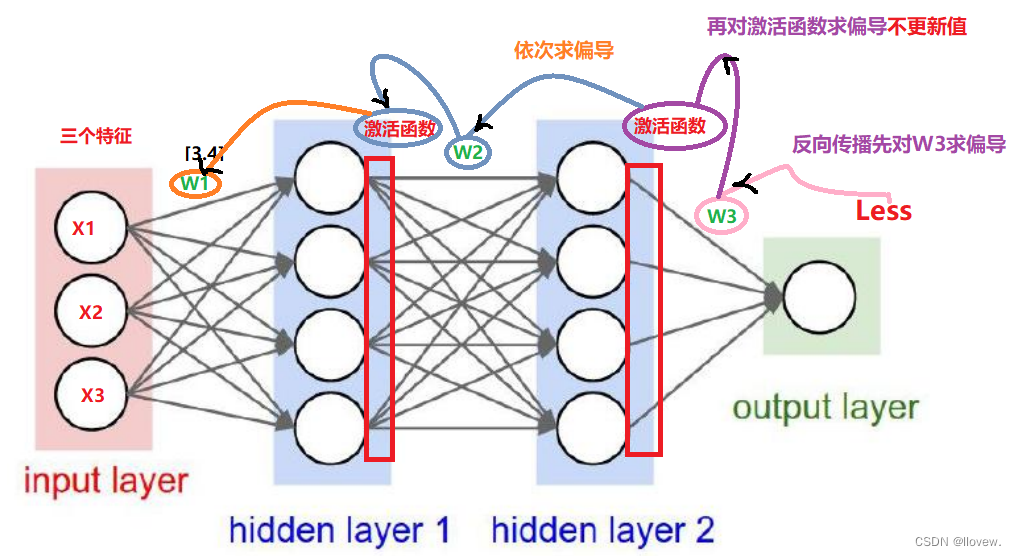

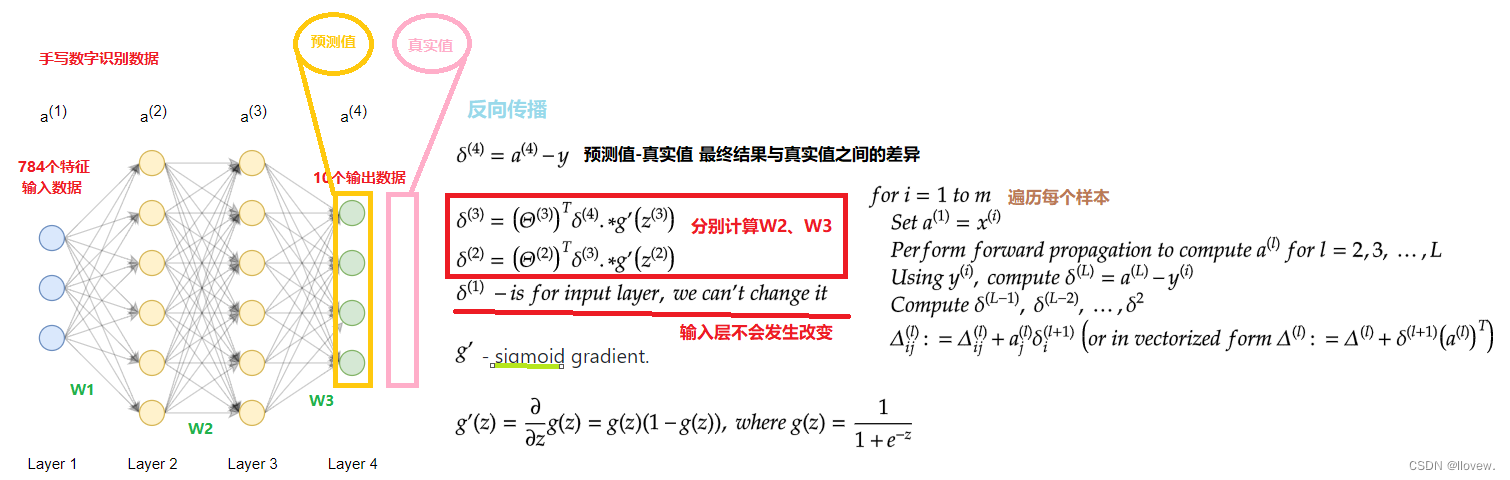

Dropout是一种常用的正则化技术,用于减少神经网络的过拟合问题。在训练过程中,Dropout会随机地将一部分神经元的输出置为0,这样可以强制网络去学习更加鲁棒的特征表示。具体来说,Dropout会以一定的概率p将某个神经元的输出置为0,而保留其他神经元的输出

损失函数定义# 获取层数# 样本个数# 分类个数# 前向传播走一次# 制作标签,每一个样本的标签都得是one-hot# 将对应的位置改为 1# 计算损失。

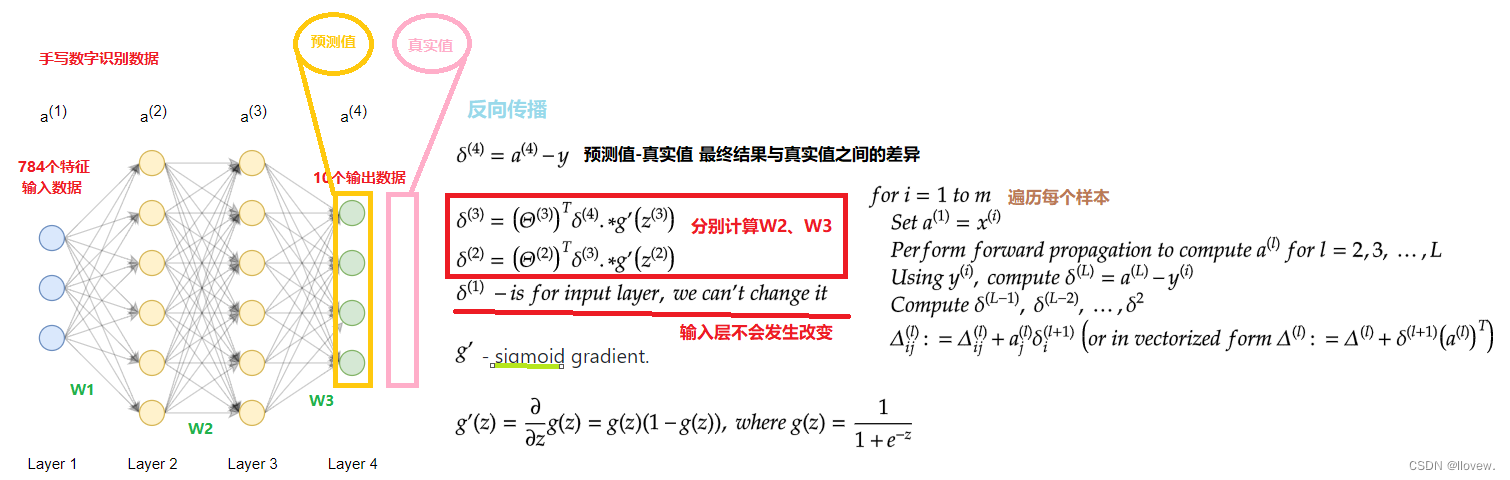

它是训练模型时所需要最小化或最大化的目标函数,通过调整模型参数,使得损失函数的值达到最小或最大,在模型预测结果与实际结果之间找到最优的拟合程度。通过使用正弦函数特征,可以对数据进行平滑处理,从而减少噪声的影响并提取出数据中的主要趋势。3. 对数损失(Logarithmic Loss,或称为逻辑损失,Log Loss):常用于二分类问题的损失函数,衡量模型输出的概率与实际标签之间的负对数似然。总而言

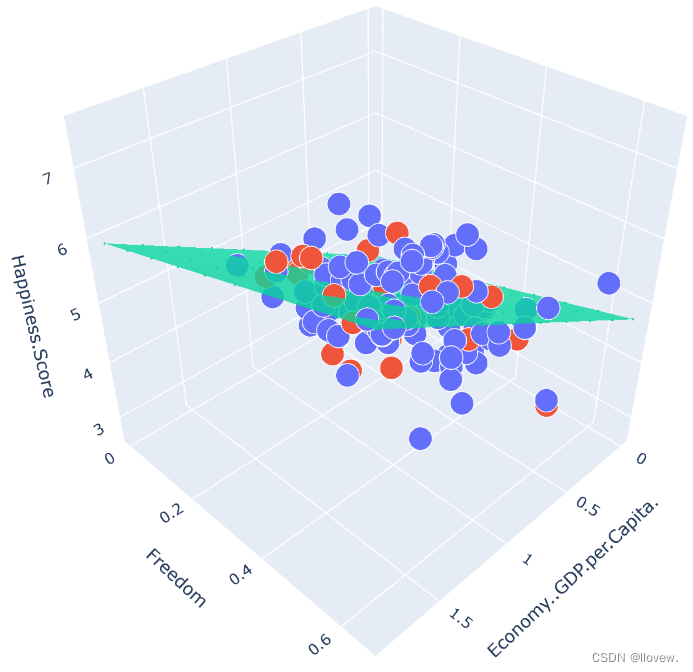

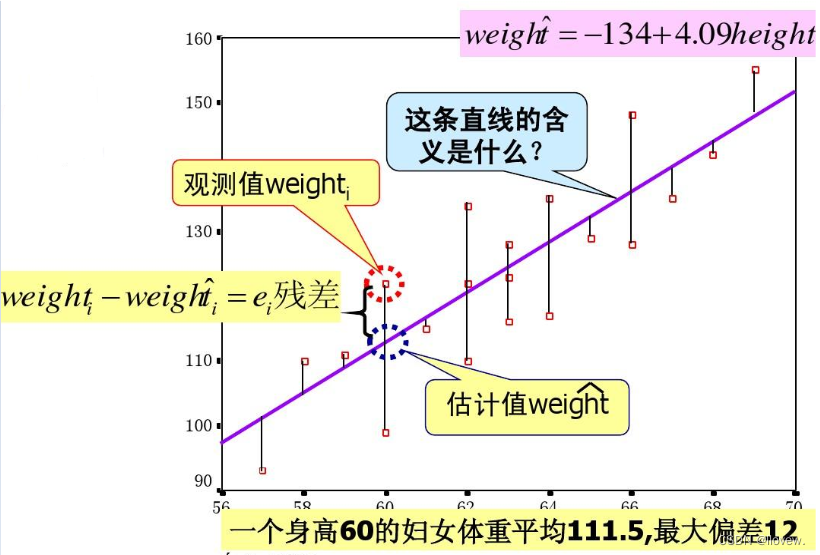

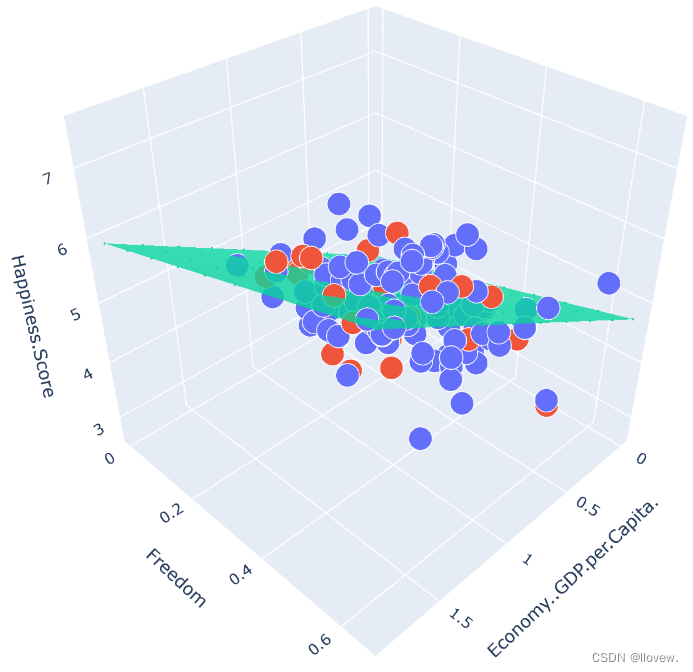

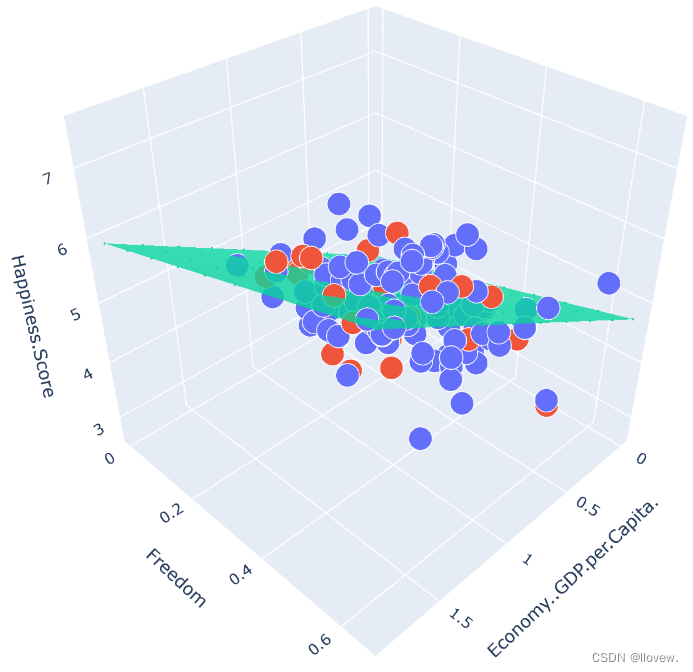

相关分析是研究两个或两个以上的变量之间相关程度及大小的一种统计方法回归分析是寻找存在相关关系的变量间的数学表达式,并进行统计推断的一种统计方法在对回归分析进行分类时,主要有两种分类方式:根据变量的数目,可以分类一元回归、多元回归根据自变量与因变量的表现形式,分为线性与非线性所以,回归分析包括四个方向:一元线性回归分析、多元线性回归分析、一元非线性回归分析、多元非线性回归分析。因变量(depende

它是训练模型时所需要最小化或最大化的目标函数,通过调整模型参数,使得损失函数的值达到最小或最大,在模型预测结果与实际结果之间找到最优的拟合程度。通过使用正弦函数特征,可以对数据进行平滑处理,从而减少噪声的影响并提取出数据中的主要趋势。3. 对数损失(Logarithmic Loss,或称为逻辑损失,Log Loss):常用于二分类问题的损失函数,衡量模型输出的概率与实际标签之间的负对数似然。总而言

损失函数定义# 获取层数# 样本个数# 分类个数# 前向传播走一次# 制作标签,每一个样本的标签都得是one-hot# 将对应的位置改为 1# 计算损失。

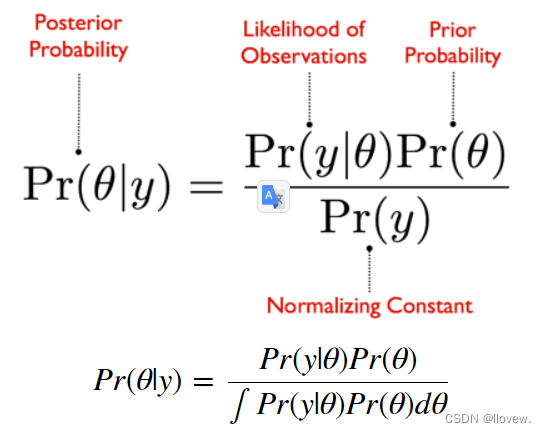

贝叶斯分析(Bayesian analysis)是一种基于贝叶斯定理的统计推断方法,用于从观测数据和先验知识中推断出参数的后验分布。这种方法能够帮助我们根据已有的信息更新我们对未知参数的置信度。贝叶斯分析的过程可以简单描述如下:1. 设定先验分布:首先,我们需要选择一个适当的先验分布来表示我们对参数的先有信念,这个先验分布可以是由领域知识、历史数据或专家经验得到的。2. 收集观测数据:接下来,我们

它是训练模型时所需要最小化或最大化的目标函数,通过调整模型参数,使得损失函数的值达到最小或最大,在模型预测结果与实际结果之间找到最优的拟合程度。通过使用正弦函数特征,可以对数据进行平滑处理,从而减少噪声的影响并提取出数据中的主要趋势。3. 对数损失(Logarithmic Loss,或称为逻辑损失,Log Loss):常用于二分类问题的损失函数,衡量模型输出的概率与实际标签之间的负对数似然。总而言

损失函数定义# 获取层数# 样本个数# 分类个数# 前向传播走一次# 制作标签,每一个样本的标签都得是one-hot# 将对应的位置改为 1# 计算损失。

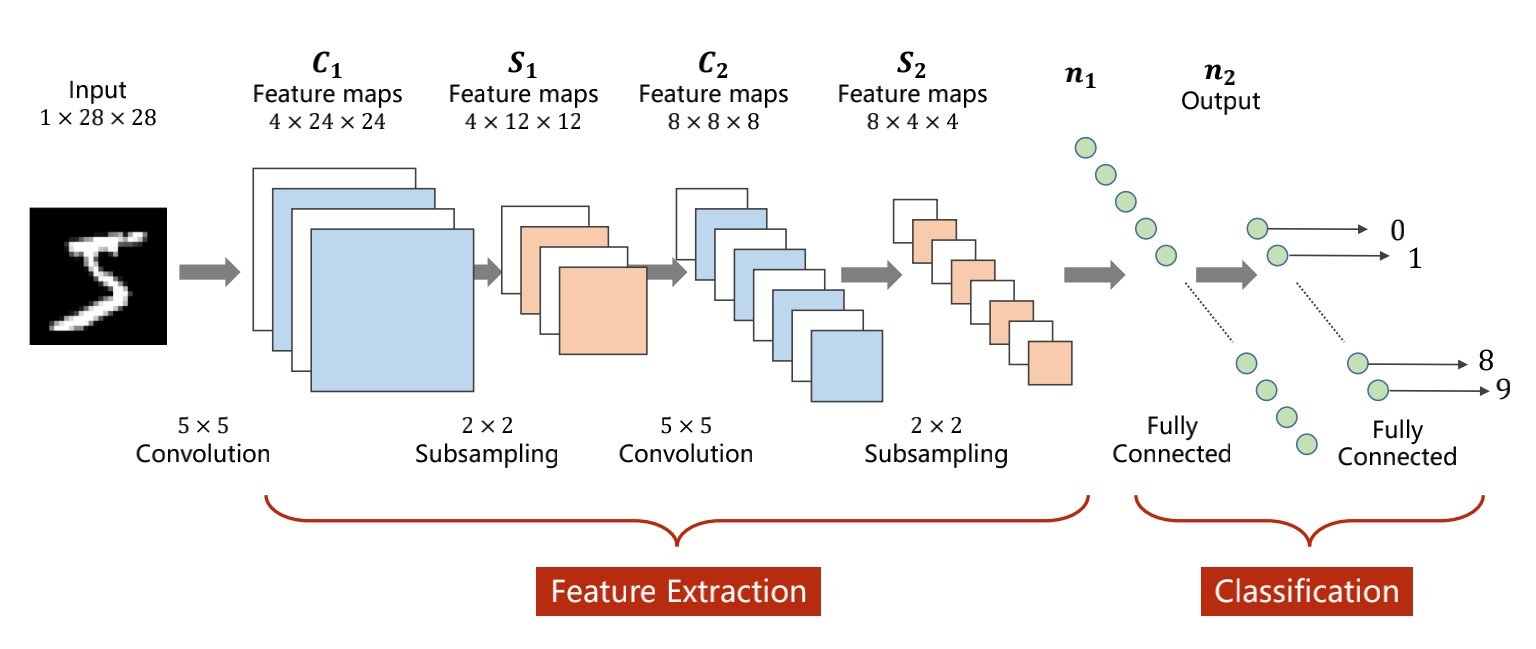

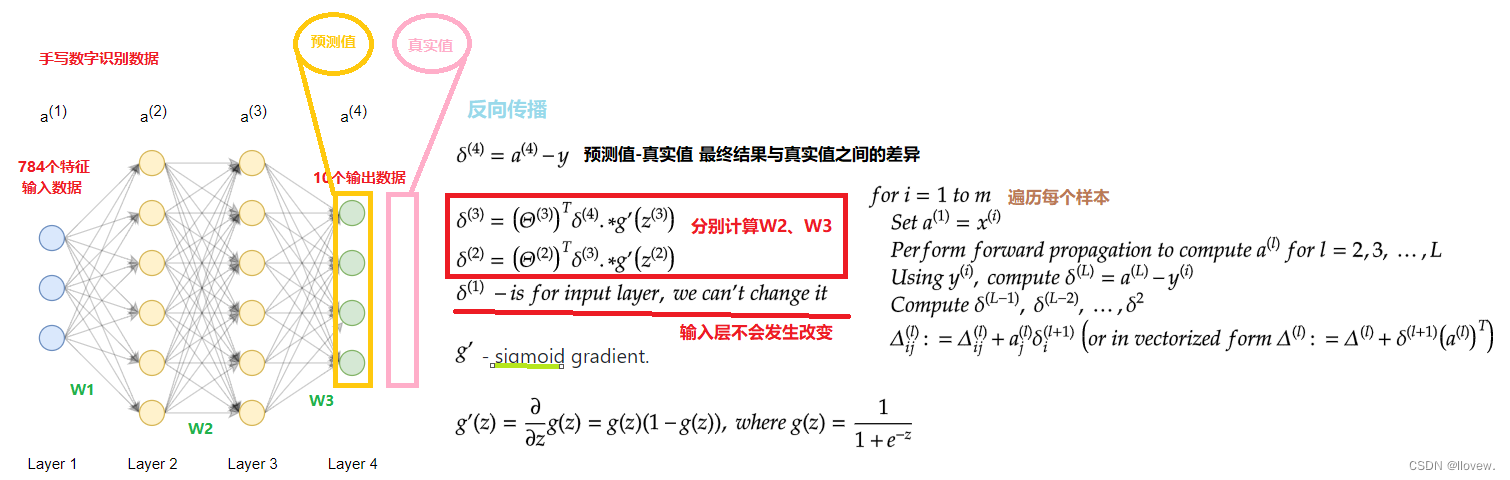

卷积神经网络(CNN)实现MNIST手写数字识别