简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Obsidian是一款基于本地Markdown文件的笔记工具,具有数据安全、格式开放的特点。其核心优势在于所有笔记均为独立Markdown文件,即使软件停更也能继续使用。用户可通过GitHub实现自动同步备份,确保数据安全。Obsidian与AI工具(如Claude Code)结合可实现多种高效功能:通过Claudian插件进行笔记整理、知识图谱构建;利用Skills实现论文推荐解读、图片管理优化

摘要 工程变更传播分析研究设计变更如何沿产品、流程和组织网络扩散,涉及多学科交叉方法。本文梳理了关键研究路线:基于DSM/复杂网络建模传播路径,利用多智能体仿真动态模拟变更扩散过程,并通过优化算法选择控制方案。推荐了必读文献(如2022年综述和2017年多智能体方法论文)及开源工具链(Mesa、NetworkX、PuLP等),为构建可复现的研究原型提供路线图。研究重点在于将静态网络分析、动态仿真与

本文探讨了大模型系统落地中的多目标调优问题,分析了效果、成本、延迟和安全之间的平衡挑战。文章汇总了五个关键方向的开源解决方案:1)多目标偏好对齐(如MODPO、DPA);2)推理时动态控制(如MOD);3)RAG/Agent系统优化(如syftr);4)多模型路由调度(如ParetoBandit);5)LLM Serving自动优化(如VibeServe)。这些方法帮助在Pareto最优前沿找到最

摘要:大语言模型的多目标对齐研究进展 当前大语言模型对齐研究正从单一偏好优化转向多目标协同优化。传统RLHF/DPO方法将人类偏好压缩为标量奖励,难以平衡实际应用中相互冲突的多维目标(如帮助性、安全性、简洁性等)。本文梳理了11个代表性开源项目,归纳出5条技术路线:多目标DPO优化、帕累托前沿插值、推理时动态控制、多目标奖励建模和策略无关对齐。重点介绍了MODPO、Rewarded Soups、R

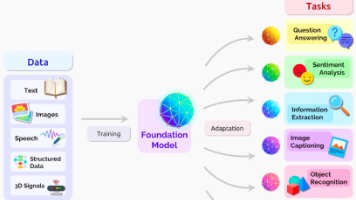

2025年起,AI编码工具从单代理转向多代理协作成为关键趋势。本文评测了7个解决Claude Code与Codex CLI协作问题的开源项目: agor - 功能最全面的多代理操作系统,提供可视化画布和MCP通信,适合团队基础设施 claude-squad - 最均衡的终端管理器,使用tmux+git worktree隔离,适合快速上手 myclaude - 方法论导向的工作流框架,提供路由编排和

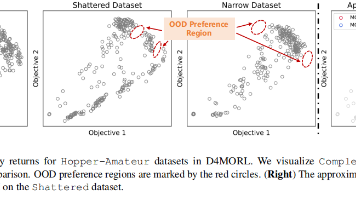

本文提出MODULI框架,解决离线多目标强化学习中的分布外偏好泛化问题。MODULI基于条件扩散模型生成面向偏好的轨迹,通过两种多偏好回报归一化方法(偏好预测归一化和邻域偏好归一化)优化生成引导,并设计滑动引导机制实现从分布内到分布外偏好的平滑过渡。实验表明,MODULI在D4MORL基准上超越现有方法,显著提升了分布外偏好的泛化能力。该框架通过将决策过程转化为条件生成任务,利用扩散模型的强大表达

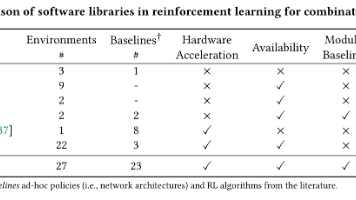

强化学习已成为求解 NP 难组合优化(CO)问题的主流范式,RL4CO 作为统一开源基准框架,集成 27 类环境与 23 个基线模型,标准化了研究流程。本文围绕 RL4CO,详解了 CO 问题的 MDP 建模方法,对比构造式与改进式策略、归纳式与转导式训练算法,分析各类解码策略的优劣,并分享关键实验洞察:模块替换可显著提升性能,构造式与改进式混合范式效果最优。同时介绍框架工程设计要点,指出 CO

本文围绕边际似然与贝叶斯因子展开,系统梳理其在强化学习多方向的模型比较应用。首先介绍边际似然内置奥卡姆惩罚、适配跨结构模型对比的核心特性及主流估计方法;随后分别从认知行为 RL 建模、贝叶斯元强化学习、离线强化学习世界模型筛选、贝叶斯逆强化学习四大场景,分析边际似然的作用机制与实践范式,对比各类方法优劣,汇总工具、文献与估计技术,为贝叶斯框架下的强化学习模型选择提供理论与实践参考。

本文系统梳理了因果推理领域的核心框架、研究方向与技术进展。主要内容包括:1)领域概览,介绍Pearl因果层级理论和七大研究方向的关系图;2)因果发现,总结主流算法类别(约束型、评分型、深度学习型等)及重要工具;3)因果效应估计,分析核心方法(倾向得分、双重机器学习等)和开源库;4)因果表示学习,作为连接深度学习与因果推理的桥梁。文章特别强调LLM在因果推理中的横切应用价值,并提供了各方向的入门路径

Obsidian是一款基于本地Markdown文件的笔记工具,具有数据安全、格式开放的特点。其核心优势在于所有笔记均为独立Markdown文件,即使软件停更也能继续使用。用户可通过GitHub实现自动同步备份,确保数据安全。Obsidian与AI工具(如Claude Code)结合可实现多种高效功能:通过Claudian插件进行笔记整理、知识图谱构建;利用Skills实现论文推荐解读、图片管理优化