简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

人工智能赋能产业大赛备战指南与赛事信息摘要 【参赛建议】 研读赛事规则,组建跨学科团队 聚焦六大技术赛道(机器人/汽车/芯片等) 开发创新性AI解决方案原型 准备商业计划与路演展示 【赛事亮点】 分创新/初创/成长三组别 最高2000万项目支持+30万奖金 往届优秀案例:医疗AI配体筛选、飞行机器人等 推动AI与制造业深度融合 【关键信息】 报名截止:2025年10月 需满足学历、创业经历等七项条

本文梳理了具身智能、智能机器人和人形机器人的概念区别及相互关系。具身智能是人工智能的重要分支,强调智能体通过物理实体与环境交互,实现感知、认知、决策和行动一体化,其表现形式多样。智能机器人是具身智能的一种具体应用,需具备物理身体和与物理世界交互的能力。人形机器人则是智能机器人的高级形态,模仿人类外形和行为。专家指出,人形机器人虽具心理亲近感,但技术难度大、成本高;而具身智能更注重实际功能,不局限于

定义:AI是能够感知环境、思考、学习并根据目标采取行动的计算机系统。AI的形式自动化智能:自动化手动和认知任务。辅助智能:帮助人们更快更好地完成任务。增强智能:帮助人们做出更好的决策。自主智能:无需人类干预即可做出决策。广义定义:AI是计算机系统,能够感知环境、思考、学习,并根据感知和目标采取行动。AI的形式自动化智能:自动化手动/认知和常规/非常规任务。辅助智能:帮助人们更快更好地完成任务。增强

人工智能为知识管理带来了前所未有的机遇,通过智能化的工具和技术,企业可以更高效地管理和利用知识资源,提升运营效率和竞争力。在当今快速变化的商业环境中,知识管理(KM)已成为企业提升竞争力和创新能力的关键因素。有效的知识管理能够促进信息共享、提升团队协作、优化决策过程。同时由于 AI 大语言模型能力的持续加强,其对企业知识管理应用场景具有强大的促进作用。

将人工智能创新与核心战略目标和绩效指标对齐至关重要,切不可让一系列分散的举措各自为政。在我们经验中,许多组织已启动了各类试点项目。但多数未深入审视人工智能如何颠覆其特定业务,进而明确其中的风险与机遇。

RHOS四元范式:具身智能的系统性突破 RHOS Lab提出的Robot-Human-Object-Scene四元范式重构了具身智能的研究框架,其核心创新在于: 动态交互系统:突破传统机器人学的三元局限,将Human作为独立要素,形成6组交互关系(人机协作、物体操作、场景嵌入等) 层级认知架构:从底层像素感知到高层推理形成四级递进,通过ViFailback实现失败诊断,HAKE解析人体动作语义,S

RHOS四元范式:具身智能的系统性突破 RHOS Lab提出的Robot-Human-Object-Scene四元范式重构了具身智能的研究框架,其核心创新在于: 动态交互系统:突破传统机器人学的三元局限,将Human作为独立要素,形成6组交互关系(人机协作、物体操作、场景嵌入等) 层级认知架构:从底层像素感知到高层推理形成四级递进,通过ViFailback实现失败诊断,HAKE解析人体动作语义,S

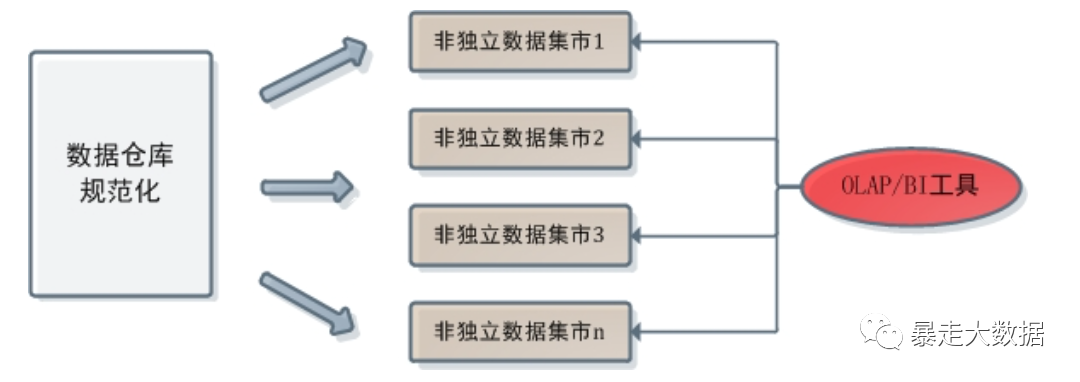

在数据立方体上的操作有:切片、切块、旋转、上卷和下钻。

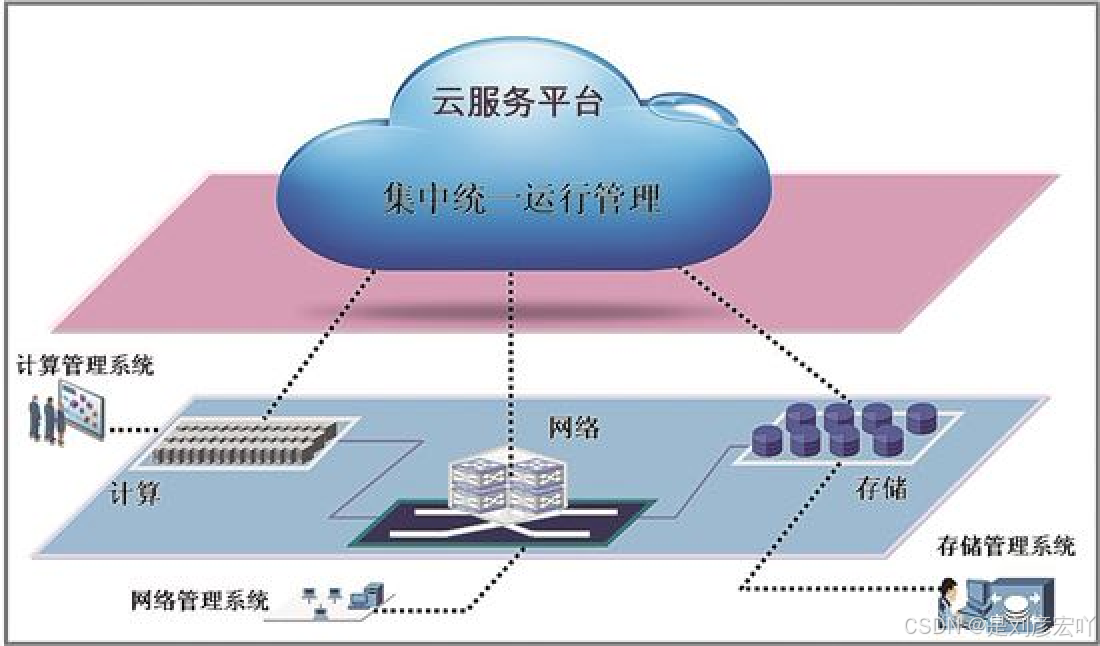

利用以大数据、云计算、虚拟制造、人工智能、知识自动化等为代表的新一代信息技术在智能制造中进行数据处理,对海量的跨地域、跨行业、跨部门的数据和信息进行处理分析,能提升对物理世界、经济社会、经济社会各种活动和变化的洞察力,实现智能化的决策,将在智能制造活动中发挥重要作用。知识自动化通过把各种工业技术体系模型化,然后将模型移植到智能设计与制造平台上,并通过平台,来驱动各种软件,包括设计、仿真、计算、试验

摘要: “聚森智能”AI烹饪机器人项目提出一套全自动中餐烹饪系统,通过五大核心技术课题实现无人化生产。 多食材抓取系统:基于3D视觉与柔性末端执行器,抓取成功率≥99.5%。 AI视觉质检:定位精度±0.5mm,实现食材分类与成品质量检测。 仿生切配单元:机械臂力控切割,尺寸误差≤±0.5mm。 柔性协作系统:机械臂与炒锅无缝衔接,单菜流程≤180秒。 中央调度系统:数字孪生监控,支持多任务并行与