简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文给出一条参考部署路径:环境安装 → optimum-cli 一键导出 INT4 IR → openvino-genai LLMPipeline 推理 → Hybrid Reasoning 双模式实战。

本文给出一条参考部署路径:环境安装 → optimum-cli 一键导出 INT4 IR → openvino-genai LLMPipeline 推理 → Hybrid Reasoning 双模式实战。

围绕英特尔酷睿Ultra硬件平台与OpenVINO™ 推理加速工具链,结合飞桨框架与FastDeploy极速部署能力,深度拆解多模态模型在通用算力设备上的适配逻辑、提速技巧与性能调优策略,详解产业级AI部署的技术要点与工程难题解法。聚焦飞桨开源技术体系、文心大模型多模态能力与英特尔oneAPI全栈开发生态,解读软硬件协同适配的底层逻辑,展示通用算力环境下,文档智能识别、图文解析、结构化提取等AI应

围绕英特尔酷睿Ultra硬件平台与OpenVINO™ 推理加速工具链,结合飞桨框架与FastDeploy极速部署能力,深度拆解多模态模型在通用算力设备上的适配逻辑、提速技巧与性能调优策略,详解产业级AI部署的技术要点与工程难题解法。聚焦飞桨开源技术体系、文心大模型多模态能力与英特尔oneAPI全栈开发生态,解读软硬件协同适配的底层逻辑,展示通用算力环境下,文档智能识别、图文解析、结构化提取等AI应

本文给出一条与OpenVINO Notebooks 中minicpm-v-4.6 教程严格对齐的部署路径。

本文给出一条与OpenVINO Notebooks 中minicpm-v-4.6 教程严格对齐的部署路径。

TutorialsFollow these tutorials for ways to create edge inferencing solutions using Intel® DevCloud and the Intel® Distribution of OpenVINO™ toolkit.9 ResultsAccess to additional search results is res

概括介绍相信在注册了Intel® DevCloud账号之后,肯定想马上登录到平台上操作一番,体验一下这个平台的功能是不是如我前面文章所述的一样呢。估计接下来你会跟我一样,碰到一个问题:这么多的教程和示例,从哪里开始呢?希望这篇文章可以跟你分享一下这方面的体验。Intel® DevCloud包含丰富的Jupyter* Notebook教程和示例,一般来讲,你肯定要从教程一步一步推进学习,这些Jupy

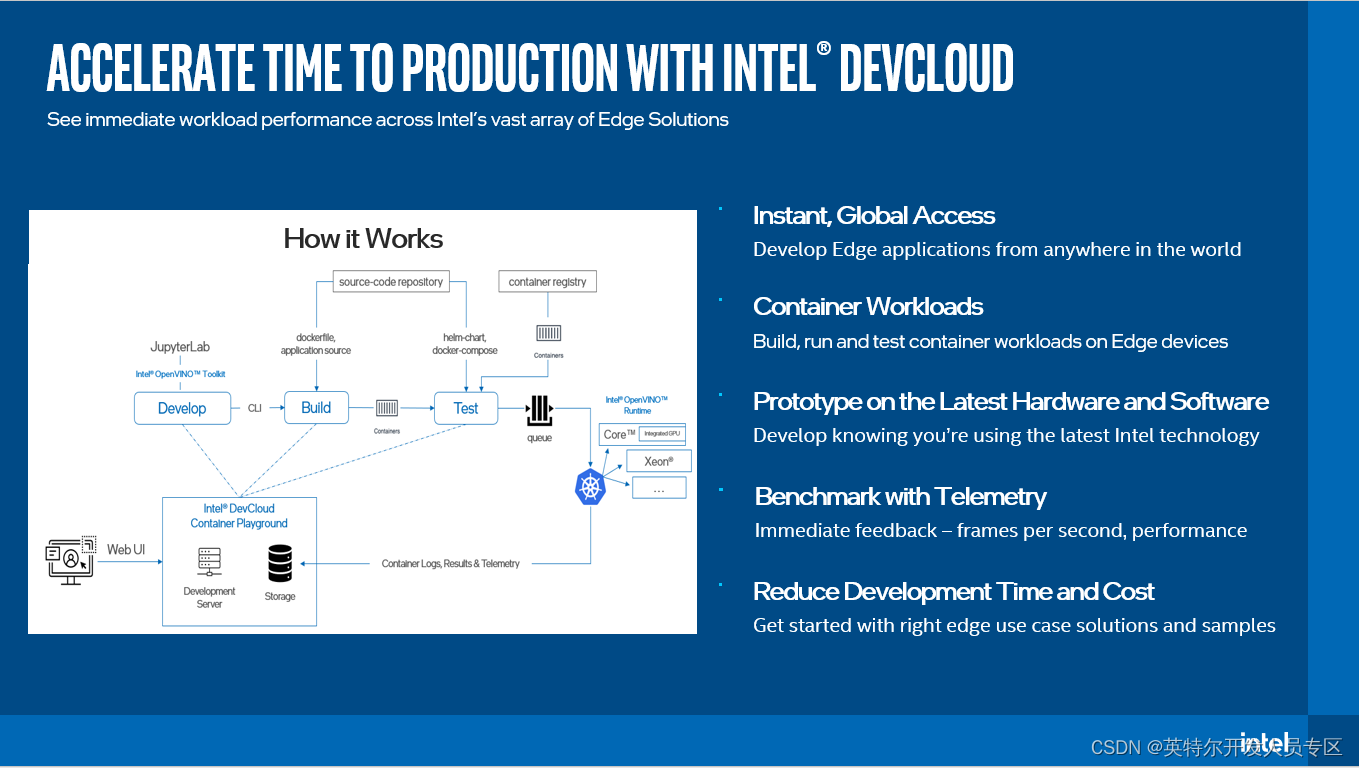

登录Intel® DevCloud平台后不需要对环境做任何配置,即可使用浏览器随时访问Intel® DevCloud上的教程和参考实例,无需考虑软硬件兼容问题,可以把更多精力用于自己应用程序的开发,在不同的边缘节点上部署验证,加速产品原型的开发和最终上市。开发节点是为开发者构建的开发环境部分,每个开发者都有自己独立的沙箱算力环境,在开发环境中已经构建Jupyter* UI交互环境和相关的软件栈,登

英特尔 OpenVINO™ 中文社区与魔搭社区联合发起「Intel AI PC 创新应用征文 \x26amp; OpenClaw 技能挑战赛」,旨在邀请每一位 AI 开发者,以代码探索端侧智能的无限可能。