简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在京东物流北京大兴临空智能物流园的童装仓内,100多个品牌近百万件商品正经历着一场静默的效率革命。近百台银灰色身形的"智狼"机器人以0.3秒/件的拣货速度穿梭于12米高的立体货架间,将传统仓库需要3小时完成的订单压缩至40分钟。这场由AI驱动的仓储变革,不仅创造了物流行业的效率新纪录,更揭开了智能机器人从实验室走向大规模应用的技术密码。

中国宇树科技发布全球首款量产载人变形机甲GD01,兼具双足/四足变形能力,载重500kg,定位民用交通工具。该机甲3-5秒可完成形态切换,时速最高7公里,配备载人操控舱实现人机协同。核心技术突破包括500kg级动态平衡控制、毫秒级响应算法和三段式铰接结构。研发依托GPU服务器提供AI算力支持,科研服务器则承担算法训练和海量数据处理任务,为机甲控制系统提供强大技术支撑。这款产品标志着中国在机器人领域

中国宇树科技发布全球首款量产载人变形机甲GD01,兼具双足/四足变形能力,载重500kg,定位民用交通工具。该机甲3-5秒可完成形态切换,时速最高7公里,配备载人操控舱实现人机协同。核心技术突破包括500kg级动态平衡控制、毫秒级响应算法和三段式铰接结构。研发依托GPU服务器提供AI算力支持,科研服务器则承担算法训练和海量数据处理任务,为机甲控制系统提供强大技术支撑。这款产品标志着中国在机器人领域

GPT-5.5 能独立完成 10 万字论文撰写 + 数据分析,腾讯混元 3D 0.1 秒生成可物理交互的 3D 模型,人形机器人精准接发球 —— 这些 2026 年的 AI 硬核突破,背后都离不开一台 “满配” GPU 服务器的算力支撑!2026 年大模型的突破不再是 “千亿参数” 的口号,而是可量化的性能提升,每一项都依赖 GPU 服务器的算力支撑:。AI “理解物理世界” 的突破,本质是3D

GPT-5.5 能独立完成 10 万字论文撰写 + 数据分析,腾讯混元 3D 0.1 秒生成可物理交互的 3D 模型,人形机器人精准接发球 —— 这些 2026 年的 AI 硬核突破,背后都离不开一台 “满配” GPU 服务器的算力支撑!2026 年大模型的突破不再是 “千亿参数” 的口号,而是可量化的性能提升,每一项都依赖 GPU 服务器的算力支撑:。AI “理解物理世界” 的突破,本质是3D

刷到宇树 H2 的训练视频了吗?180 厘米高、70 公斤重的 “钢铁巨人” 一记飞踢精准命中沙袋,紧接着侧空翻落地稳如磐石,整套动作丝滑得不像机器执行。但你知道吗?这看似简单的动作背后,藏着 31 个关节的冗余控制难题与 GPU 服务器的算力破局 —— 作为英伟达 Jetson Thor 的合作机型,H2 的每一次动作都离不开 “端 - 云” 算力的协同支撑。

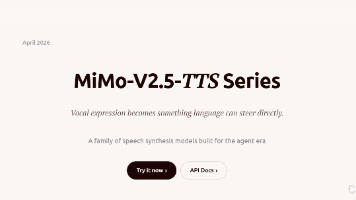

还在吐槽 AI 配音机械生硬、音色同质化严重,日常语音转写方言听不懂、杂音干扰、双语混读识别错乱?随着人工智能技术持续深耕,全新升级版全链路语音模型矩阵正式上线,语音合成三大模型全面开放且限时免费,高精度语音识别模型同步开源发布。从语音生成到语音解析双向技术升级,全方位拉高通用级与专业级语音应用的体验标准。本次迭代的语音合成系列共包含三款差异化模型,三者共用统一技术底座,具备一致的风格指令理解、音

当前内存、硬盘、显卡价格大幅上涨,科研算力平台搭建需在 “满足需求、控制成本、预留扩容” 间找平衡。以下,是当下兼顾性价比与扩展性的优选方案。

问题的答案藏在集邦咨询的刺眼数据里 ——2025 年四季度部分内存价格暴涨 300%,而 GPU 的 “性能引擎” HBM(高带宽存储器)正处于全球短缺的核心。对实验室而言,这不仅是设备性能的提升,更是学术突破的加速剂 —— 毕竟在 AI 驱动的科研时代,算力自由的前提,永远是内存自由。SK 海力士股价年涨 280% 的背后,是 HBM 市场的爆发式增长 —— 预计 2028 年市场规模将达 10

上海张江的蓝白巡逻车成了 “网红”:360 度镜头扫过违停车,15 分钟内车主收到挪车短信,二次巡逻未驶离才开罚单 —— 首日 119 次警告、3 张罚单的战绩,让网友直呼 “人性化”。但很少有人知道,这台无人警车的 “电子眼” 能连续工作 100 公里不 “罢工”,全靠 GPU 服务器的散热黑科技撑腰。拆解执法闭环:无人警车的 “算力生存战”