简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

git pull origin <分支名># 拉取远程最新代码并合并。git merge <目标分支># 将目标分支合并到当前分支。git push origin <分支名># 推送到远程分支。git clone <项目URL># 从 GitLab 拉取代码到本地。git add +路径 (可以多个) 添加修改到暂存区。git diff +文件路径查看修改位置。git diff +文件路径查看修改

通过网盘分享的文件:ubuntu_nvidia-container-toolkit_1.18.1_deb_amd64.tar.gz。链接: https://pan.baidu.com/s/10UZmyY55LGn6YD-CCir0Kg 提取码: btxj。链接: https://pan.baidu.com/s/1KaFQP547IJvvMQKOw4Om7g 提取码: qugk。执行 rpm -Uv

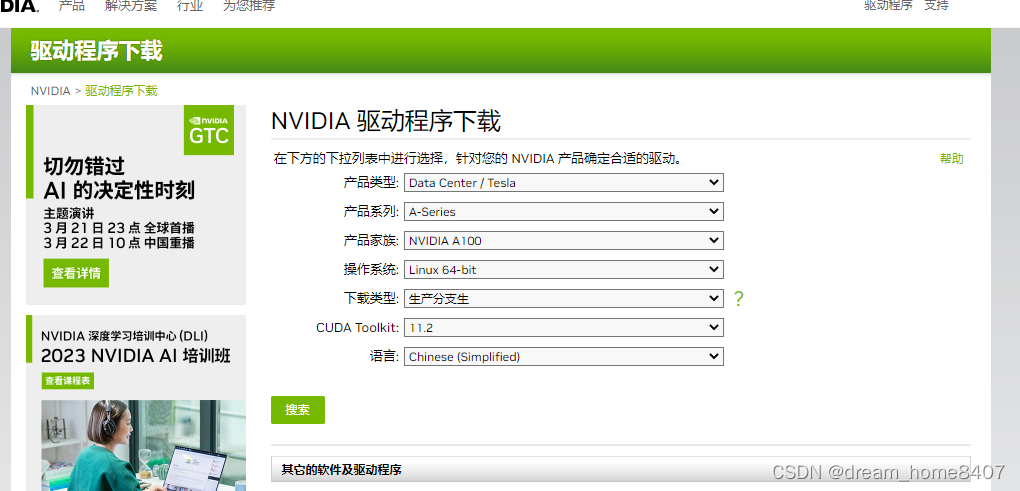

1.确认GPU型号和操作系统版本,本示例中以A100以及操作系统为Centos 7.9进行操作。准备GPU驱动和CUDA 11.2软件包,在nvidia官网进行驱动包和CUDA包下载链接:linux系统均选择 Linux 64-bitCUDA Toolkit选择最新版本如您需要老版本CUDA,请前往老版本CUDA下载本示例中使用CUDA 11.2。

docker compose stop可以快速停止服务,方便后续重新启动,而不必重新构建。而down则适合彻底重置环境。docker exec <容器名> lsof -i :80。docker logs --tail 100 <容器名>docker-compose down会删除容器和网络。docker port <容器名> 80/tcp。docker port <容器ID或名称>-f参数可指定任

通过网盘分享的文件:ubuntu_nvidia-container-toolkit_1.18.1_deb_amd64.tar.gz。链接: https://pan.baidu.com/s/10UZmyY55LGn6YD-CCir0Kg 提取码: btxj。链接: https://pan.baidu.com/s/1KaFQP547IJvvMQKOw4Om7g 提取码: qugk。执行 rpm -Uv

mysql 建立连接。

摘要:在CentOS 7.9系统上运行Docker容器时出现CUDA初始化错误(Error 304),主要原因是NVIDIA UVM内核模块未加载或设备节点缺失。解决方案包括:1)在宿主机手动加载nvidia-uvm模块并创建设备节点;2)配置Docker默认运行时为nvidia;3)以privileged模式重新启动容器。验证表明该方法能有效解决torch.cuda.is_available()

paddlenlp智能问答系统安装落地流程

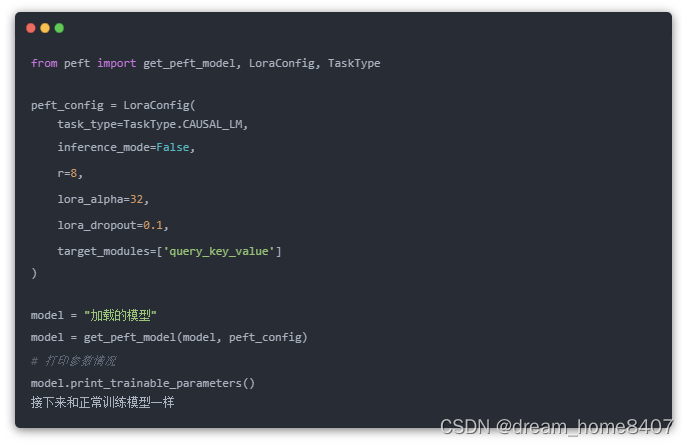

ChatGPT带领着大模型像雨后春笋一般层出不穷,大家都对大模型微调跃跃欲试,现在咱们聊聊其中的常见的算法。

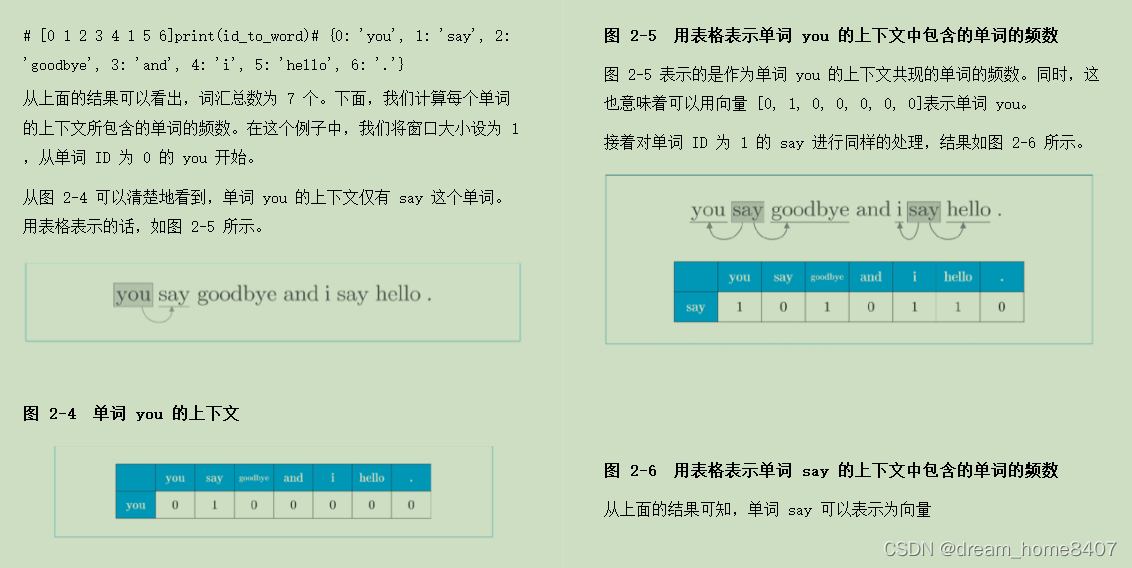

NLP自然语言处理理论解释(单词分布式表示,共现矩阵,word2vec,CBOW模型详解)