简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

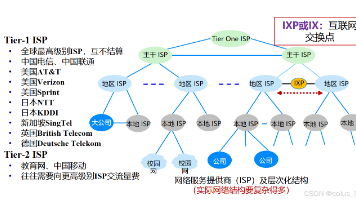

本文系统介绍了计算机网络的基本概念与技术。首先阐述了因特网的定义,包括其物理构成、服务模式和协议体系。随后详细解析了网络边缘的端系统、接入网技术和物理媒介,以及网络核心的分组交换与电路交换原理。文章还深入探讨了网络性能指标如时延、吞吐量、丢包率等,并分析了信号传输过程中的失真问题与信道容量限制。最后,通过对比OSI七层模型与TCP/IP四层模型,揭示了计算机网络的分层架构思想。全文从多维度构建了对

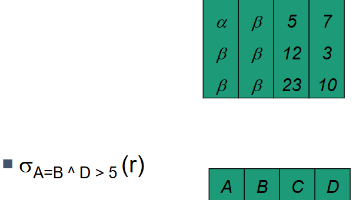

关系模式是关系的型(Type)关系名:表的唯一标识(如STUDENT属性集:表的列及其数据类型(如学号 CHAR(7)完整性约束:主键、外键、域约束等。形式化表示U属性集合(如D:属性对应的域(如SNO的域是7位数字)。DOM:属性到域的映射(如F:属性间的函数依赖(如PK:主键(如SNO键类型定义示例(STUDENT表)特点超键能唯一标识行的属性组合(含冗余){SNO}{ID}不要求最小性候选键

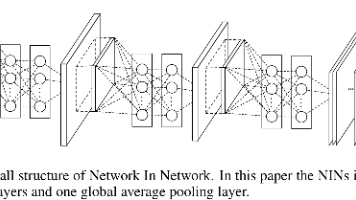

摘要:NiN(Network in Network)是2014年提出的一种创新卷积神经网络结构,旨在解决传统CNN的局限性。其核心创新包括:1)MLP卷积层,通过1x1卷积增强局部特征提取能力;2)全局平均池化替代全连接层,大幅减少参数量。相比AlexNet等传统网络,NiN在保持高表达能力的同时显著提升了参数效率。PyTorch实现显示,该结构在CIFAR-10等任务上表现优异,证明了其设计的前

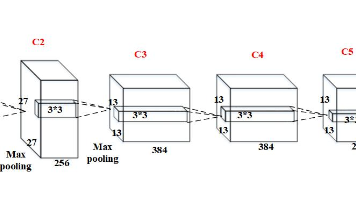

AlexNet是2012年提出的里程碑式卷积神经网络,在ImageNet竞赛中以15.3%的错误率远超传统方法。其创新包括:使用ReLU激活函数缓解梯度消失;采用Dropout和数据增强防止过拟合;首次利用GPU加速训练。该网络包含5个卷积层和3个全连接层,通过重叠池化提升特征不变性。实验表明,在Fashion-MNIST和CIFAR-10数据集上,带动量优化的SGD表现最佳,测试准确率分别达91

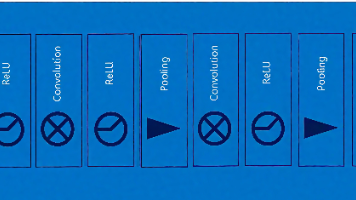

卷积神经网络(CNN)是一种专为处理网格结构数据(如图像)设计的深度学习模型,其核心优势在于局部连接、权值共享和池化操作。相比全连接网络,CNN通过局部感受野提取层次化特征,显著减少参数数量并保持空间信息。关键组件包括卷积层(特征提取)、ReLU激活函数(引入非线性)、池化层(信息压缩)和全连接层(分类)。CNN的发展始于1998年LeNet-5的提出,2012年AlexNet在ImageNet竞

数字图像本质上是离散化的像素矩阵,每个像素携带颜色/亮度信息。灰度图为二维矩阵,彩色图为三维张量(高度×宽度×通道)。CNN通过局部连接和权值共享有效处理图像的空间关系,避免传统神经网络处理图像时的参数爆炸问题。其层次结构从边缘检测到复杂特征提取,最终实现图像分类。典型处理流程包括卷积、池化等操作,将原始像素逐步转化为高级语义特征。CNN的设计解决了图像平移敏感性和空间信息丢失等核心问题。

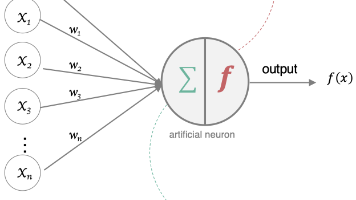

前馈神经网络是最基础的神经网络类型,信息单向流动(输入层→隐藏层→输出层),通过多层非线性变换实现端到端学习。文章详细介绍了神经网络的结构、激活函数(如Sigmoid、ReLU)、初始化方法(Xavier、He)、损失函数(交叉熵、均方误差)、优化算法(SGD、Adam)以及正则化技术(Dropout、L2正则化)。通过三个实践任务(XOR分类、MNIST手写数字识别、CIFAR10图像分类)展示

前馈神经网络是一种单向信息流动的人工神经网络,由输入层、隐藏层和输出层组成,是最基础的深度学习模型。其核心结构包括神经元(M-P模型)、感知机(单层线性分类器)和多层感知机(MLP)。MLP通过全连接层进行线性变换,配合激活函数引入非线性,从而能够拟合复杂函数关系。全连接层的参数包括权值矩阵和偏置项,通过多层非线性变换实现从数据到目标的端到端学习。这种结构使神经网络具备强大的特征提取和模式识别能力

本项目基于PyTorch框架构建了一个双向LSTM模型,用于IMDb电影评论的二分类情感分析(正面/负面)。模型采用2层LSTM结构,使用BCEWithLogitsLoss作为损失函数,在50,000条评论数据集上训练后达到74.44%的测试准确率。项目包含完整的数据预处理流程(文本清洗、词汇表构建)、模型实现(嵌入层+LSTM+全连接层)以及训练评估模块。分析发现模型存在明显过拟合现象(训练准确

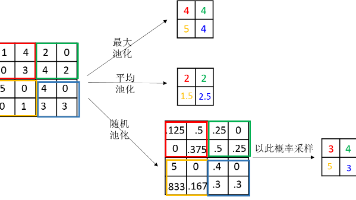

摘要:本文介绍了CNN中的池化与反池化操作。池化主要用于降维,包括最大池化(保留纹理特征)、平均池化(突出背景信息)和随机池化(平衡特征提取与过拟合)。重叠池化与卷积类似但运算方式不同。反池化包括反最大池化(需记录最大值位置)和反平均池化。池化层无需训练参数,能有效减少计算量。