简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文详细介绍了在NPU平台上微调InternVL3.5-1B和Intern-S1-mini模型的全流程。主要内容包括:1) 环境配置,包括创建算力实例、安装依赖包和处理数据集;2) 模型微调,详细说明了两种模型的配置文件编写、启动训练和权重合并方法;3) 结果提交,包含模型上传步骤和提示词优化建议。实验使用LoRA方法进行微调,提供了关键参数调整建议,并验证了NPU使用情况。整个过程涵盖了从环境搭

本文详细介绍了在NPU平台上微调InternVL3.5-1B和Intern-S1-mini模型的全流程。主要内容包括:1) 环境配置,包括创建算力实例、安装依赖包和处理数据集;2) 模型微调,详细说明了两种模型的配置文件编写、启动训练和权重合并方法;3) 结果提交,包含模型上传步骤和提示词优化建议。实验使用LoRA方法进行微调,提供了关键参数调整建议,并验证了NPU使用情况。整个过程涵盖了从环境搭

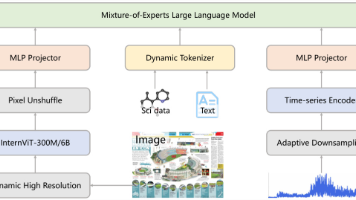

本文系统探讨了大模型语言的发展原理与关键技术应用。首先将大模型发展划分为五个阶段:基础认知构建、知识获取、专业定向、深度学习和实际应用。重点介绍了提示词工程的设计原则和框架,以及工具调用与MCP协议的技术实现。特别深入分析了Intern-S1这一科学领域多模态基础模型,包括其280B参数的MoE架构、动态分词器创新、混合奖励训练方法等核心技术突破。该模型在科学推理任务上超越闭源模型,展现了开源模型

本文介绍了书生Intern-S1 API的使用方法,包括环境搭建、API调用和多模态交互实现。详细讲解了如何获取API Token,并通过Python SDK和原生调用两种方式进行天气查询、小红书搜索等操作。同时介绍了Browser-Use工具的开发环境配置和Web-UI运行方法,展示了模型与浏览器的交互过程。文中还提供了三轮对话示例代码和API计费规则说明,并针对常见报错给出了解决方案。该技术目

本文介绍了使用LMDeploy工具链部署和优化大语言模型的完整流程。首先通过Conda环境安装所需依赖,然后演示了如何配置PytorchEngineConfig参数(如max_batch_size、enable_prefix_caching等)来优化推理性能。文章详细展示了多模态推理服务的构建方法,包括批量请求处理对比实验。针对显存不足的情况,重点讲解了INT4模型量化和KV Cache量化技术,

D.run平台注册和登录环节就跳过了。

mitmproxy 是一组工具,可为 HTTP/1、HTTP/2 和 WebSockets 提供支持 SSL/TLS 的交互式拦截代理。

OpenCompass 评测书生大模型实践

本文介绍了Intern系列模型API的使用方法,主要包括:1)获取API密钥和开发机配置;2)文本生成、图像分析、工具调用等基本功能实现;3)MCP协议的安装与配置,支持天气查询和文件系统操作等扩展功能。详细说明了环境准备、代码示例和注意事项,帮助开发者快速接入和使用该AI服务。

本文系统探讨了大模型语言的发展原理与关键技术应用。首先将大模型发展划分为五个阶段:基础认知构建、知识获取、专业定向、深度学习和实际应用。重点介绍了提示词工程的设计原则和框架,以及工具调用与MCP协议的技术实现。特别深入分析了Intern-S1这一科学领域多模态基础模型,包括其280B参数的MoE架构、动态分词器创新、混合奖励训练方法等核心技术突破。该模型在科学推理任务上超越闭源模型,展现了开源模型