简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

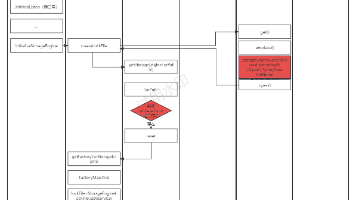

MongoDB MongoCursorNotFoundException(错误码 - 5)的成因与解决方案。该异常是因客户端访问的游标在服务端已失效,主因是游标闲置超 10 分钟被自动清理。MongoDB 通过ClientCursorMonitor后台线程每隔 60 秒扫描,CursorManager的timeoutCursors方法依据cursorShouldTimeout_inlock逻辑,判

OpenClaw日志系统基于tslog构建,提供多级别日志管理能力。系统支持7种日志级别(silent至trace),通过数值大小控制日志过滤机制。默认级别根据环境自动适配:生产环境为info,测试环境为silent。配置支持四种方式:配置文件定义(支持独立设置文件和控制台日志)、环境变量覆盖(OPENCLAW_LOG_LEVEL)、命令行参数(--verbose提升至debug级别)以及运行时A

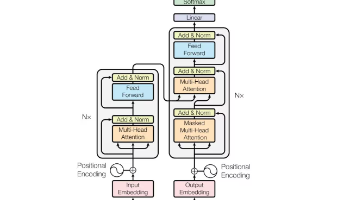

本项目成功构建了基于Transformer的医疗文本科室分类模型,实现了患者病情文本到就诊科室的精准映射,模型准确率高、推理速度快,可应用于医疗咨询分诊、智能问答等场景。通过HF镜像解决了数据集下载问题,通过合理的模型设计与超参数配置,确保了模型的性能与泛化能力。后续可进一步优化模型结构、扩大数据集规模,提升模型对复杂病情文本的分类精度,同时完善Flask服务,适配生产环境部署需求。

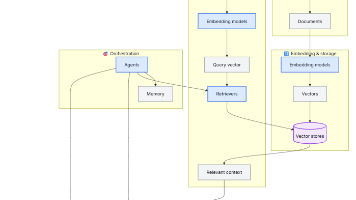

摘要:本文对比了LangChain与SpringAI两大AI开发框架的核心特性。LangChain基于Python生态,强调组件可组合性,支持链式调用、智能体、工具等概念;SpringAI则基于Java生态,采用Spring风格抽象,注重依赖注入和声明式配置。二者在记忆管理、模型调用、提示词、工具调用、持久化、向量数据库等核心功能上各有特色:LangChain灵活性高但学习曲线陡峭,SpringA

摘要:本文介绍OpenClaw项目在Windows系统下的环境配置与运行指南。要求Node.js≥22.12.0,推荐使用v24.14.0版本。针对多版本Node共存问题,提供了临时环境变量设置方法(CMD/PowerShell/Bash)。详细说明了Git Bash的安装步骤及使用场景,特别解决了Windows下bash命令报错问题。项目构建流程包括:设置高版本Node路径、验证环境、安装依赖(

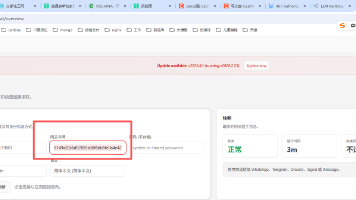

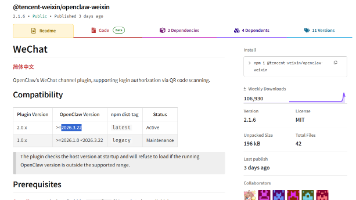

本文记录了在Windows11环境下从源码编译运行OpenClaw AI助手框架并安装微信插件的完整过程。主要解决了三个关键问题:1)源码编译版需使用pnpm openclaw命令而非全局安装;2)因ClawHub限流需切换国内npm镜像;3)正确的插件安装启用流程。文章详细说明了安装步骤、配置修改及问题解决方案,特别强调了源码编译场景下的注意事项,为开发者提供了实用的参考指南。

本文记录了在Windows11环境下从源码编译运行OpenClaw AI助手框架并安装微信插件的完整过程。主要解决了三个关键问题:1)源码编译版需使用pnpm openclaw命令而非全局安装;2)因ClawHub限流需切换国内npm镜像;3)正确的插件安装启用流程。文章详细说明了安装步骤、配置修改及问题解决方案,特别强调了源码编译场景下的注意事项,为开发者提供了实用的参考指南。

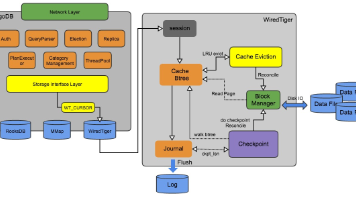

当mongod 启动时,初始化存储引擎在src/mongo/db/storage/storage_engine_init.cpp中的 initializeStorageEngine() 函数里。mongodb启动之后,数据data文件夹有几个重要文件:mongod.lock,storage.bson,WiredTiger.lock,WiredTiger,WiredTiger.wt,sizeStor

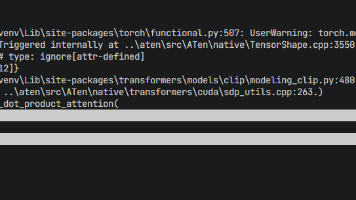

Sonic是一个基于音频的人像动画生成系统,能够将静态图片与音频结合生成对口型动画。本文详细介绍了环境搭建步骤:1)安装FFmpeg并配置环境变量;2)克隆项目并创建Python虚拟环境;3)安装依赖包和预训练模型。针对常见问题提供了解决方案,包括依赖安装超时、模型下载失败、CUDA内存不足等问题的处理方法。特别针对低配显卡给出了优化建议,如降低分辨率、减少推理步数或使用CPU模式运行。完整的环境

MongoDB MongoCursorNotFoundException(错误码 - 5)的成因与解决方案。该异常是因客户端访问的游标在服务端已失效,主因是游标闲置超 10 分钟被自动清理。MongoDB 通过ClientCursorMonitor后台线程每隔 60 秒扫描,CursorManager的timeoutCursors方法依据cursorShouldTimeout_inlock逻辑,判