简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

摘要 2025年某企业AI智能体平台采用五层微服务架构(接入层、应用服务层、核心能力层、模型层、基础设施层),攻克了微服务拆分、多模型动态路由和RAG分级检索等关键技术。通过安全沙箱、分级限流和多级存储策略,实现5000TPS高并发、800ms低延迟响应,客服问题解决率提升20%至82%。开发周期从月级缩短至天级,验证了架构的灵活性。未来将探索多智能体协同与可解释性优化,并引入服务网格降低运维成本

本文系统研究了知识图谱增强的检索生成技术(GraphRAG),针对传统检索增强生成(RAG)在知识时效性、幻觉问题和多跳推理能力等方面的不足,提出"知识建模层-检索优化层-生成增强层"的三层学术框架。GraphRAG通过将非结构化文本转化为结构化知识图谱,利用图遍历算法实现精准检索,并结合大语言模型生成可靠内容。研究表明,该技术能有效提升检索精准度、增强推理能力并降低生成内容的幻觉概率,为知识密集

摘要: 法律行业大模型通过垂直领域优化解决通用大模型的法律知识缺陷。清华大学开发的PowerLawGLM基于GLM-130B,通过三阶段训练(法律语料收集、对话对齐微调、工程优化)提升合同生成、法律问答等专业能力;北大ChatLaw则基于Ziya-LLaMA-13B,整合外部知识库增强准确性。两者均针对通用模型易产生的虚假案例引用等问题,提供更可靠的法律服务,推动AI在法律咨询、文书生成等场景的应

本文详细介绍RAG高级技术,重点讲解GraphRAG如何解决传统RAG在多跳推理和全局总结问题上的局限。通过迪士尼智能客服案例,从实体识别、关系抽取、社区发现到检索模式,全面阐述GraphRAG构建流程,并提供完整系统架构设计、性能优化、成本控制和部署指南,为开发者提供从理论到实践的完整学习路径。

本文全面介绍LangChain框架的核心功能与应用场景。LangChain作为当前最热门的AI开发框架,具备连接大型语言模型与外部工具的能力,使开发者无需机器学习背景即可构建智能应用。文章详细解析了7大核心组件:1) Models层支持多种大模型接入;2) Prompts组件实现zero-shot和few-shot提示;3) Chains组件串联任务流程;4) Agents智能代理调用外部工具;5

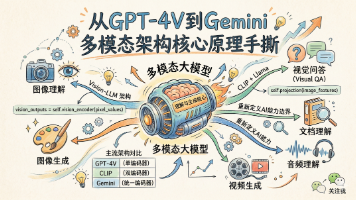

多模态大模型是AI领域的重要突破,能够同时处理文本、图像、音频等多种数据形式。本文系统介绍了多模态模型的特点、典型应用(如自动驾驶、医疗诊断)、关键技术(模态融合、对齐等)以及主流模型(GPT-4V、Gemini等)。相比传统语言模型,多模态模型具备更强的跨模态理解和生成能力。文章还分析了当前挑战(训练成本高、融合精度待提升)和未来发展方向(降低成本、拓展应用)。最后提供了AI大模型学习路径和资源

本文提供大语言模型(LLM)的系统化学习路径,涵盖数学基础、机器学习、深度学习和Python编程等前置知识,详细介绍NLP基础、Transformer架构和LLM进阶技术,设计了从入门到高级的实践项目和分阶段学习路线图。文章还提供避坑建议和持续学习资源,适合不同基础的读者系统掌握大模型技术,并附带免费学习资料包。

本文系统解析了多模态大模型的核心架构与实现方案。首先定义了多模态大模型的概念与核心能力,详细对比了单编码器、双编码器和统一编码器三种主流架构,并提供了Vision-LLM的典型实现代码。重点剖析了视觉编码器选择、投影层设计(线性/MLP/Q-Former三种方案)等关键组件,介绍了三阶段训练策略(预训练-指令微调-任务微调)和损失函数设计。最后总结了实际应用中常见的图像分辨率处理和视觉token压

vLLM-Omni是vLLM团队推出的全模态框架,扩展了原vLLM的文本处理能力,支持图像、视频和音频等多种模态。它采用非自回归架构和异构输出技术,具有高效缓存管理、流水线并行执行等优势。该框架易用性强,兼容Hugging Face热门模型,提供标准API接口,支持分布式推理。文章详细介绍了安装方法和离线/在线推理示例,为开发者提供了全模态大模型部署的完整解决方案。

在这个数据驱动的时代,大模型作为人工智能领域的核心技术,正引领着一场深刻的行业变革。对于众多有志于投身AI领域的新人来说,转行至大模型开发和应用无疑是一个充满挑战与机遇的选择。以下是为大模型新人量身定制的转行指南,旨在帮助你了解大模型的不同方向、能力要求、常见误区,以及如何顺利踏入这一领域的最佳路径。