简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

deepseek-v3是截止博文撰写之日,无论是国内还是国际上发布的大模型中表现十分亮眼的模型,这里以deepseek为例,讲解如何获取api_key、base_url、chat_model。

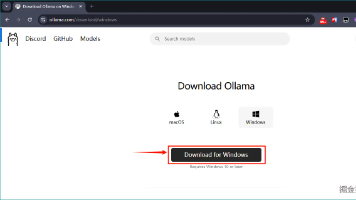

通过 Ollama 部署 DeepSeek-R1 的流程可概括为:安装 Ollama(自定义目录)→ 配置模型存储路径 → 下载模型 → 配置 Web UI。整个过程无需复杂的环境配置,即使是非专业开发者也能在 30 分钟内完成。后续可根据需求尝试 DeepSeek-R1 的代码生成、文档总结等功能,或部署其他开源模型(如 Llama 3、Qwen-7B)。

一文搞懂Prompt、AI Agent、MCP和function calling

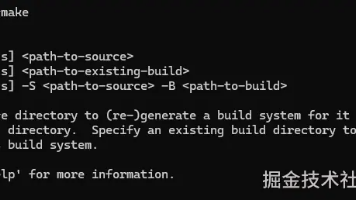

为此我们需要借助llama.cpp对模型文件进行量化,经由llama.cpp量化后的模型(以llama3.1-8b指令微调版为例)即使是在个人消费级显卡也能顺利运行。我这里是放入了ollama映射的本地文件夹内,也可以生成后手动剪切到您ollama设置的映射文件夹下,新建Modelfile.txt文件。llama.cpp是由C++编写的,因此为了在本地使用,首先我们需要下载VisualStudio

Ollama 1.8版本更新带来图形界面,降低使用门槛,但功能仍较基础。新增Turbo会员服务(20美元/月),提供云端大模型支持。平台面临挑战:Meta开源模型表现不佳,部分热门模型未首发Ollama,开发者开始转向其他平台。用户反映存在下载管理、模型查询等技术问题,部分开发者考虑迁移至LMStudio等替代平台。整体更新亮点有限,商业化步伐加快但创新不足。

本文介绍了一个基于Transformer.js的浏览器端文本转语音(TTS)应用,该应用通过加载HuggingFace开源模型,实现了完全在本地浏览器中运行AI推理任务。文章详细解析了其技术架构,包括使用React构建UI界面、WebWorkers处理计算任务、单例模式管理模型实例、多音色支持等关键技术。该方案解决了传统TTS服务的隐私风险和网络依赖问题,所有计算均在用户设备上完成,支持离线使用且

虽然目前有很多命令行方式的ai代码工具,比如codex code、qwen、gemini等等。但是我仍然觉得claude code非常好用。要想顺畅的使用它,有必要掌握一些常用小技巧,本文对这些小技巧进行了整理,希望对你有帮助。

vLLM是一个高效开源框架,专为大型语言模型(LLM)推理优化设计。其核心PagedAttention技术借鉴操作系统分页思想,将注意力计算分块管理,显存利用率高达96%,显著提升性能。vLLM支持多GPU并行、多种解码算法,兼容HuggingFace模型和OpenAI API,在推理速度上比传统框架快3.5-24倍。该框架适用于聊天机器人、长文本生成等高并发场景,通过简单API即可实现性能提升,

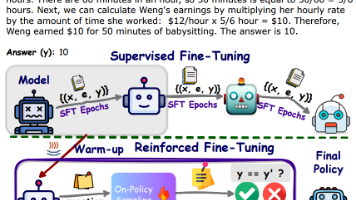

字节跳动提出ReFT方法:强化学习提升大语言模型数学推理能力 该研究提出了一种创新的强化微调方法ReFT,通过两阶段训练框架显著提升大语言模型的数学推理能力。与传统监督微调(SFT)依赖单一推理路径不同,ReFT在强化学习阶段采用PPO算法,使模型能够探索多样化的解题路径,并基于正确答案获得奖励信号。实验结果表明,在GSM8K等数学数据集上,ReFT相比SFT方法在准确率上提升12-17个百分点。

LLM是一把强大的“钥匙”,但并非“万能钥匙”。它打开了AI理解和生成自然语言的大门,却也暴露了机器智能的诸多边界。只有正视其本质和局限,扬长避短,才能让LLM真正成为人类社会的有益工具,而非“黑箱怪兽”。