简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Requests是Python中最流行的HTTP客户端库,提供简洁直观的API设计。核心功能包括: Response响应对象封装了服务器返回的所有信息,包含状态码(status_code)、文本内容(text)、二进制数据(content)、编码方式(encoding/apparent_encoding)、响应头(headers)和Cookie(cookies)等属性,以及json()解析方法。

Requests是Python中最流行的HTTP客户端库,提供简洁直观的API设计。核心功能包括: Response响应对象封装了服务器返回的所有信息,包含状态码(status_code)、文本内容(text)、二进制数据(content)、编码方式(encoding/apparent_encoding)、响应头(headers)和Cookie(cookies)等属性,以及json()解析方法。

本文介绍了JSON数据处理与操作的核心方法,重点讲解了Python中json模块的使用技巧。内容涵盖: JSON与Python数据类型的映射关系 文件操作基础(open和with语句) 内存中JSON字符串与Python对象的相互转换(dumps/loads) 磁盘上JSON文件的读写操作(dump/load) 深度学习领域常用的JSONL格式处理 特别强调了中文处理时ensure_ascii=F

本文介绍了Python中处理文件路径和系统操作的两大核心工具:传统的os模块和现代的pathlib模块。os模块基于字符串操作,提供基本路径处理功能,如os.getcwd()获取当前目录、os.listdir()列出目录内容、os.path.join()拼接路径等。pathlib模块则以面向对象方式封装路径操作,通过Path类实现更直观的路径处理,支持运算符重载(/)拼接路径,并提供exists(

本文介绍了scikit-learn库中model_selection模块的核心功能,主要包括: 数据集划分(train_test_split):用于将数据随机分割为训练集和测试集,支持设置测试集比例、随机种子和分层抽样等参数。 交叉验证(KFold):在数据量较小时,将数据等分为K份进行K次训练和测试,提供更可靠的模型评估。 网格搜索调参(GridSearchCV):自动测试预设参数组合,通过交叉

本文介绍了scikit-learn库中model_selection模块的核心功能,主要包括: 数据集划分(train_test_split):用于将数据随机分割为训练集和测试集,支持设置测试集比例、随机种子和分层抽样等参数。 交叉验证(KFold):在数据量较小时,将数据等分为K份进行K次训练和测试,提供更可靠的模型评估。 网格搜索调参(GridSearchCV):自动测试预设参数组合,通过交叉

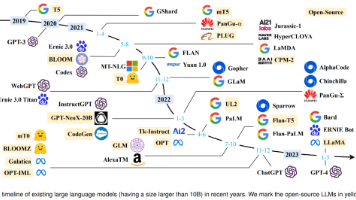

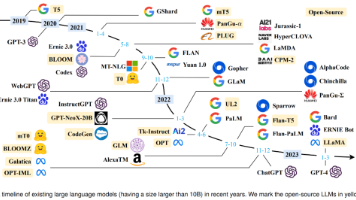

摘要 自然语言处理(NLP)作为人工智能的核心领域,正经历从规则系统到深度学习的技术变革。大模型的出现重塑了行业格局,传统技术岗位需求减少,同时催生了模型优化和垂直应用的新机遇。NLP处理的核心是序列数据,包括时间序列和文字序列。文字数据需通过分词转化为数字表示,中文分词面临独特挑战,现有jieba、HanLP等工具采用词典、统计和深度学习方法。序列数据的处理需要考虑时间步和语义顺序,这对算法设计

摘要 自然语言处理(NLP)作为人工智能的核心领域,正经历从规则系统到深度学习的技术变革。大模型的出现重塑了行业格局,传统技术岗位需求减少,同时催生了模型优化和垂直应用的新机遇。NLP处理的核心是序列数据,包括时间序列和文字序列。文字数据需通过分词转化为数字表示,中文分词面临独特挑战,现有jieba、HanLP等工具采用词典、统计和深度学习方法。序列数据的处理需要考虑时间步和语义顺序,这对算法设计

摘要 深度神经网络通过引入隐藏层解决了单层网络无法处理非线性可分问题(如异或门)的局限性。单层神经网络(如感知机)只能处理线性可分问题(与门、或门等),而多层结构通过将数据映射到高维空间使其变得线性可分。隐藏层对原始特征进行非线性变换,通过激活函数处理输入信号,并使用矩阵运算实现层间信息传递。这种结构突破了单层网络的限制,使神经网络能够解决更复杂的分类任务,为深度学习的发展奠定了基础。

神经网络损失函数摘要 神经网络训练的核心是通过损失函数衡量预测值与真实值的差异,并反向传播调整权重。主要损失函数包括: 回归任务:使用均方误差(MSE)或平方和(SSE)作为损失函数 MSE计算预测值与真实值差的平方均值 PyTorch中通过nn.MSELoss实现,需注意输入张量形状一致 分类任务:使用交叉熵损失(BCE) 特别适合二分类问题 衡量预测概率分布与真实分布的差异 可扩展到多分类场景