简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

做过几个交互决策实验,选择越多,决策成本越高。开会的时候弹出提醒,你需要的不是「我要推迟多久」这个选择题,而是一个能快速点掉、不影响开会的按钮。固定 10 分钟足够用,又不需要动脑子。

做有声书的朋友是不是总遇到:用EasyVoice生成了自然的AI语音,想让团队成员一起试听调整,却只能导出音频文件发群里?本地部署虽然能保护文本版权,但“文件传输”让协作变成“版本灾难”📄。别慌,内网穿透来帮忙,让你的EasyVoice变成“云端配音棚”,团队实时试听修改,有声内容创作从此“安全又高效”!EasyVoice的核心功能就像“私人配音演员”,支持20+种音色(新闻播报/情感朗读/动漫

电子书这件事很多人都经历过:硬盘里塞了几百本,PDF、EPUB、MOBI 都有,想找某一本的时候翻遍文件夹,文件名全是"下载-2023-修正版-最终版"这种格式,根本不知道哪本是哪本。时间久了,书越来越多,打开的越来越少,大部分都在硬盘里吃灰。其实这类问题有更系统的解决方式。Reader 是一款开源电子书管理工具,支持多种格式导入、封面识别、书籍分类和全文搜索。把它跑在极空间私有云上,书籍集中存储

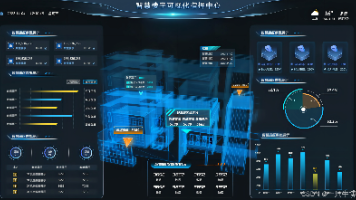

企业展厅、指挥中心等实体场地,传统 BI 大屏只是静态 “数据墙”,场地访客看不懂、现场缺讲解、展示没记忆点。本文聚焦Agent 场地落地,基于魔星云端侧数字人 + DeepSeek 大模型,将场地静态大屏升级为场地专属 AI 讲解 Agent,适配展厅参观、指挥调度等真实场地场景,实现从 “场地看数据” 到 “场地问数据” 的落地跃迁。实体场地(展厅、指挥中心)的大屏,不是单纯的展示工具,而是场

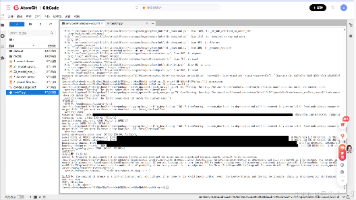

在大模型推理领域,如何在国产算力平台(如 Atlas 800T)上榨干硬件性能,是开发者关注的核心。SGLang 作为近期备受瞩目的高性能推理框架,凭借 RadixAttention 和高效的各种算子优化,成为了提升吞吐量的利器。本文将结合实际操作日志,详解如何在昇腾环境中从零开始搭建环境、跑通模型,并使用 sglang benchmark 进行专业的性能调优。

Vibe Coding常被翻译为“氛围编程”或“感觉编程”。它描述的是一种正在变得普遍的开发方式:开发者用自然语言说明需求,AI生成代码,人再根据结果继续修改、补充和验证。这种方式确实改变了写代码的节奏。过去需要先搭框架、查文档、写样板代码,现在很多步骤可以交给AI快速完成。一个想法从描述到原型,可能只需要几轮对话。但也正因为它太快,风险常常被掩盖了。AI可以生成看起来很完整的代码,也可以给出似乎

本次实践完成了一个可访问的 CloudMart 智能客服应用。整体链路是:这个项目的前端部分使用的是活动文中提到的官方客服模板,重点放在 Dify 应用配置、知识库构建和 EdgeOne Pages 部署验证上。Dify 负责 AI 应用和知识库,EdgeOne Pages 负责把官方模板部署成可访问页面,中间通过 Dify API Key 和 API URL 打通。验证项测试内容结果部署验证Ed

今天再谈计算机基础,多少有点“逆潮流”。大家更关心的是大模型、智能体、自动写代码,以及怎样更快把一个想法变成产品。可越是在这样的阶段,越容易遇到一个问题:工具越来越强,但我们对工具背后的系统反而越来越陌生。《编码:隐匿在计算机软硬件背后的语言》值得被反复提起,正在于它不是一本教你追逐新工具的书,而是带你回到计算机世界最底层的问题:信息是怎样被表示的?电路为什么能够“计算”?程序最终是怎样落到硬件上

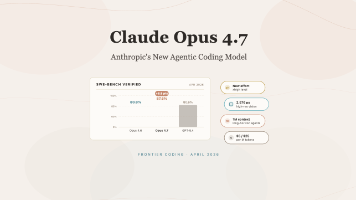

2026年4月16日,Anthropic正式发布了旗下最新旗舰模型——。Opus 4.7定价与Opus 4.6持平,但由于新版分词器的调整,实际输入消耗的token可能增长0%–35%;加之思考强度高于前代,输出token的消耗也会有所增加。因此综合来看,,这一点在上量前需提前评估。本指南将系统介绍Claude Opus 4.7的使用方法、核心升级点,以及如何将它的新能力落地到你的日常工作中。

很多团队做时序数据库选型时,先看的是峰值写入和宣传参数,但项目上线 3-6 个月后,真正影响体验的往往是另外几件事:查询是否稳定、存储成本是否可控、模型是否容易维护、运维是否能标准化。本文不做“参数秀”,而是按一个真实项目的路径,给出一套更实战的选型思路,并用 IoTDB SQL 示例串起来。下载链接:https://iotdb.apache.org/zh/Download/企业版官网:https